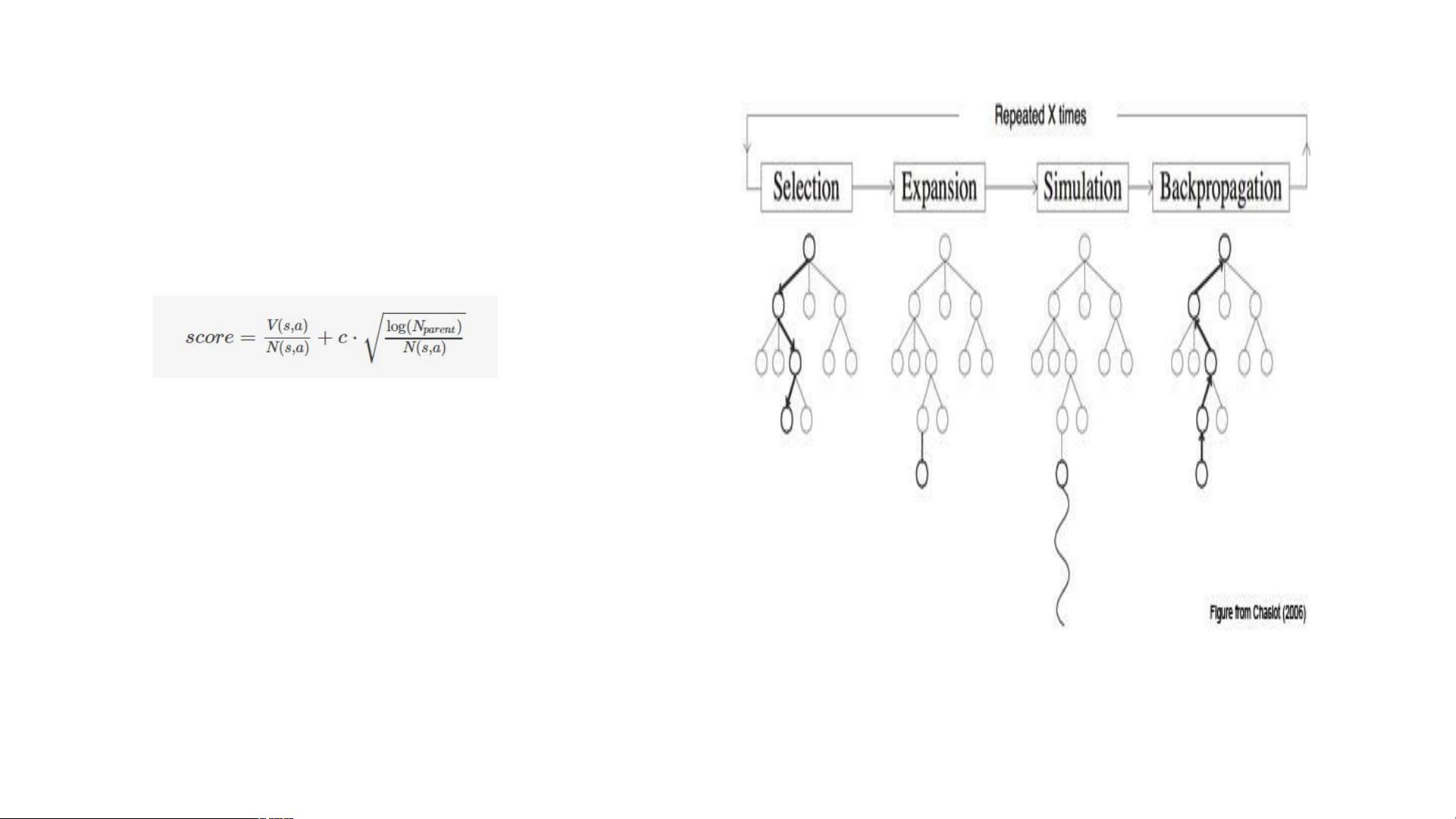

"AlphaGo VS AlphaGo Zero 对比分析讲解" AlphaGo和AlphaGo Zero是Google DeepMind开发的两款围棋人工智能程序,它们展示了人工智能在复杂策略游戏中的能力。AlphaGo是首次引起公众广泛关注的人工智能围棋程序,而AlphaGo Zero则是在其基础上的重大改进。 一、蒙特卡洛树搜索(MCTS)介绍 蒙特卡洛树搜索是AlphaGo系列的核心算法。MCTS是一种决策算法,通过模拟随机游戏过程来评估不同的行动策略。在搜索树中,每个节点代表一个游戏状态,每条边对应一个动作及其累计价值和访问次数。MCTS包括四个主要步骤: 1. Selection(选择):根据UCT(上界最大化策略)选择具有最高平均奖励的子节点进行探索,UCT公式中包含了动作的访问次数N(s,a)和总奖励V(s,a),以及一个平衡探索与利用的参数c。 2. Expansion(扩展):当到达未被访问过的叶子节点时,添加新的子节点并执行动作。 3. Evaluation or Simulation(评估或模拟):从当前节点开始,按照策略进行随机模拟直至游戏结束,返回最终胜负值(+1或-1)。 4. Backpropagation(反向传播):将模拟结果回溯到根节点,更新每个动作的累计奖励和访问次数。 二、监督学习+强化学习版(2015 Fan Hui版) AlphaGo初代采用了监督学习和强化学习的结合。首先,它通过大量人类高手的围棋棋谱进行监督学习,训练出策略网络和价值网络。策略网络预测每一步的概率分布,而价值网络评估棋盘局面的价值。接着,使用自我对弈产生的新棋局进行强化学习,进一步优化网络参数。 三、强化学习版(2017 Zero版) AlphaGo Zero不再依赖人类棋谱,而是完全依靠强化学习。它仅用一个神经网络同时预测策略和价值,通过自我对弈不断迭代改进。初始阶段,网络随机选取动作,随着训练的进行,逐渐学会高效策略。AlphaGo Zero的优势在于它能够从零开始,仅凭基本规则就能达到超越人类的水平。 四、版本对比及细节介绍 AlphaGo Zero相比AlphaGo有以下显著区别: 1. 训练方法:AlphaGo Zero采用纯强化学习,而AlphaGo结合了监督学习。 2. 网络结构:AlphaGo Zero只有一个神经网络,简化了架构,而AlphaGo有两个独立的网络。 3. 数据依赖:AlphaGo Zero不依赖人类棋谱,而AlphaGo需要大量棋谱数据。 4. 性能提升:AlphaGo Zero在更短的时间内达到了更高水平,且计算资源需求相对较小。 AlphaGo Zero的成功表明,强化学习是实现人工智能自主学习和创新的强大工具,它不仅在围棋领域,也在其他复杂问题上展现出巨大潜力。这种技术的进步为未来的人工智能研究提供了新的方向和挑战。

剩余28页未读,继续阅读

- 粉丝: 61

- 资源: 4

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 前端面试必问:真实项目经验大揭秘

- 永磁同步电机二阶自抗扰神经网络控制技术与实践

- 基于HAL库的LoRa通讯与SHT30温湿度测量项目

- avaWeb-mast推荐系统开发实战指南

- 慧鱼SolidWorks零件模型库:设计与创新的强大工具

- MATLAB实现稀疏傅里叶变换(SFFT)代码及测试

- ChatGPT联网模式亮相,体验智能压缩技术.zip

- 掌握进程保护的HOOK API技术

- 基于.Net的日用品网站开发:设计、实现与分析

- MyBatis-Spring 1.3.2版本下载指南

- 开源全能媒体播放器:小戴媒体播放器2 5.1-3

- 华为eNSP参考文档:DHCP与VRP操作指南

- SpringMyBatis实现疫苗接种预约系统

- VHDL实现倒车雷达系统源码免费提供

- 掌握软件测评师考试要点:历年真题解析

- 轻松下载微信视频号内容的新工具介绍

信息提交成功

信息提交成功