机器学习入门:显著式编程与非显著编程的理解

需积分: 3 6 浏览量

更新于2024-08-03

收藏 1.04MB PDF 举报

"机器学习复习提纲,涵盖了显著式编程与非显著式编程的概念,机器学习的定义,以及监督学习、非监督学习、半监督学习和强化学习的应用。此外,提纲还涉及到k近邻算法的原理、步骤、k值选择的影响、优缺点,以及k折交叉验证法。最后提到了决策树分类模型的基本思路和信息熵的定义及应用。"

机器学习是人工智能领域的核心研究方向,它主要关注如何通过数据和经验提升计算机算法的性能。显著式编程是一种传统编程方式,要求程序员详尽地定义环境和规则,而非显著式编程则允许计算机通过设定行为、收益函数,通过自我学习和优化来实现任务。在机器学习中,我们通常会遇到四种主要的学习类型:监督学习(有标签数据)、非监督学习(无标签数据)、半监督学习(少量标签数据)和强化学习(基于环境反馈的学习)。

k近邻算法(K-Nearest Neighbors, KNN)是一种简单的分类和回归方法。其基本思想是:新样本会根据其最近的k个训练样本的类别进行分类,多数类别决定新样本的归属。k值的选择至关重要,它直接影响分类效果。较小的k值可能导致过拟合,较大的k值可能会引入噪声,但计算成本也会增加。k折交叉验证法用于评估模型的性能,通过将数据集分成k个子集,依次作为测试集,其余作为训练集,平均各个测试结果,提高模型泛化能力。

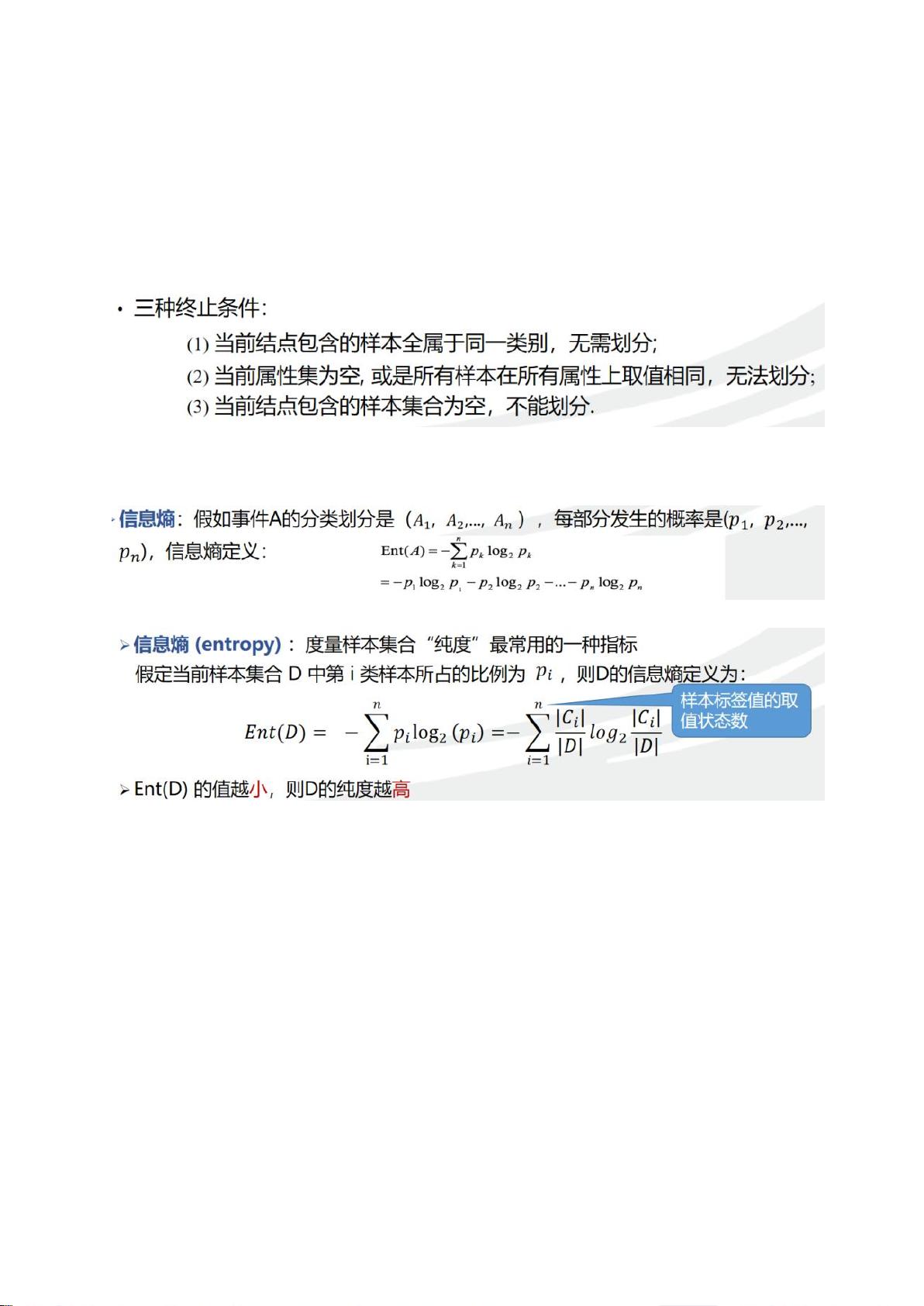

决策树是一种直观的分类模型,通过选择最佳特征进行数据划分,形成树状结构。构造决策树时,通常依据信息熵或基尼不纯度等指标寻找最佳划分特征。信息熵衡量数据集的纯度,越低表示数据集分类越明确。在决策树构建过程中,降低信息熵或基尼不纯度是目标,直至满足预设的停止条件,如达到预设深度或所有叶子节点都达到纯度标准。

机器学习涉及了多种方法和技术,从基础的k近邻算法到更复杂的决策树模型,它们都是为了使计算机通过学习和理解数据,提升预测和决策的准确性。掌握这些概念和方法,对于理解和应用机器学习技术至关重要。

2009-04-10 上传

2009-07-03 上传

2017-04-26 上传

2021-11-18 上传

2022-11-29 上传

2009-06-25 上传

2021-09-09 上传

2021-10-03 上传

2016-11-30 上传

Blossomi

- 粉丝: 3w+

- 资源: 93

最新资源

- Chrome ESLint扩展:实时运行ESLint于网页脚本

- 基于 Webhook 的 redux 预处理器实现教程

- 探索国际CMS内容管理系统v1.1的新功能与应用

- 在Heroku上快速部署Directus平台的指南

- Folks Who Code官网:打造安全友好的开源环境

- React测试专用:上下文提供者组件实现指南

- RabbitMQ利用eLevelDB后端实现高效消息索引

- JavaScript双向对象引用的极简实现教程

- Bazel 0.18.1版本发布,Windows平台构建工具优化

- electron-notification-desktop:电子应用桌面通知解决方案

- 天津理工操作系统实验报告:进程与存储器管理

- 掌握webpack动态热模块替换的实现技巧

- 恶意软件ep_kaput: Etherpad插件系统破坏者

- Java实现Opus音频解码器jopus库的应用与介绍

- QString库:C语言中的高效动态字符串处理

- 微信小程序图像识别与AI功能实现源码