理解贝叶斯线性回归:从普通回归到概率预测

需积分: 0 118 浏览量

更新于2024-08-05

收藏 1.26MB PDF 举报

"这篇文章主要介绍了贝叶斯线性回归的基本概念和原理,通过一个简单的例子展示了为什么需要使用贝叶斯线性回归,并解释了贝叶斯定理在其中的应用。"

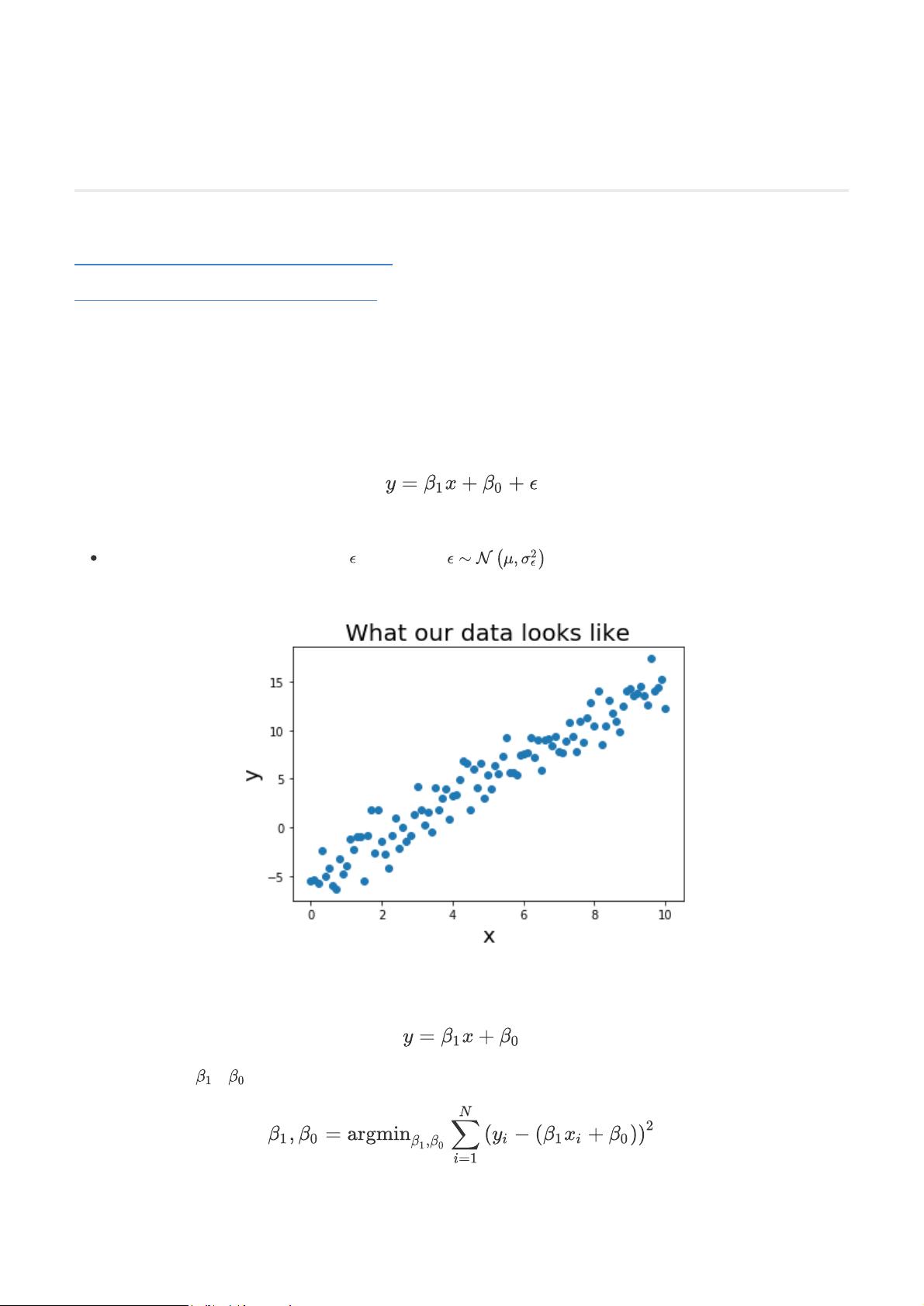

贝叶斯线性回归是一种统计建模方法,它扩展了传统的线性回归模型,增加了对模型参数不确定性进行建模的能力。在标准线性回归中,我们通常寻找最优的模型参数(斜率和截距)来最小化预测误差。然而,这种方法不能直接提供参数的不确定性信息,而贝叶斯线性回归则通过引入先验知识和贝叶斯定理来解决这个问题。

首先,我们来理解为什么需要贝叶斯线性回归。在线性回归中,我们假设数据的误差是正态分布的,然后寻找最小化均方根误差的直线。但是,这种做法忽略了参数的不确定性,尤其是在数据稀疏或未覆盖的区域。贝叶斯线性回归允许我们对模型参数给出一个概率分布,从而能够表达参数的不确定性,提供置信区间,使预测更具解释性。

贝叶斯定理是贝叶斯线性回归的核心,它连接了先验分布、似然函数和后验分布。先验分布表示在观察数据之前我们对参数的信念,而似然函数则是数据对参数的分布。通过将两者结合,我们可以得到参数的后验分布,即在给定数据后的最新信念。

在这个例子中,假设我们有一个简单的线性模型,其参数为斜率和截距。我们使用高斯分布作为参数的先验,表示我们对参数的初步估计。当新数据出现时,贝叶斯定理会更新这个先验,生成新的后验分布。这个后验分布不仅包含参数最可能的值,还包含了这些值的不确定性。

具体来说,假设参数的先验分布为高斯分布,这意味着我们对参数有一个初始的信念,比如认为它们可能集中在某个特定区域。随着数据的增加,后验分布会逐渐聚焦在更准确的参数估计上。通过多次抽样后验分布,我们可以得到一系列可能的参数值,这些值的集合构成了我们对模型参数不确定性的一个完整描述。

总结来说,贝叶斯线性回归是线性回归的一种扩展,它利用贝叶斯定理将先验知识与观测数据相结合,生成参数的后验分布,从而提供参数不确定性信息。这种方法对于处理数据稀疏或需要解释性预测的情况特别有用。通过理解和应用贝叶斯线性回归,我们可以更好地理解模型的局限性和可靠性,为决策提供更为全面的依据。

2018-09-29 上传

2021-03-08 上传

2022-07-10 上传

2022-07-10 上传

2010-08-10 上传

2023-04-21 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

五月Eliy

- 粉丝: 37

- 资源: 304

最新资源

- NIST REFPROP问题反馈与解决方案存储库

- 掌握LeetCode习题的系统开源答案

- ctop:实现汉字按首字母拼音分类排序的PHP工具

- 微信小程序课程学习——投资融资类产品说明

- Matlab犯罪模拟器开发:探索《当蛮力失败》犯罪惩罚模型

- Java网上招聘系统实战项目源码及部署教程

- OneSky APIPHP5库:PHP5.1及以上版本的API集成

- 实时监控MySQL导入进度的bash脚本技巧

- 使用MATLAB开发交流电压脉冲生成控制系统

- ESP32安全OTA更新:原生API与WebSocket加密传输

- Sonic-Sharp: 基于《刺猬索尼克》的开源C#游戏引擎

- Java文章发布系统源码及部署教程

- CQUPT Python课程代码资源完整分享

- 易语言实现获取目录尺寸的Scripting.FileSystemObject对象方法

- Excel宾果卡生成器:自定义和打印多张卡片

- 使用HALCON实现图像二维码自动读取与解码