机器学习基础:线性模型与回归分析

需积分: 49 192 浏览量

更新于2024-07-18

1

收藏 4.07MB PPTX 举报

"该资源是2016年南京大学机器学习导论课程的一部分,主要讲解了线性模型在机器学习中的应用,包括线性回归和线性模型的变种,如对数线性回归和对率回归。课程强调了线性模型的简单性和实用性,并讨论了处理离散属性的方法以及在遇到矩阵不满秩时如何引入正则化来解决。"

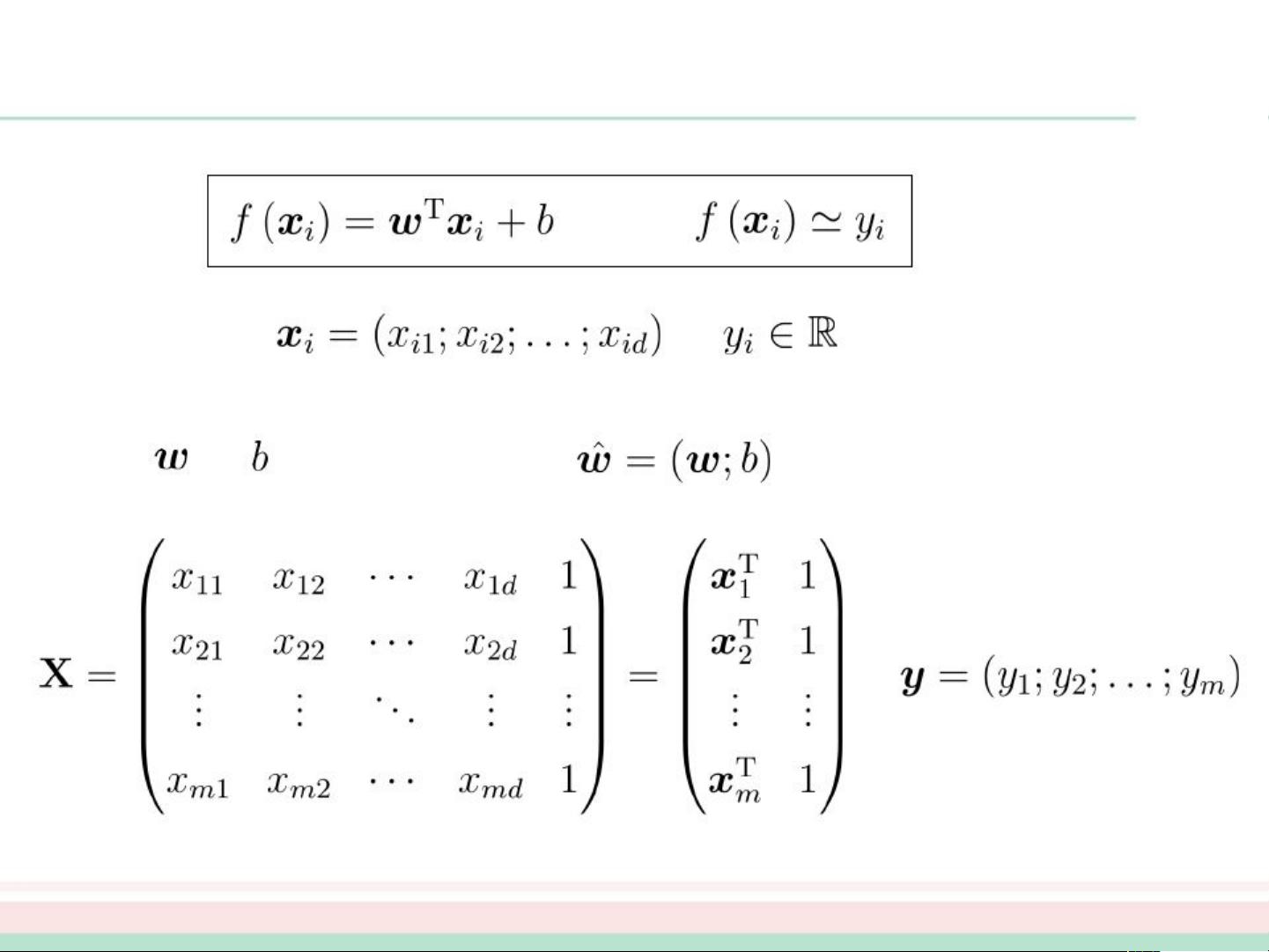

线性模型是机器学习中的基础工具,它以属性的线性组合来预测目标变量。线性回归是最简单的线性模型形式,用于连续变量的预测。在这个模型中,目标变量是输入特征的加权和加上一个截距项,通过最小化均方误差来确定这些权重。当数据中包含离散属性时,如果这些属性具有顺序关系,可以将其连续化;如果没有顺序关系,通常会将它们转换为多维向量表示。

多元线性回归扩展了这个概念,处理多个自变量的情况。它同样使用最小二乘法来估计参数,但涉及到矩阵运算,尤其是求解系数矩阵的逆。如果矩阵不满秩,意味着存在多重解,这时需要引入正则化,比如拉格朗日正则化或岭回归,以避免过拟合并增加模型的稳定性。正则化在第6章和第11章会有更深入的探讨。

对数线性回归是线性回归的一个变形,它通过取目标变量的对数来使模型适应非线性的关系。广义线性模型则进一步推广了这一思想,引入了一个联系函数,允许我们选择不同的函数形式来适应不同类型的响应变量。对率回归(逻辑回归)是其中的一种,它使用对数几率函数(对率函数),即逻辑函数,作为联系函数,适用于二分类问题。逻辑回归能够提供近似概率预测,而且不需要事先假设数据分布,因此在实践中非常流行。

在实际应用中,线性模型因其简洁和解释性强而受到青睐。它们不仅易于理解和实现,而且在某些情况下能提供良好的预测性能。然而,线性模型的局限性在于它们可能无法捕捉复杂的非线性关系,这时可能需要转向决策树、神经网络等更复杂的模型。尽管如此,线性模型仍然是理解和掌握机器学习理论的重要基石。

2022-03-08 上传

2024-07-18 上传

2021-02-04 上传

2020-07-15 上传

2022-04-30 上传

2022-08-08 上传

winner高峰

- 粉丝: 13

- 资源: 36

最新资源

- 多步表单

- ADcontroller.rar_VHDL/FPGA/Verilog_VHDL_

- 适用于WebMessage客户端的iOS调整伴侣-Swift开发

- symhx-backstage

- pika:Pure Python RabbitMQAMQP 0-9-1客户端库

- SynchQt-开源

- wp的Web服务编程案例

- 你好,世界

- tic-tac-toe.rar_棋牌游戏_Java_

- typescript-api:使用打字稿制作的REST API服务器

- 金字塔:金字塔-一个Python网络框架

- transfer-.meta-to-.pb:把模型的ckpt文件和meta文件转化成pb文件

- Tabs To Batch-crx插件

- Swift的XML / HTML解析器-Swift开发

- index.php_QQ浏览器压缩包.zip

- 参考资料-FR-NK0115资金审批单(加编号).zip