"学习CNN反向求导及练习:斯坦福UFLDL新教程实验探究"

需积分: 0 108 浏览量

更新于2023-12-13

收藏 8.85MB PDF 举报

Deep learning:CNN的反向求导及练习

本文介绍了卷积神经网络(Convolutional Neural Network,CNN)的反向求导及练习,旨在更深入地研究该模型。尽管之前的博文中简单介绍了CNN的使用方法,但那是建立在一个前提之上的:CNN的参数必须已经事先学习好。

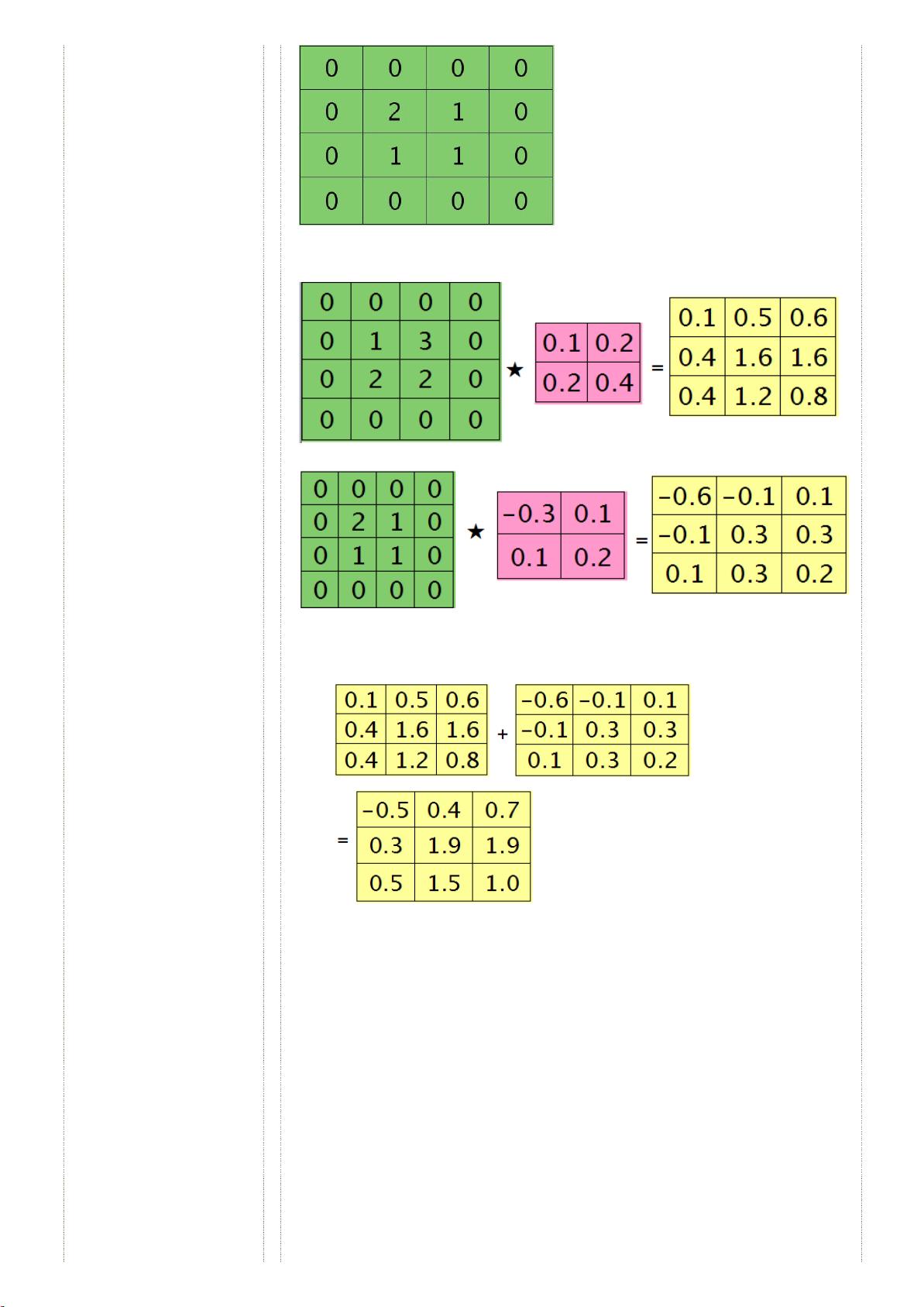

本文的主要目的是介绍在使用反向传播(Backpropagation,BP)算法时如何训练CNN的参数。尽管CNN的BP算法与多层感知机(Multi-layer Perceptron,MLP)的BP算法在本质上相同,但形式上存在一些区别,因为CNN中包含卷积层和下采样层。在进行CNN反向传播之前,了解BP算法是必不可少的。

本文的实验部分参考了斯坦福大学UFLDL:Exercise: Convolutional Neural Network教程中的内容。

卷积神经网络是深度学习领域中最成功的模型之一。其通过使用卷积核对输入进行卷积运算,并通过下采样层对结果进行降维,从而实现对图像等复杂数据的处理和学习。CNN在计算机视觉、自然语言处理等领域都有广泛的应用。

在实验部分中,我们采用了斯坦福大学的UFLDL教程中的训练集和测试集,并使用了MATLAB编程语言进行实验。我们通过实现CNN的前向传播和反向传播过程,以及相关的数值优化方法(例如梯度下降),对CNN的参数进行训练和优化。

通过实验结果的分析,我们发现CNN在训练集和测试集上均取得了很好的效果。在进行反向传播和参数训练的过程中,我们还探讨了不同的参数设置对模型性能的影响,例如学习率、激活函数、正则化等。通过调整这些参数,我们可以进一步提高模型的性能。

总之,本文通过深入研究CNN的反向求导及练习,介绍了CNN参数在使用BP算法时的训练方法,并通过实验验证了模型的有效性。这对于进一步理解并应用CNN模型具有重要意义。同时,通过实践中的探索和优化,我们也加深了对深度学习算法和优化方法的理解。

363 浏览量

328 浏览量

183 浏览量

255 浏览量

2022-08-03 上传

112 浏览量

180 浏览量

788 浏览量

180 浏览量

泡泡SOHO

- 粉丝: 29

最新资源

- 网页自动刷新工具 v1.1 - 自定义时间间隔与关机

- pt-1.4协程源码深度解析

- EP4CE6E22C8芯片三相正弦波发生器设计与实现

- 高效处理超大XML文件的查看工具介绍

- 64K极限挑战:国际程序设计大赛优秀3D作品展

- ENVI软件全面应用教程指南

- 学生档案管理系统设计与开发

- 网络伪书:社区驱动的在线音乐制图平台

- Lettuce 5.0.3中文API文档完整包下载指南

- 雅虎通Yahoo! Messenger v0.8.115即时聊天功能详解

- 将Android手机转变为IP监控摄像机

- PLSQL入门教程:变量声明与程序交互

- 掌握.NET三层架构:实例学习与源码解析

- WPF中Devexpress GridControl分组功能实例分析

- H3Viewer: VS2010专用高效帮助文档查看工具

- STM32CubeMX LED与按键初始化及外部中断处理教程