深度学习实践:卷积神经网络(CNN)基础与二维互相关运算

143 浏览量

更新于2024-08-30

1

收藏 629KB PDF 举报

"本文主要介绍了卷积神经网络(CNN)的基础知识,包括卷积层、填充、步幅、输入通道和输出通道的概念,以及二维互相关运算。通过Python代码示例,展示了如何实现二维互相关运算,并介绍了二维卷积层在处理图像数据中的应用。"

在深度学习领域,卷积神经网络(CNN)是一种专门设计用于处理具有网格结构数据,如图像和音频的神经网络。CNN的关键特性是其卷积层,该层通过卷积操作提取特征。在本篇中,卷积层被详细介绍:

1.1.1. 卷积层:卷积层是CNN的核心,它通过卷积核(或称滤波器)对输入数据进行扫描,以检测图像中的特定模式或特征。每个卷积核都会产生一个输出特征映射。

1.1.2. 填充(Padding):在输入数据边缘添加额外的零,以保持输出尺寸与输入尺寸相同或接近,有助于保留边缘信息。

1.1.3. 步幅(Stride):卷积核移动的步长,决定了卷积层输出的分辨率。较大的步幅会减少输出尺寸,但可能导致丢失部分信息。

1.1.4. 输入通道和输出通道:在多通道输入(如RGB图像)中,输入通道指每个像素的维度,输出通道则表示卷积层可以学习到的不同特征的数量。

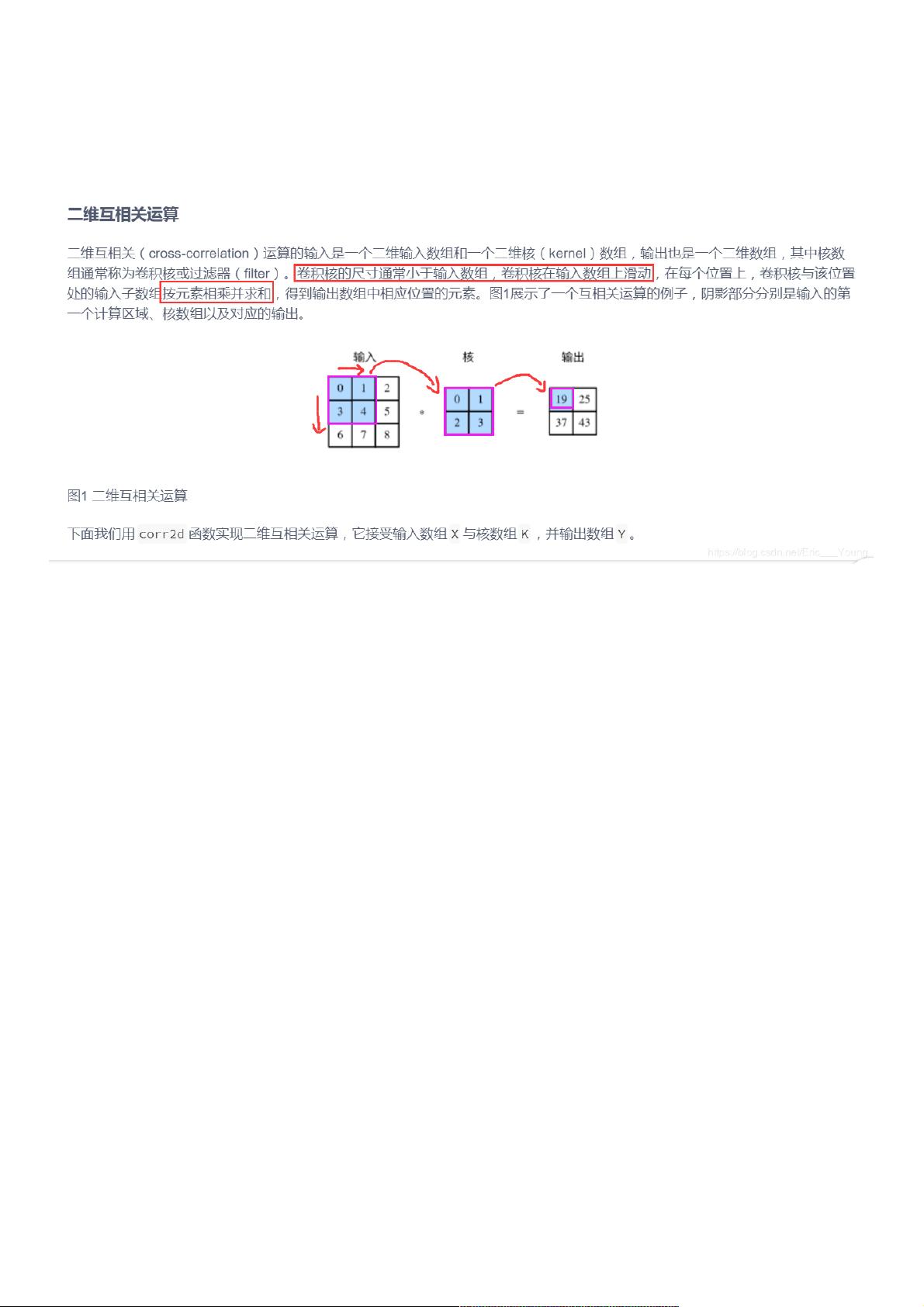

二维互相关运算(Cross-Correlation)是卷积层的基本运算,它与卷积类似,但计算方式略有不同。在示例代码中,`corr2d`函数实现了这一运算,遍历输入数组X的所有可能位置,将卷积核K应用于X的子区域,然后求和得到输出Y。

1.2.1. 二维卷积层用于处理图像数据:在CNN中,二维卷积层通常用于图像分析,通过卷积核检测图像中的颜色、纹理和边缘等特征。

1.2.2. 卷积层的模型参数:卷积层的参数包括卷积核权重(weights)和偏置项(bias)。权重矩阵定义了卷积核的形状和数值,偏置项则是加到卷积结果上的标量,以适应不同输入的响应。

`Conv2D`类展示了如何定义一个简单的二维卷积层。在示例中,创建了一个大小为1*2的卷积层,用于检测颜色边缘。通过卷积操作,该层可以识别输入图像中的颜色变化。

本文深入浅出地讲解了CNN的基本构建块,提供了实践代码帮助读者理解二维互相关运算和卷积层的工作原理。这些基础知识对于理解深度学习模型,特别是CNN在图像识别和计算机视觉任务中的应用至关重要。

2019-07-21 上传

2021-01-20 上传

2021-01-20 上传

2020-07-16 上传

2020-07-16 上传

2019-07-29 上传

2024-08-25 上传

2021-05-21 上传

weixin_38608378

- 粉丝: 4

- 资源: 857

最新资源

- SSM动力电池数据管理系统源码及数据库详解

- R语言桑基图绘制与SCI图输入文件代码分析

- Linux下Sakagari Hurricane翻译工作:cpktools的使用教程

- prettybench: 让 Go 基准测试结果更易读

- Python官方文档查询库,提升开发效率与时间节约

- 基于Django的Python就业系统毕设源码

- 高并发下的SpringBoot与Nginx+Redis会话共享解决方案

- 构建问答游戏:Node.js与Express.js实战教程

- MATLAB在旅行商问题中的应用与优化方法研究

- OMAPL138 DSP平台UPP接口编程实践

- 杰克逊维尔非营利地基工程的VMS项目介绍

- 宠物猫企业网站模板PHP源码下载

- 52简易计算器源码解析与下载指南

- 探索Node.js v6.2.1 - 事件驱动的高性能Web服务器环境

- 找回WinSCP密码的神器:winscppasswd工具介绍

- xctools:解析Xcode命令行工具输出的Ruby库