“神经网络语言模型.pdf”涵盖了词向量模型在自然语言处理中的应用,以及如何利用词向量提升模型性能。本文档主要讨论了词向量的表示方法,包括传统的one-hot编码和基于分布相似度的表示,以及神经网络语言模型在这些概念上的应用。

在自然语言处理中,词向量模型扮演着至关重要的角色。分布假说认为,语义相似的词在词向量空间中的距离更近。这一理论支持了词向量在各种任务中的应用,例如检测语义相关性和同义词,以及进行单词类比。词向量可以作为特征输入到模型中,如在文本分类和命名实体识别中使用静态词向量,只调整模型参数,不改变词向量。这种策略能够显著提高模型的性能,尤其是在处理大规模数据时。

另一方面,动态词向量则允许在模型训练过程中调整词向量的初始值,例如在基于卷积神经网络的文本分类和词性标注任务中。这种方法使得词向量能够随着模型学习不断优化,更好地捕捉文本的语义信息。

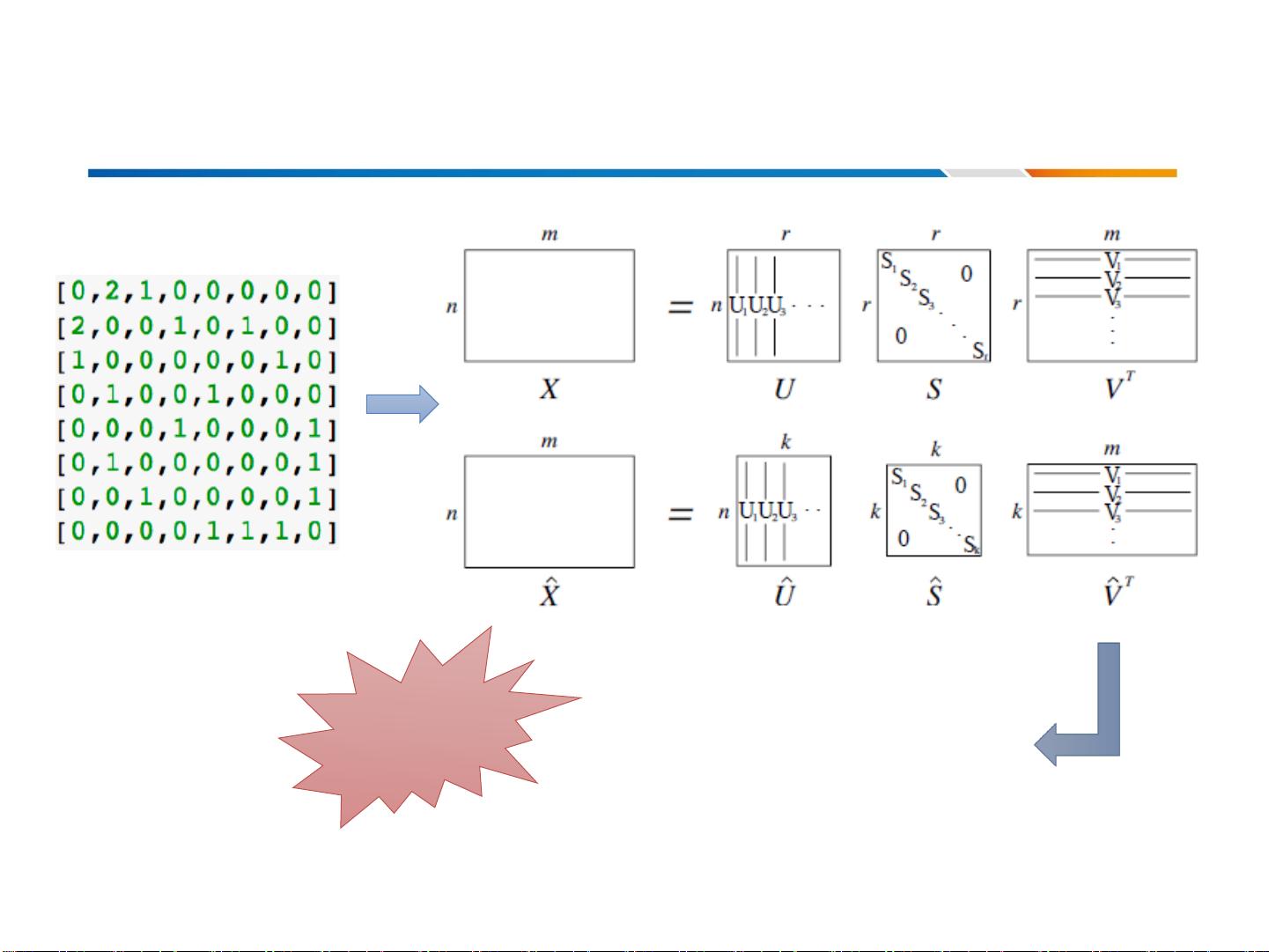

词的表示方法是理解神经网络语言模型的基础。传统的one-hot编码虽然简单明了,但在高维空间中会导致数据稀疏,无法捕捉词与词之间的关系。因此,基于分布相似度的表示应运而生,它通过分析词的上下文来学习词的表示。例如,LSA(潜在语义分析)通过降维技术处理共现矩阵,捕捉词与文档之间的关联。另一种方法是使用固定窗口长度的上下文词来捕获语法和语义信息,这更接近于实际的语言模型。

神经网络语言模型进一步发展了这一思想,通过神经网络架构学习词的连续表示。这些模型,如RNN(循环神经网络)、LSTM(长短期记忆网络)或Transformer,能够考虑更复杂的上下文信息,并预测给定词序列的概率。它们不仅用于生成连贯的文本,还广泛应用于机器翻译、问答系统和对话生成等任务。

在词向量表示的应用和对比中,我们可以看到不同模型如CBOW(连续词袋模型)和Skip-gram的比较。CBOW通过上下文词预测目标词,而Skip-gram则相反,预测目标词的上下文。这些模型在预训练阶段生成词向量,然后可以被其他任务所复用,显著提升了NLP任务的性能。

此外,研究方向还包括对词向量的改进,如增加上下文依赖的词向量(如ELMo和BERT),以及更高效的学习方法,如快速Text和GloVe。这些方法持续推动着词向量表示的前沿,使得机器更好地理解和生成人类语言。

词向量模型和神经网络语言模型是现代自然语言处理的重要组成部分,它们极大地提高了我们处理和理解文本的能力,为各种NLP任务提供了强大的工具。通过深入理解这些概念和技术,开发者和研究人员可以构建出更加智能和准确的自然语言处理系统。