MIT深度神经网络硬件加速器设计详解

"MIT深度神经网络硬件架构设计教程"

这篇教程主要涵盖了深度神经网络(DNN)的硬件架构设计,特别是围绕MIT的EYERISS芯片设计。教程由MIT的博士生Yu-Hsin Chen、教授Vivienne Sze和Joel Emer(同时也是NVIDIA的资深杰出研究科学家)主讲,旨在引导参与者深入理解DNN的关键设计考虑因素,并能够评估不同实现的DNN,利用基准测试和比较指标。此外,教程还涉及了DNN加速器、网络优化、评估指标以及训练过程。

1. 深度神经网络概述:

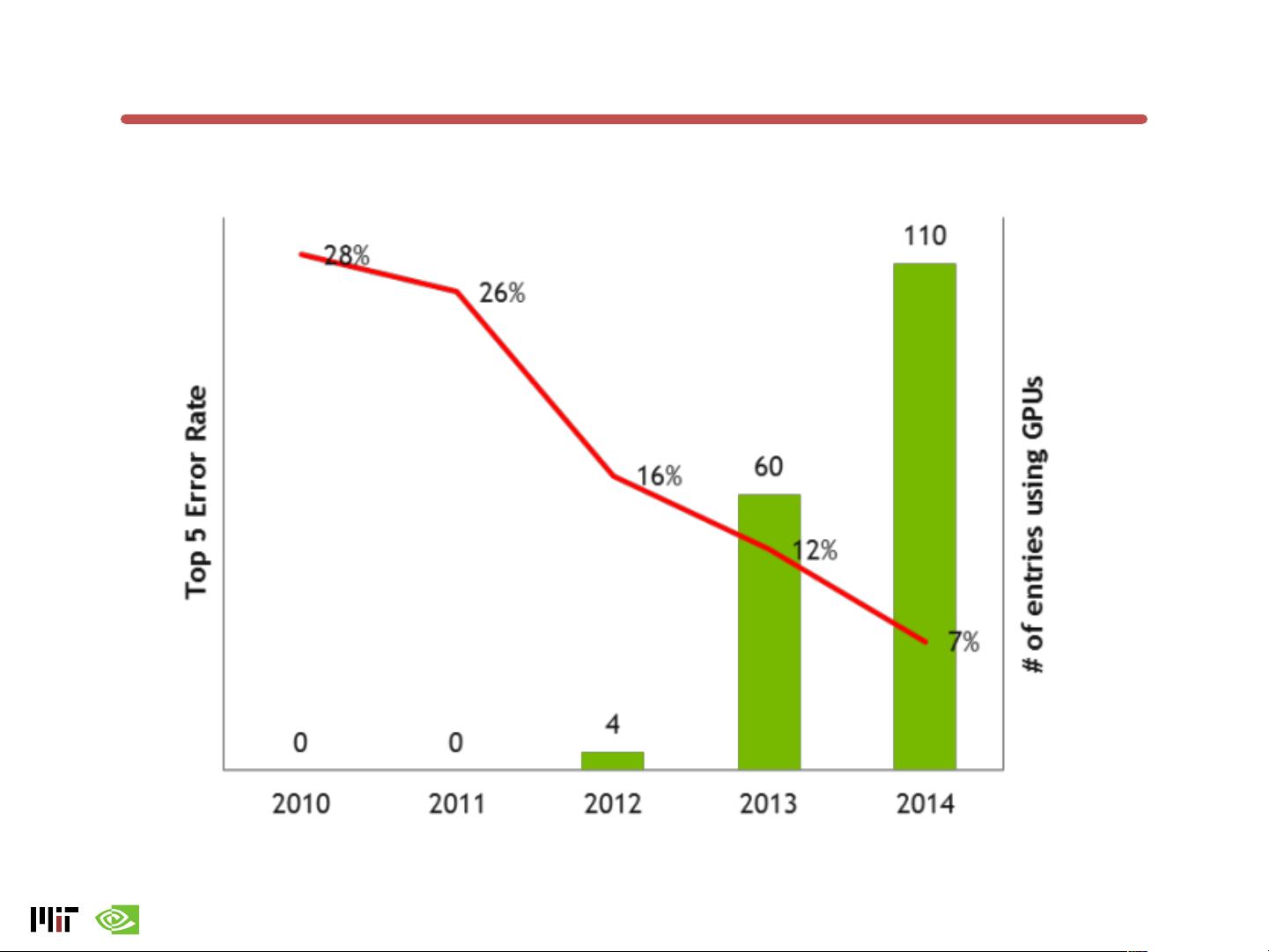

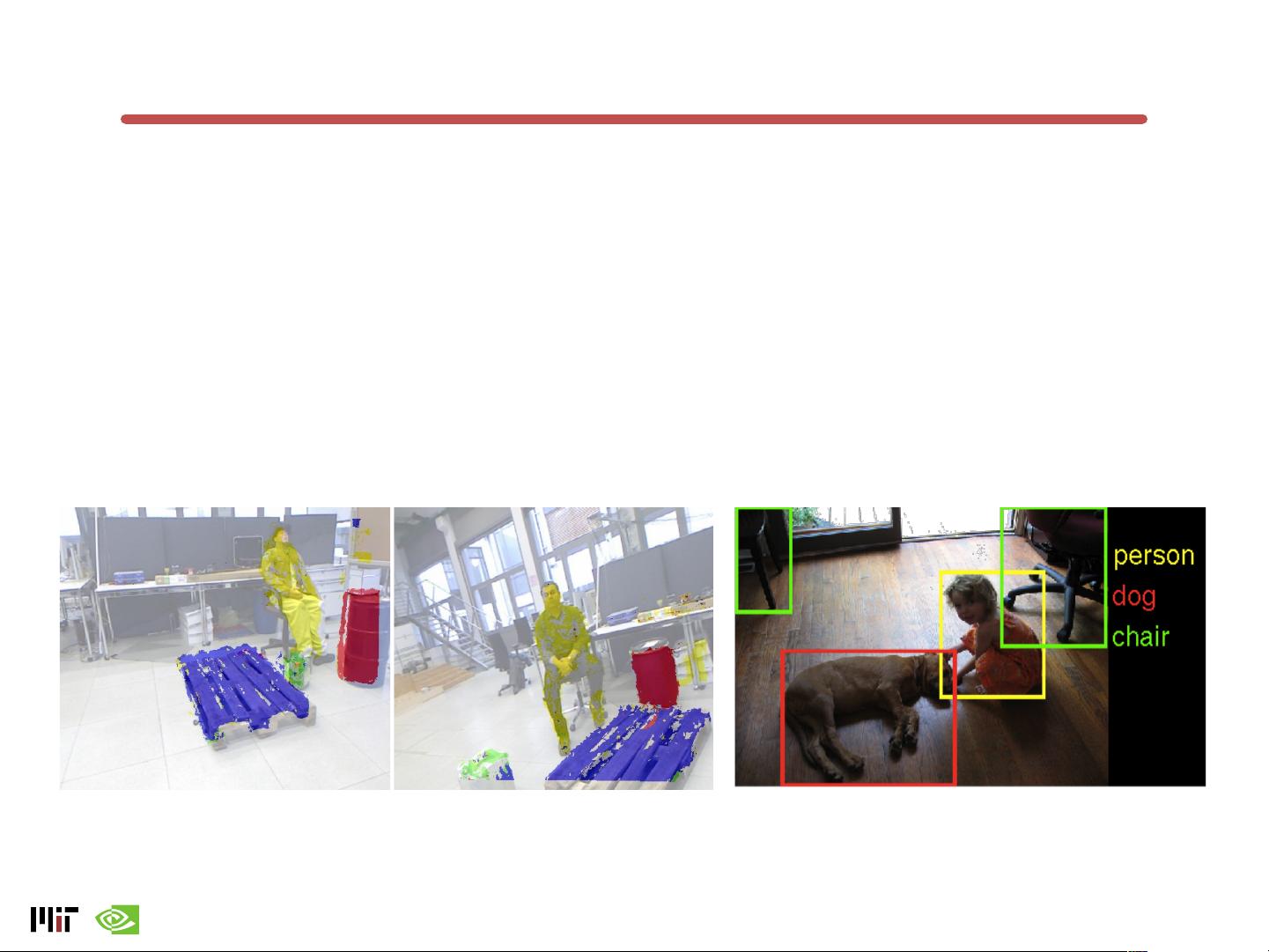

DNN是一种模仿人脑神经元工作原理的人工智能模型,通过多层非线性变换对输入数据进行建模。这些网络可以用于图像识别、语音识别、自然语言处理等复杂任务,其性能在许多领域超越了传统算法。

2. DNN开发资源:

教程可能介绍了一些用于DNN开发的工具、框架和库,如TensorFlow、PyTorch、Caffe等,它们简化了模型构建、训练和部署的过程。

3. DNN计算调查:

这部分可能讨论了DNN中的基本运算,如卷积、激活函数(ReLU、sigmoid等)、池化和全连接层的计算,以及这些运算在硬件上的实现方式。

4. DNN加速器:

DNN加速器是专门针对DNN计算优化的硬件,如FPGA(现场可编程门阵列)和ASIC(专用集成电路)。EYERISS芯片就是一种高效的DNN加速器,它优化了能量效率和计算速度,减少了内存带宽需求。

5. 网络优化:

除了硬件优化,网络结构本身也可以进行优化,如模型压缩、量化、剪枝等,以降低计算复杂性和存储需求,同时保持或提高性能。

6. 评估指标与基准测试:

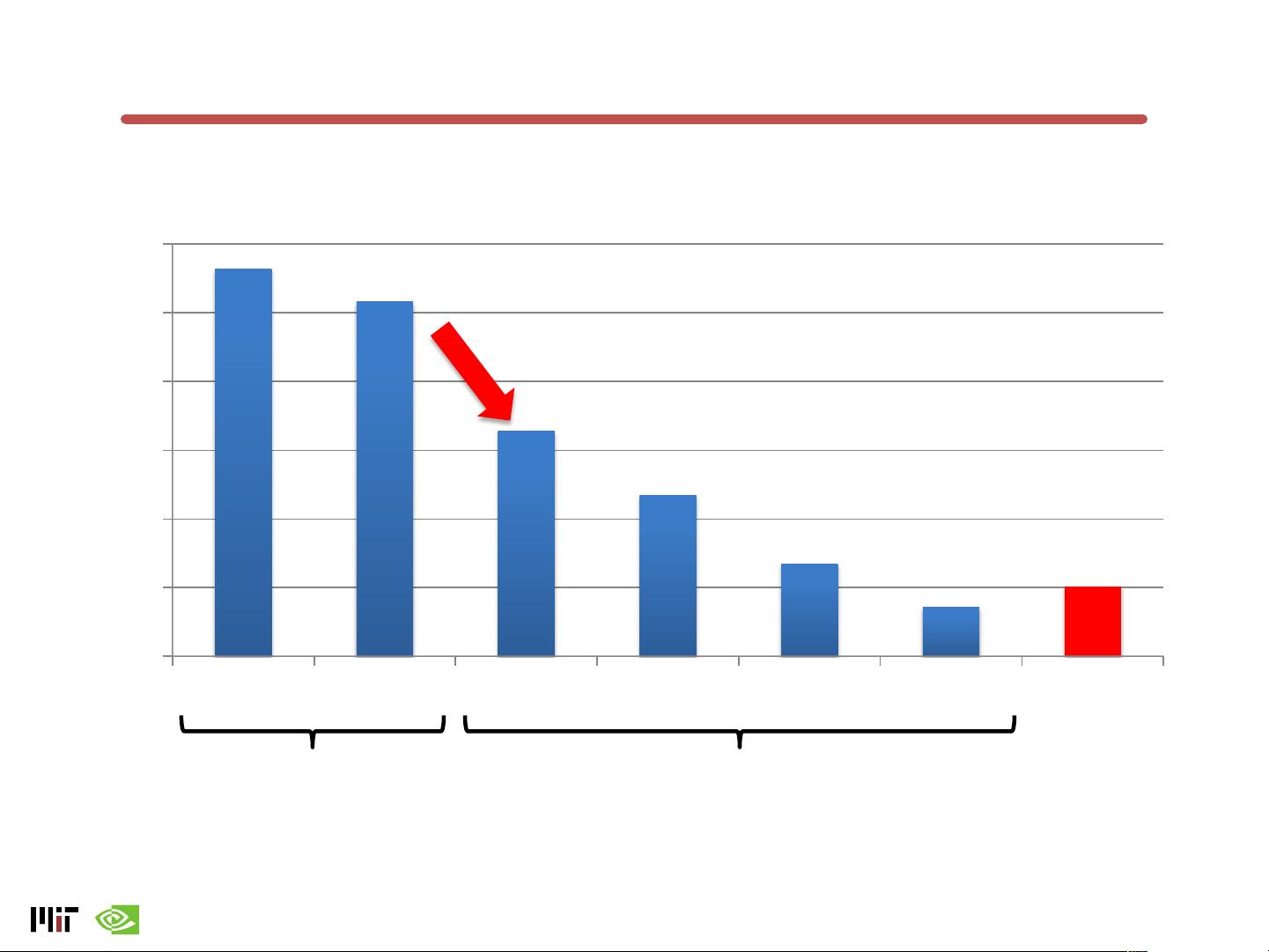

教程可能讲解了如何使用准确率、速度、能效比等指标来评估DNN硬件实现的效果,以及如何通过基准测试(如ImageNet、MNIST等)来比较不同设计方案。

7. DNN训练:

DNN训练涉及到权重初始化、优化算法(如梯度下降、Adam等)、批量大小的选择等,这部分可能探讨了如何在硬件上有效地进行训练过程。

8. 最近的趋势与机会:

讲座可能会讨论最新的研究进展,如混合精度训练、近似计算、异构计算架构等,以及未来DNN硬件设计的潜在方向和挑战。

参与者通过这个教程,将能够理解DNN设计的关键点,评估不同平台和架构的优缺点,掌握优化技术,并了解当前领域的最新趋势,从而为DNN硬件设计提供有价值的洞见。

2009-03-31 上传

2017-11-11 上传

2016-02-23 上传

点击了解资源详情

2020-02-17 上传

2020-04-25 上传

2019-01-25 上传

2024-07-14 上传

2024-01-14 上传

dengxf01

- 粉丝: 40

- 资源: 64

最新资源

- Effective C++ 第2版(中文版).pdf

- verilog+HDL.pdf

- 汇编DEBUG命令使用解析及范例大全

- Instructor’s Solution Manual

- 2010年英语考研大纲词汇

- 华为笔试题含答案 [C]

- 游戏编程之单例类与对象工厂的简单介绍与实现

- ARM嵌入式WINCE实践教程 pdf

- linux系统移植(很详细的移植文档哦) pdf

- 系统托盘Shell_NotifyIcon

- mfc实现系统托盘c++

- VERILOG快速入门

- 《计算机应用基础》习题参考答案.doc

- CC1110中文资料(无线部分)

- ExecutableLinkableFormat.pdf

- 笔记本电脑维修指导手册