东南大学EM算法课件:处理缺失值的贝叶斯分类与期望最大化方法

下载需积分: 10 | PDF格式 | 1.38MB |

更新于2024-07-22

| 42 浏览量 | 举报

本课程资料是东南大学模式识别课程中的EM算法课件,主要内容围绕隐马尔可夫模型(HMM)及其在实际问题中的应用展开。首先回顾了马尔可夫链和HMM的基本概念,包括HMM的三大核心问题:估值问题(计算状态转移概率和观测概率)、前向算法和后向算法用于序列分析,以及Viterbi算法和对数Viterbi算法用于最优路径寻找。HMM的学习问题部分介绍了如何处理缺失特征,提出了三种方法:直接丢弃、均值填充和使用期望最大化(EM)算法。

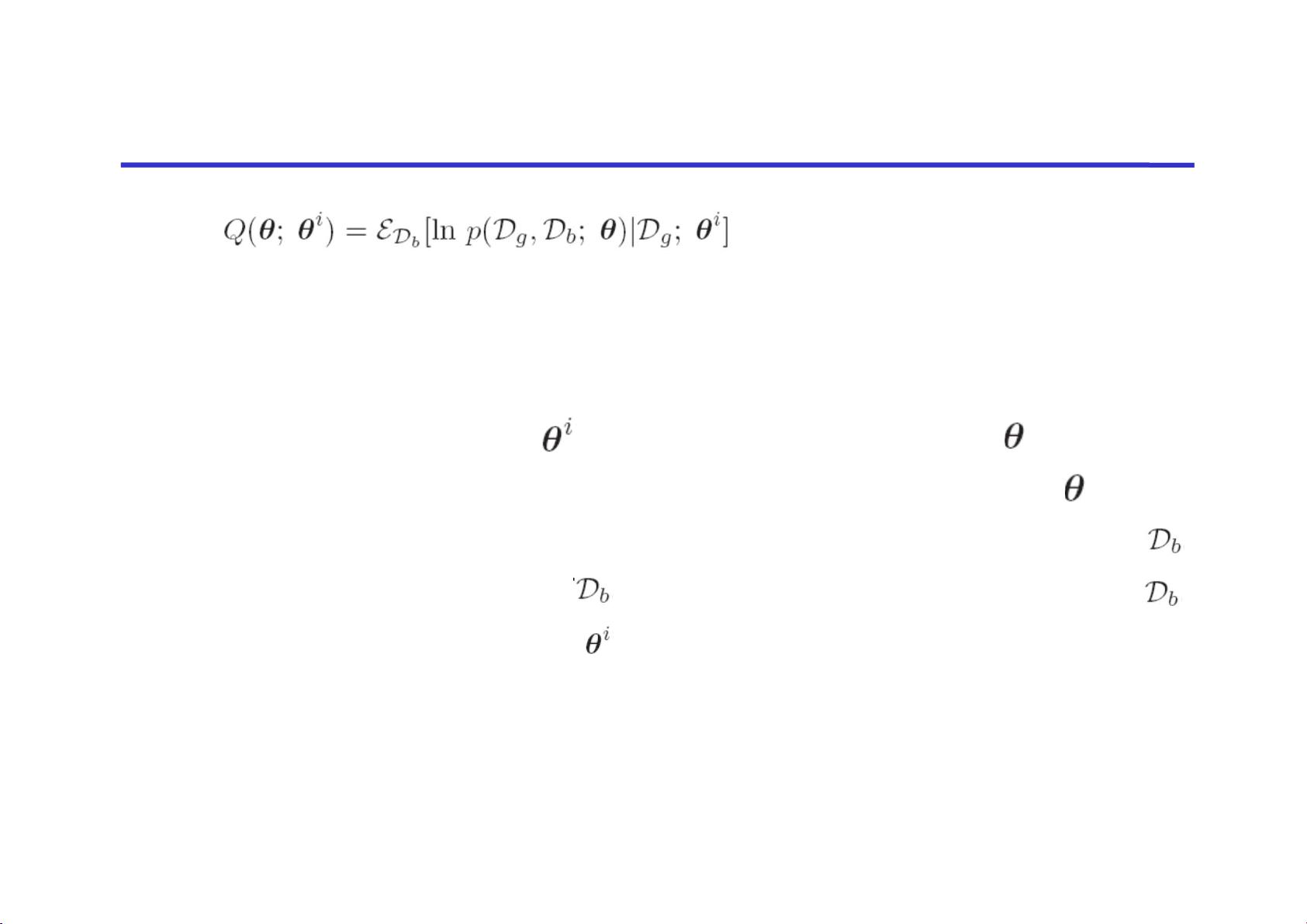

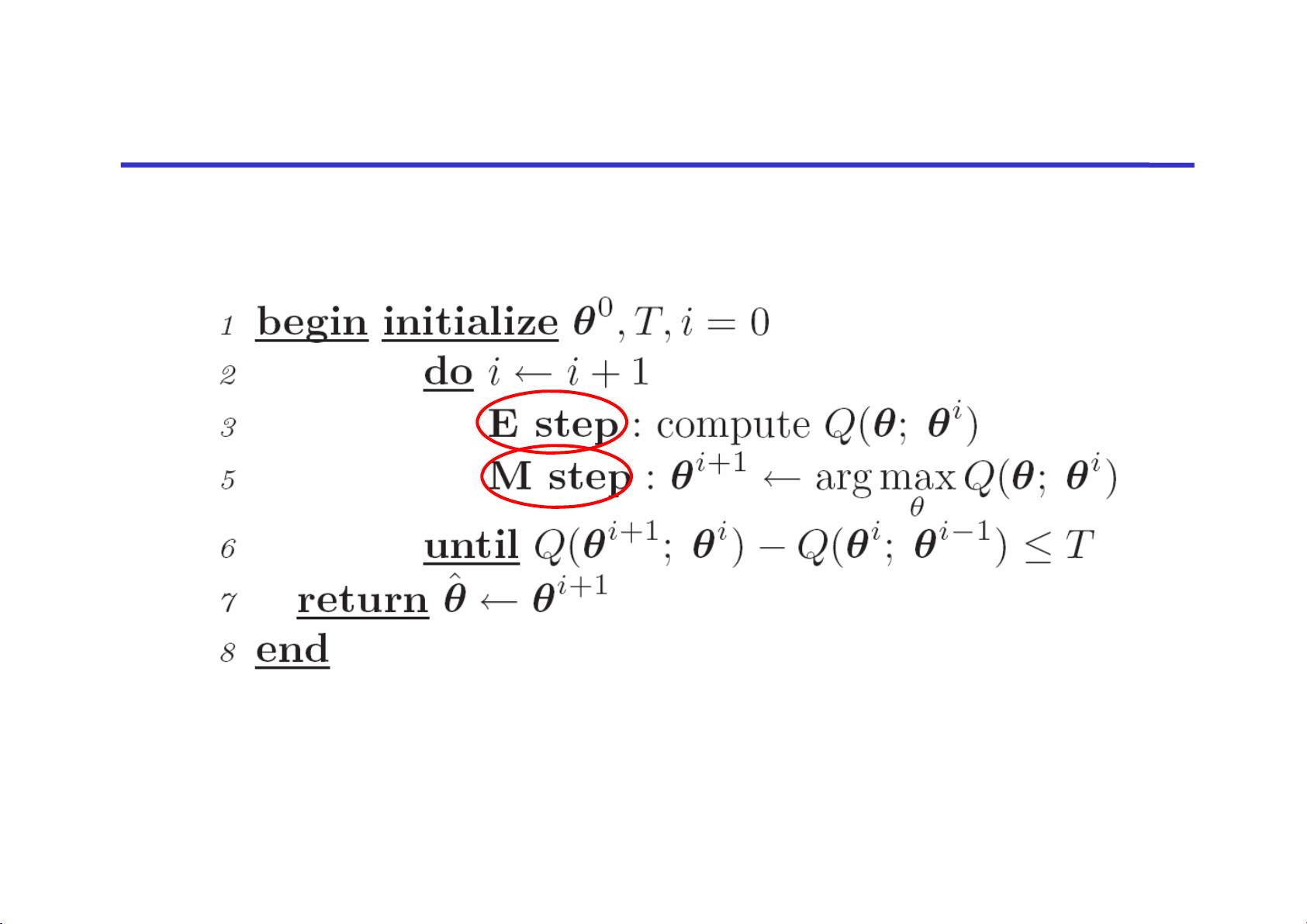

EM算法是关键部分,针对数据存在缺失值的情况,它是一种迭代优化方法,尤其适用于参数估计。在EM框架下,假设样本服从某个参数化的分布,样本集分为完整部分和缺失部分,EM算法通过以下步骤工作:首先,给定当前参数估计,计算包含缺失值的似然函数的期望值;然后,利用这个期望值更新参数,重复这个过程直到收敛。这种方法的优势在于即使数据不完整,也能在似然方程难以直接求解时,通过迭代优化找到最佳参数估计。

此外,EM算法在贝叶斯网络中的应用也被提及,尤其是在缺失证据下的置信度计算,通过贝叶斯置信网计算特征之间的条件概率。EM算法不仅限于HMM,还广泛用于如贝叶斯分类器中处理缺失特征的问题,能够有效应对数据处理中的缺失值挑战。

这门课件深入讲解了EM算法在统计建模和机器学习中的重要性,特别是解决实际问题中遇到的数据缺失情况,展示了其在提高模型性能和适应复杂数据结构方面的灵活性。学习者将掌握如何通过EM算法在有缺失数据的情况下估计和优化模型参数,这对于从事IT行业的人员来说是一项关键技能。

相关推荐

221 浏览量

li16817731

- 粉丝: 0

- 资源: 1

最新资源

- detectBrowserVisibility:检测浏览器可见性状态变化

- stomp-websocket-server:使用Spring的STOMP实现Websocket服务器

- python代码自动办公 Excel_案例_用Excel画画项目源码有详细注解,适合新手一看就懂.rar

- jQuery带备忘录功能的日期选择器特效代码

- NAS-DIP-pytorch:[ECCV 2020] NAS-DIP

- kj6682-library:我的图书馆

- Archive-1844_C++_

- 互联网站点:存储库,可扩展性或永久性

- breakout-rooms:分组讨论室附加到Jitsi Meet和Jitsi Videobridge项目中

- PHP实例开发源码-易优实验报告管理系统 PHP源码 v1.0.zip

- bikeshop:网络开发课程项目

- python代码自动办公 用Python在Excel中查找并替换数据 项目源码有详细注解,适合新手一看就懂.rar

- KonradLinkowski:我的GitHub操作配置文件README :)

- WEB1:某种html内容

- Node-Chat:建立在Node.js,Socket.io和WebRTC上的类似omegle的应用程序

- Leveon Bell HD Wallpapers Game Theme-crx插件