"本文将对大数据处理框架Spark和Flink进行深入的分析和对比,旨在揭示两者之间的关键差异,帮助读者更好地理解它们在大数据生态系统中的角色和适用场景。"

Spark和Flink都是当前大数据处理领域中的重要框架,它们各自有着独特的特性和优势。Spark以其快速的批处理、交互式查询(Spark SQL)、流处理(Spark Streaming)和机器学习(MLlib)能力而闻名,而Flink则以其强大的流处理能力、精确一次的状态一致性以及低延迟著称。

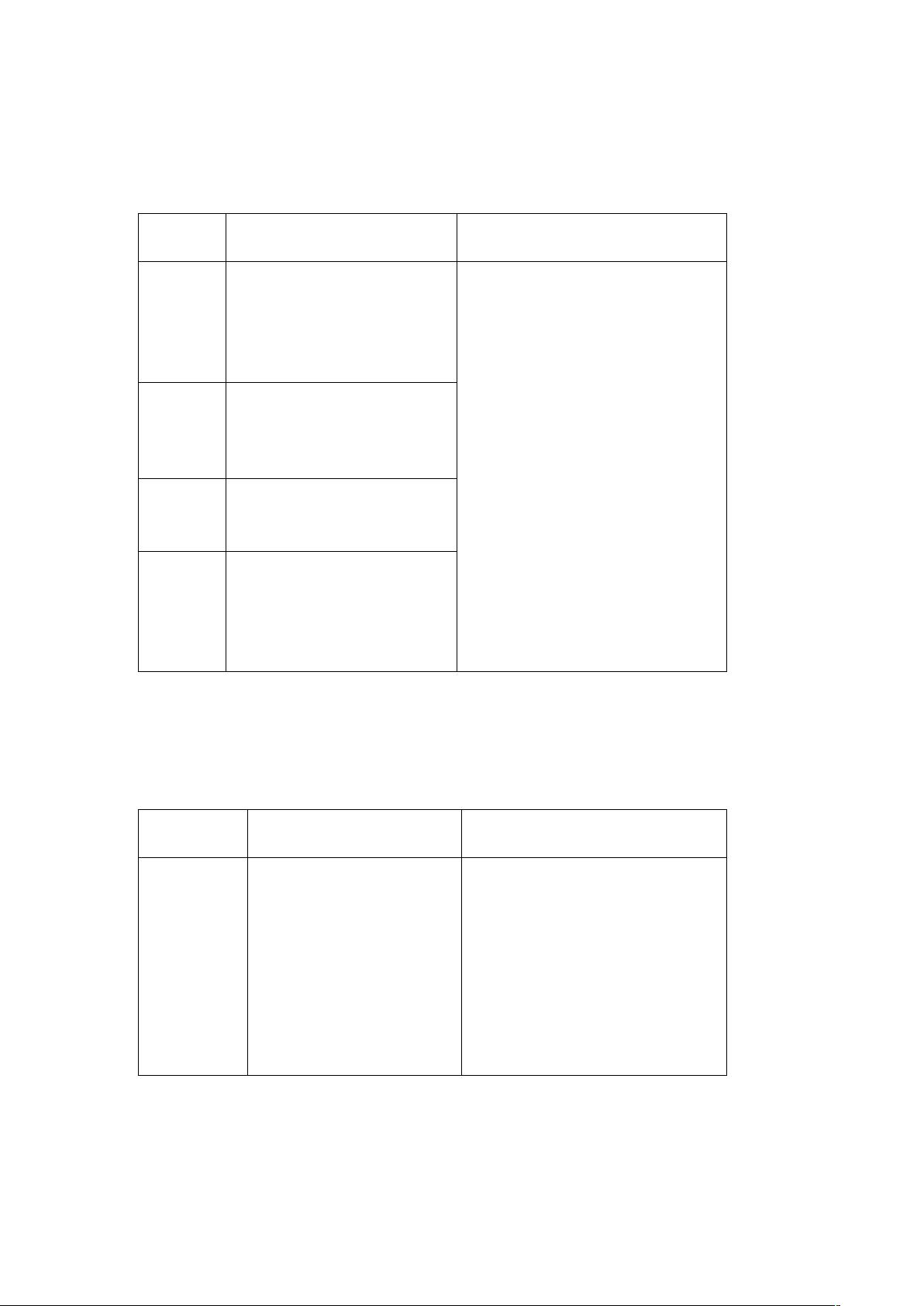

Spark的历史可以追溯到2014年,自那时起,它经历了快速的发展,不断推出新版本,优化性能和功能。从Spark 1.0.0到Spark 1.6.1,每个版本都带来了新的改进,如更高效的内存管理、更丰富的API支持和增强的稳定性。Spark的核心特性是弹性分布式数据集(Resilient Distributed Datasets, RDDs),这是一种容错的数据抽象,能够支持并行操作。此外,Spark引入了DataFrame和Dataset,进一步简化了数据处理,并提供了SQL接口,使得数据分析更加便捷。

相比之下,Flink相对较年轻,但其发展速度也非常快。从Flink 0.7.0到Flink 1.0.0,Flink逐步完善了其流处理模型和API,强调了实时处理和状态管理。Flink的核心是流数据流(DataStream)和批处理(DataSet)的概念,这使得它在处理连续数据流时具有优势。Flink的亮点之一是其事件时间处理和窗口机制,能够确保即使在乱序数据下也能提供精确一次的一致性保证。此外,Flink还提供了SQL接口(Table API)和集成机器学习库(Flink ML)。

在性能方面,Spark以其高效的内存计算和DAG执行模型而受到赞誉,适合处理大规模批处理任务。然而,在实时流处理方面,Flink通常表现出更低的延迟,因为它的架构设计更侧重于连续数据流的处理。Spark Streaming虽然也支持流处理,但其实质是微批处理,可能在延迟和状态一致性上不如Flink。

在应用场景上,Spark由于其广泛的生态支持和易用性,常被用于数据湖分析、交互式查询和机器学习等场景。而Flink因其实时处理能力,常被部署在需要低延迟响应和精确结果的场景,如金融交易监控、物联网数据分析和实时推荐系统。

Spark和Flink各有千秋,选择哪个框架取决于具体的需求。如果项目更重视交互性、批处理和广泛社区支持,那么Spark可能是更好的选择;如果需要强大的实时处理能力和精确状态一致性,Flink则更具优势。在实际应用中,理解这两个框架的差异和优缺点,可以帮助我们做出更明智的技术决策。