深度学习视角:计算机视觉中的注意力机制解析

版权申诉

"综述:计算机视觉中的注意力机制"

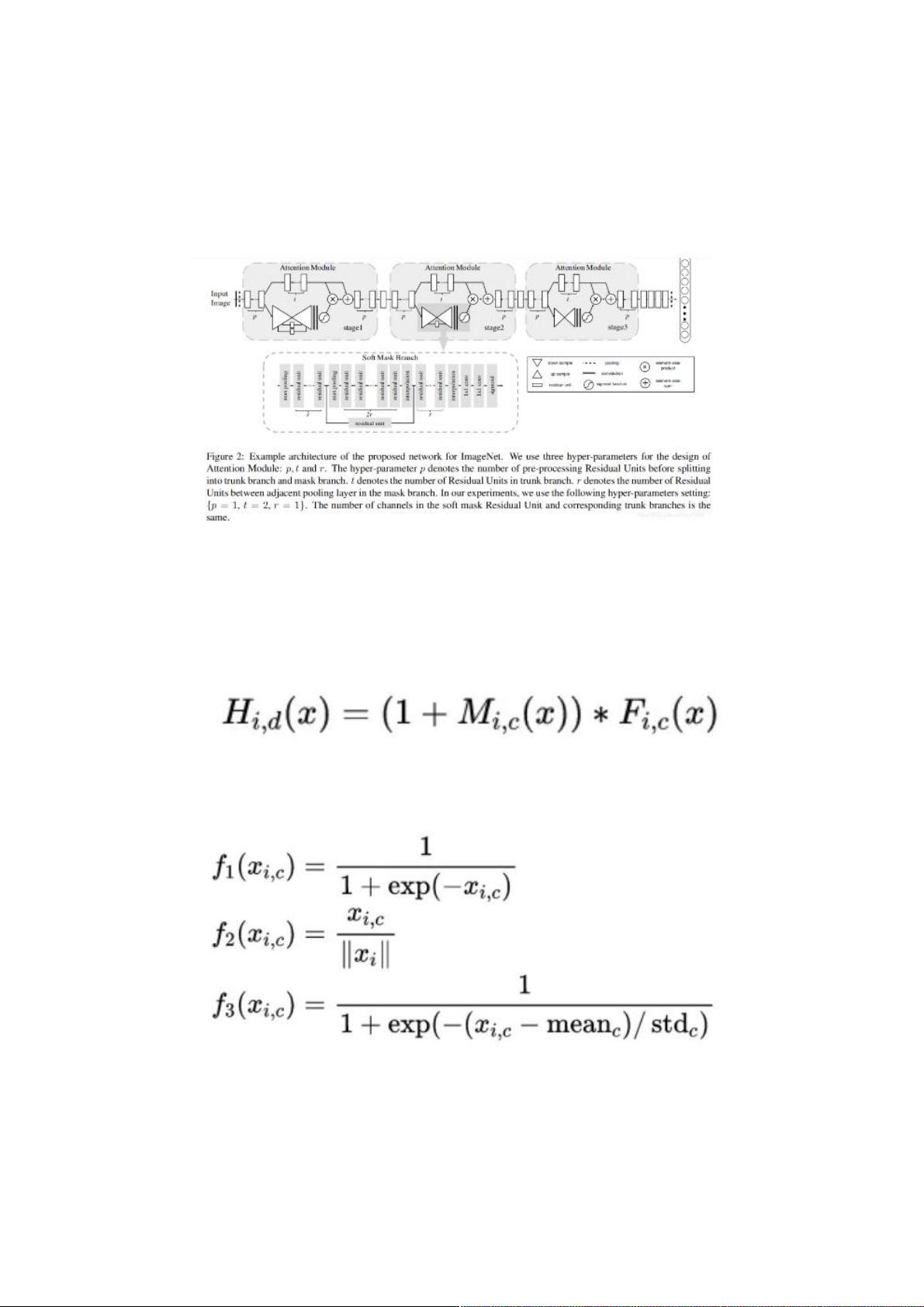

计算机视觉中的注意力机制是现代深度学习模型中一个关键的概念,它模仿人类视觉系统对特定信息的关注,帮助模型在处理大量数据时更加高效和准确。这一机制使得计算机能够从复杂的图像或视频中识别并聚焦于重要信息,而忽略不相关的背景噪声。

为什么需要视觉注意力?

在传统的计算机视觉任务中,如图像分类或物体检测,整个图像通常会被作为输入传递给神经网络。然而,对于人眼来说,我们并不需要同时处理图像的所有部分,而是会自然地将注意力集中在感兴趣的对象或区域。注意力机制引入到计算机视觉模型中,就是为了模拟这一过程,使得模型能够自动学习关注关键信息,提高识别的准确性和效率。

注意力分类与基本概念:

1. **硬注意力**(Hard Attention):这是一种二元选择,将注意力集中在某些区域,其他区域则完全忽略。它表现为0/1的决策,无法进行连续的权重分配。由于其不可微性,硬注意力通常通过强化学习方法训练。例如,图像裁剪操作可以视为一种硬注意力形式。

2. **软注意力**(Soft Attention):与硬注意力相反,软注意力使用连续的权重分布来表示对图像不同区域的关注程度,通常在0到1之间。这种注意力机制是可微的,可以直接通过反向传播优化,避免了强化学习的复杂性。然而,软注意力在计算上较为昂贵,因为它需要处理所有区域,即使一些区域对结果影响不大。

3. **高斯注意力**:这种注意力机制利用高斯分布来表示注意力权重,可以更平滑地将注意力集中在图像的特定区域,同时允许一定程度的周边信息参与。

4. **空间变换注意力**(Spatial Transformer Networks):引入了对输入的动态变换能力,允许模型自适应地调整输入的空间布局,从而更好地关注感兴趣的区域,同时降低了计算负担和过度参数化的问题。

在实际应用中,注意力机制可以用于多种任务,如图像描述生成、机器翻译、语义分割等。例如,在图像描述生成中,模型可以学习关注图像中的关键对象或事件,然后生成相应的文本描述。在机器翻译中,注意力机制帮助模型在源语言和目标语言之间建立对应关系,提高翻译质量。

总结来说,计算机视觉中的注意力机制通过模仿生物视觉系统,使模型能够智能地关注输入中的关键信息,从而在复杂环境中提高处理效率和准确性。随着深度学习技术的发展,各种类型的注意力机制将继续被研究和优化,以适应更多样化的应用场景。

12154 浏览量

1310 浏览量

108 浏览量

120 浏览量

178 浏览量

2024-11-02 上传

310 浏览量

2023-09-05 上传

weixin_38560768

- 粉丝: 5

最新资源

- 湘桥人才网:一站式人才招聘管理平台

- JavaScript评估周报告:pt-assement-week2深入解析

- C语言学习资源大汇总:教程、程序与技术文章

- 掌握OpenCV核心实例,深入图像处理

- Jquery实现二维数组无限级联动赋值功能源码解析

- 常州房产网详细介绍及房产信息资源

- phonetic-alphabet模块:实现拉丁与拼音字母转换

- MATLAB实例教程:大学生实用编程案例集

- Windows10下Redis-x64-3.0.504版本及RDM中文版安装指南

- Google Places API自动化测试:获取地点与自动完成结果

- 掌握Java开发必备:6个核心json处理jar包介绍

- 江苏宽频FLASH频道第二版下载与源代码分享

- 深入理解动态链接库隐式调用技术

- 电脑多杀软共存方案揭秘,实现安全软件并行不冲突

- 数据库学习必备:全面PPT课件合集

- 模糊控制技术在汽车悬架系统中的应用分析