NoiseGrad:提升机器学习模型解释性的噪声引入方法

190 浏览量

更新于2024-06-19

收藏 1.83MB PDF 举报

" NoiseGrad: 改进机器学习模型解释性的方法通过在权重中引入噪声"

NoiseGrad是一种创新的技术,旨在提升深度学习模型的可解释性。传统的深度神经网络(DNNs)因其强大的泛化能力和处理复杂模式的能力而被广泛应用,但同时也因其决策过程的不透明性而备受争议。在不可解释的人工智能(XAI)领域,解释模型的决策对于建立信任和确保在关键领域的安全应用至关重要。

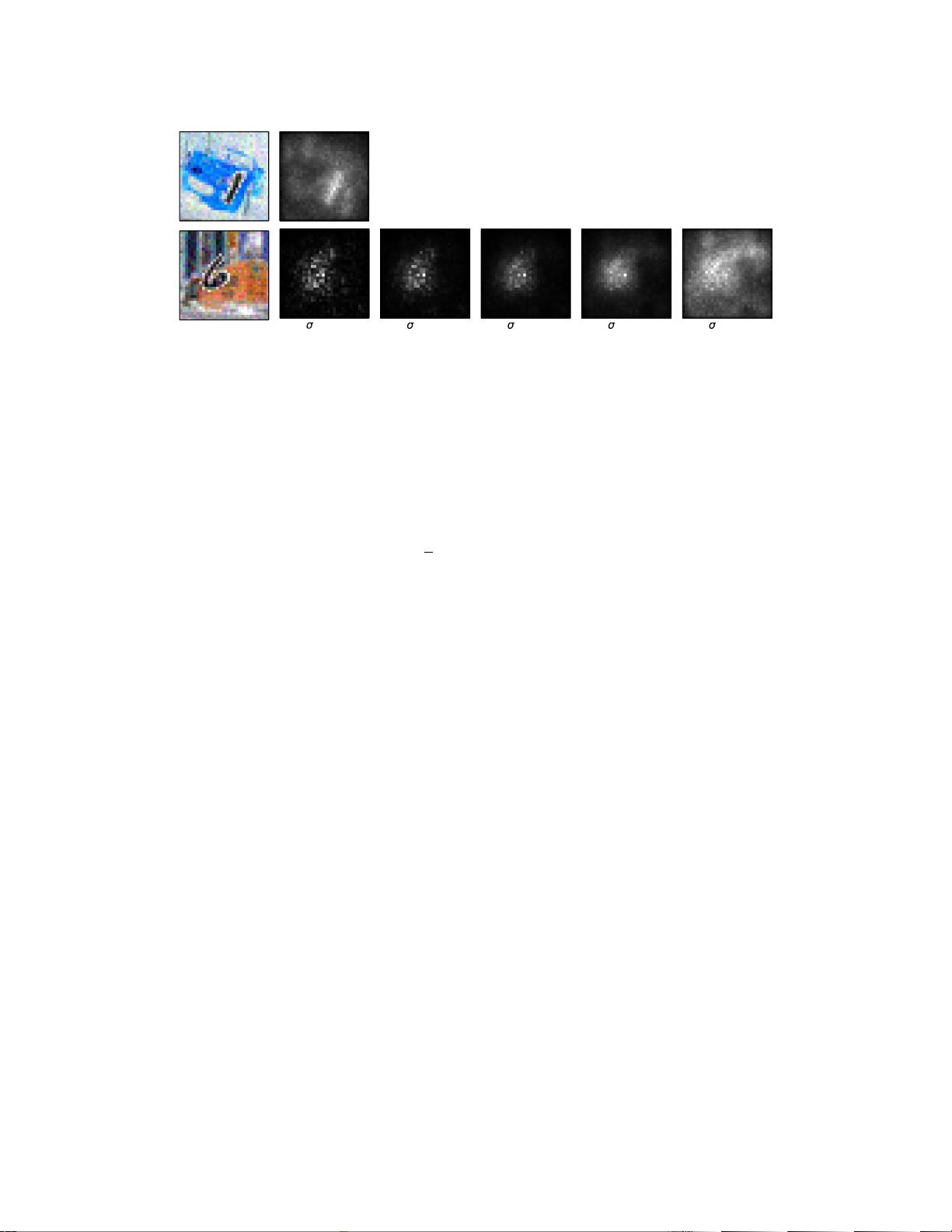

现有的归因方法,如逐层相关传播(LRP)、深度泰勒分解、分类激活映射(CAM)、GradCAM和集成梯度等,已成功用于解释单个输入的模型决策。然而,尽管这些方法有所成效,但它们仍然存在一些局限性,比如视觉扩散问题,这可能导致解释的模糊不清。

NoiseGrad方法的独特之处在于它不是在输入数据上添加噪声,而是将随机性引入模型的权重。这一策略被称为“噪声扩散”,有助于减少解释的扩散,从而提供更清晰的决策路径。NoiseGrad是方法不可知的,意味着它可以应用于各种模型和网络架构,而不仅仅是特定的解释技术。

NoiseGrad++是NoiseGrad的一个扩展,它使用乘性高斯噪声进一步优化效果。通过一系列广泛的实验,包括不同数据集、解释方法和网络结构的测试,研究发现NoiseGrad++在多个评估标准上优于SmoothGrad,表明其在提高解释质量方面的显著优势。

论文还探讨了NoiseGrad与贝叶斯学习的联系,为选择合适的超参数提供了启发式方法。这种联系揭示了噪声引入权重如何可以模拟贝叶斯后验分布,从而增加模型的不确定性理解和解释。这对于在医疗等高风险领域中负责任地使用人工智能至关重要。

NoiseGrad及其变体为改进深度学习模型的可解释性开辟了新的途径,不仅可能提高现有归因方法的效果,还有望促进未来在XAI领域的研究和发展。通过引入权重噪声, NoiseGrad为理解和信任复杂DNN的决策过程提供了更坚实的基础。

2022-08-03 上传

2023-06-03 上传

2023-08-08 上传

2023-07-12 上传

2024-07-23 上传

2023-06-09 上传

2023-09-10 上传

2023-09-04 上传

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- 前端面试必问:真实项目经验大揭秘

- 永磁同步电机二阶自抗扰神经网络控制技术与实践

- 基于HAL库的LoRa通讯与SHT30温湿度测量项目

- avaWeb-mast推荐系统开发实战指南

- 慧鱼SolidWorks零件模型库:设计与创新的强大工具

- MATLAB实现稀疏傅里叶变换(SFFT)代码及测试

- ChatGPT联网模式亮相,体验智能压缩技术.zip

- 掌握进程保护的HOOK API技术

- 基于.Net的日用品网站开发:设计、实现与分析

- MyBatis-Spring 1.3.2版本下载指南

- 开源全能媒体播放器:小戴媒体播放器2 5.1-3

- 华为eNSP参考文档:DHCP与VRP操作指南

- SpringMyBatis实现疫苗接种预约系统

- VHDL实现倒车雷达系统源码免费提供

- 掌握软件测评师考试要点:历年真题解析

- 轻松下载微信视频号内容的新工具介绍