循环神经网络基础与应用

需积分: 0 58 浏览量

更新于2024-08-05

收藏 15.92MB PDF 举报

"S5P1 循环神经网络1"

循环神经网络(Recurrent Neural Network,简称RNN)是一种能够处理序列数据的神经网络模型,它克服了传统神经网络(NN)对固定长度输入和输出的限制。在自然语言处理(NLP)和其他序列数据相关的任务中,RNN因其独特的结构而被广泛使用。

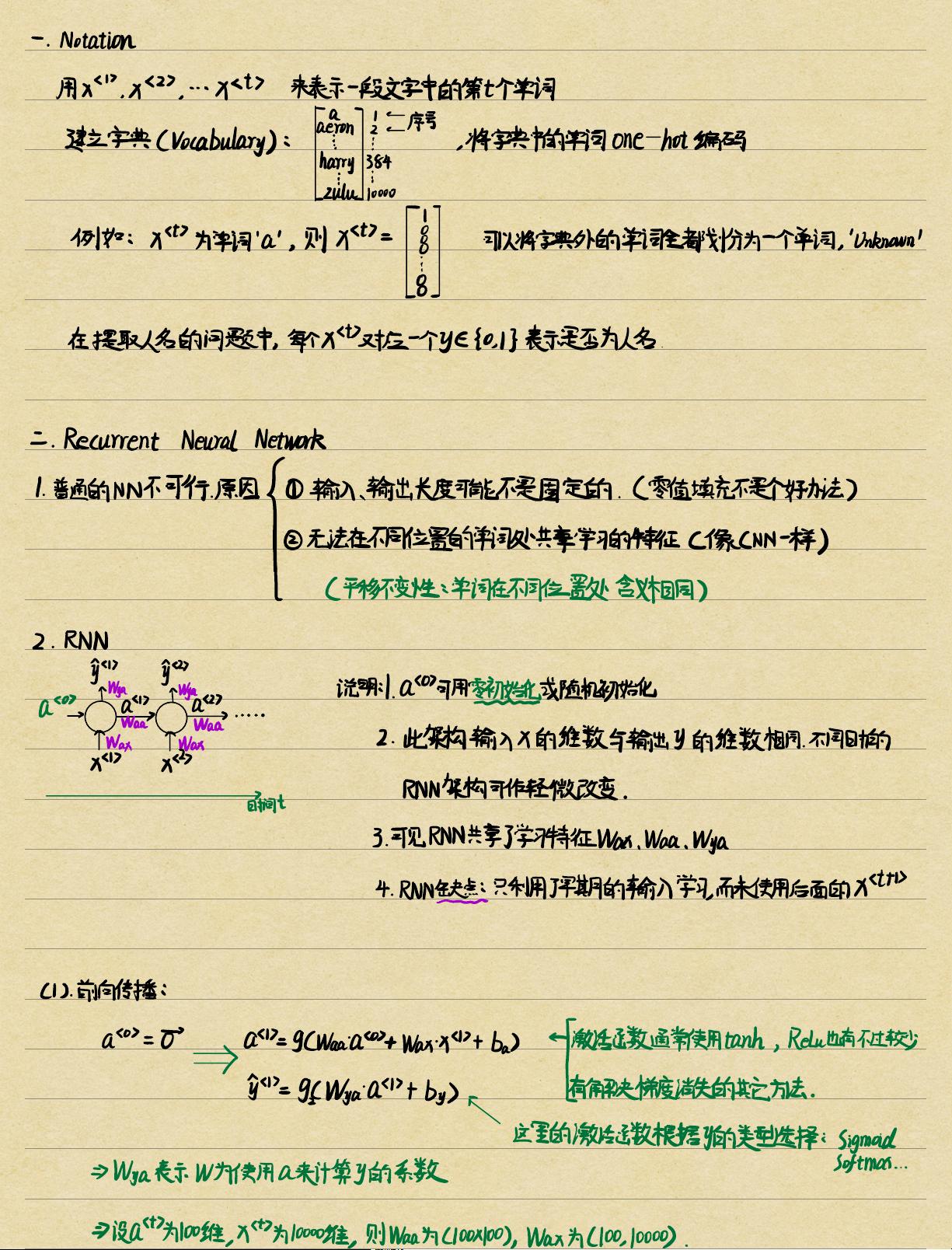

1. 符号表示与字典构建

在处理文本数据时,通常会用数字来表示单词,这个过程称为词汇表(Vocabulary)的建立。例如,我们可以为每个单词分配一个唯一的序号,并使用One-hot编码方法,将单词转换为二进制向量。对于不在字典中的单词,可以统一归类为一个特殊的单词,如“Unknown”。

2. 人名提取示例

在人名提取的问题中,RNN可以用来判断一个单词是否可能是人名。这里用-01表示某个词是否属于人名,1表示是,0表示不是。通过训练,RNN能够学习到如何识别序列中的模式以进行判断。

3. Recurrent Neural Network (RNN)

传统的NN在处理变长序列时存在困难,因为它们无法在不同位置的单词上共享学习到的特征。RNN解决了这个问题,它允许信息在时间步之间流动,即具有“记忆”功能。不同于卷积神经网络(CNN)的平移不变性,RNN在不同位置的单词可以有不同的含义,因为上下文信息会影响单词的解释。

4. RNN的结构与前向传播

RNN的基本结构包含一个隐藏层,其权重在时间步之间共享。在前向传播过程中,每个时间步的输入(如单词)会与当前隐藏状态一起传递给激活函数(如Tanh),产生新的隐藏状态,并输出结果。权重矩阵如Waa、Wax和Wya分别对应于不同的连接。

5. 梯度消失问题

RNN的一个挑战是梯度消失问题,导致远距离依赖的学习困难。为了解决这个问题,可以使用门控机制,如长短期记忆网络(LSTM)和门控循环单元(GRU)。这些结构有助于控制信息流,减轻梯度消失的影响。

6. 反向传播

在反向传播过程中,损失函数沿着时间轴进行反向传播,计算每个时间步的梯度。由于RNN的递归特性,计算通常是按照时间顺序进行的,从最后一个时间步逆向计算至第一个时间步。

RNN是一种强大的工具,尤其适用于处理序列数据的任务,如语言建模、机器翻译、情感分析等。尽管存在梯度消失问题,但通过改进的RNN结构如LSTM和GRU,以及各种优化技术,我们能够在实际应用中有效地利用RNN的优势。

2018-01-04 上传

2021-09-29 上传

2016-07-23 上传

2023-05-27 上传

2023-03-25 上传

2023-05-25 上传

2023-05-24 上传

2024-10-11 上传

2023-05-17 上传

魏水华

- 粉丝: 19

- 资源: 282

最新资源

- 开源通讯录备份系统项目,易于复刻与扩展

- 探索NX二次开发:UF_DRF_ask_id_symbol_geometry函数详解

- Vuex使用教程:详细资料包解析与实践

- 汉印A300蓝牙打印机安卓App开发教程与资源

- kkFileView 4.4.0-beta版:Windows下的解压缩文件预览器

- ChatGPT对战Bard:一场AI的深度测评与比较

- 稳定版MySQL连接Java的驱动包MySQL Connector/J 5.1.38发布

- Zabbix监控系统离线安装包下载指南

- JavaScript Promise代码解析与应用

- 基于JAVA和SQL的离散数学题库管理系统开发与应用

- 竞赛项目申报系统:SpringBoot与Vue.js结合毕业设计

- JAVA+SQL打造离散数学题库管理系统:源代码与文档全览

- C#代码实现装箱与转换的详细解析

- 利用ChatGPT深入了解行业的快速方法论

- C语言链表操作实战解析与代码示例

- 大学生选修选课系统设计与实现:源码及数据库架构