Hadoop分布式框架详解:从1.0到2.0

"这篇资料详细介绍了Hadoop,包括Hadoop 1.0和2.0的架构、编程以及部署方面,旨在深入理解这个分布式存储和计算框架。"

Hadoop是Apache软件基金会开发的一个开源框架,它允许在廉价硬件上进行大规模数据处理。此资料主要分为以下几个部分:

1. **Hadoop 1.0架构**:

Hadoop 1.0的核心由两个主要组件构成:HDFS(Hadoop Distributed File System)和MapReduce。HDFS提供了分布式文件系统,将大型数据集分割成块并分布在多台机器上。MapReduce则是一种并行处理模型,通过Map阶段将任务分解,然后在Reduce阶段进行聚合。

2. **Hadoop 1.0编程**:

开发者使用Java编写Map和Reduce函数,这些函数在Hadoop集群中运行。Map函数对输入数据进行处理,Reduce函数则整合Map的结果。在这个版本中,JobTracker负责作业调度和任务监控,TaskTracker管理节点上的任务执行。

3. **Hadoop 1.0弊端**:

Hadoop 1.0的主要问题是单点故障,因为JobTracker和NameNode都是单个的中心节点,如果它们失败,整个系统可能会受到影响。此外,数据处理效率不高,因为所有Reduce任务都要等待所有Map任务完成。

4. **Hadoop 2.0架构**:

为了克服1.0的局限性,Hadoop 2.0引入了YARN(Yet Another Resource Negotiator),将JobTracker的功能拆分成ResourceManager和ApplicationMaster,提高了资源管理和调度的效率。同时,NameNode的高可用性也被增强,可以通过备用NameNode实现。

5. **Hadoop 2.0编程**:

在Hadoop 2.0中,开发者仍然使用MapReduce,但API有所改进,支持更灵活的编程模型,如Spark和Tez,这些可以在YARN上运行,提供更高的处理速度。

6. **Hadoop 2.0部署**:

部署Hadoop 2.0涉及安装配置HDFS、YARN以及其他的生态系统组件,如Hive、Pig等。集群的扩展性和容错性是部署时的关键考虑因素。

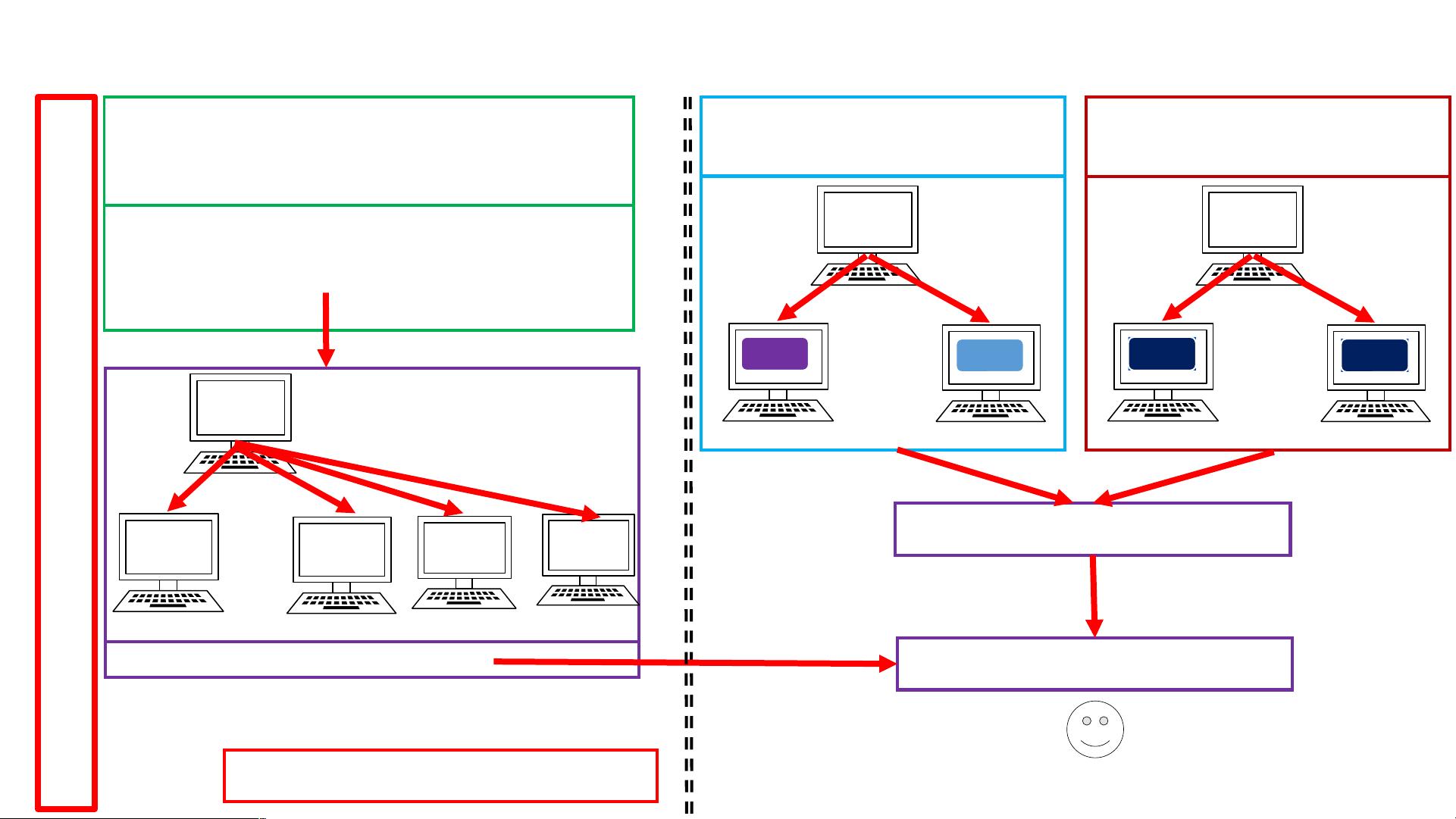

Hadoop的设计理念在于通过分布式计算解决大数据问题,提供高容错性和可扩展性。在分布式引例中,资料通过一个简单的场景展示了如何通过分布式存储和计算解决存储和计算的问题,尤其是在处理大规模数据时的优势。通过Map、Shuffle和Reduce步骤,可以有效地分发计算任务,提高处理效率,并通过数据冗余确保系统的可靠性。

2018-11-01 上传

2013-11-12 上传

2023-06-29 上传

2024-10-11 上传

2023-11-05 上传

2023-04-15 上传

2023-09-08 上传

2023-09-03 上传

2024-06-19 上传

boss0000

- 粉丝: 12

- 资源: 1

最新资源

- 新型智能电加热器:触摸感应与自动温控技术

- 社区物流信息管理系统的毕业设计实现

- VB门诊管理系统设计与实现(附论文与源代码)

- 剪叉式高空作业平台稳定性研究与创新设计

- DAMA CDGA考试必备:真题模拟及章节重点解析

- TaskExplorer:全新升级的系统监控与任务管理工具

- 新型碎纸机进纸间隙调整技术解析

- 有腿移动机器人动作教学与技术存储介质的研究

- 基于遗传算法优化的RBF神经网络分析工具

- Visual Basic入门教程完整版PDF下载

- 海洋岸滩保洁与垃圾清运服务招标文件公示

- 触摸屏测量仪器与粘度测定方法

- PSO多目标优化问题求解代码详解

- 有机硅组合物及差异剥离纸或膜技术分析

- Win10快速关机技巧:去除关机阻止功能

- 创新打印机设计:速释打印头与压纸辊安装拆卸便捷性