深度解析卷积神经网络基础:二维互相关与卷积操作详解

188 浏览量

更新于2024-08-30

1

收藏 129KB PDF 举报

卷积神经网络基础(CNN)是深度学习领域的重要组成部分,专注于处理具有网格结构的数据,如图像和视频。本文主要介绍了以下几个核心概念:

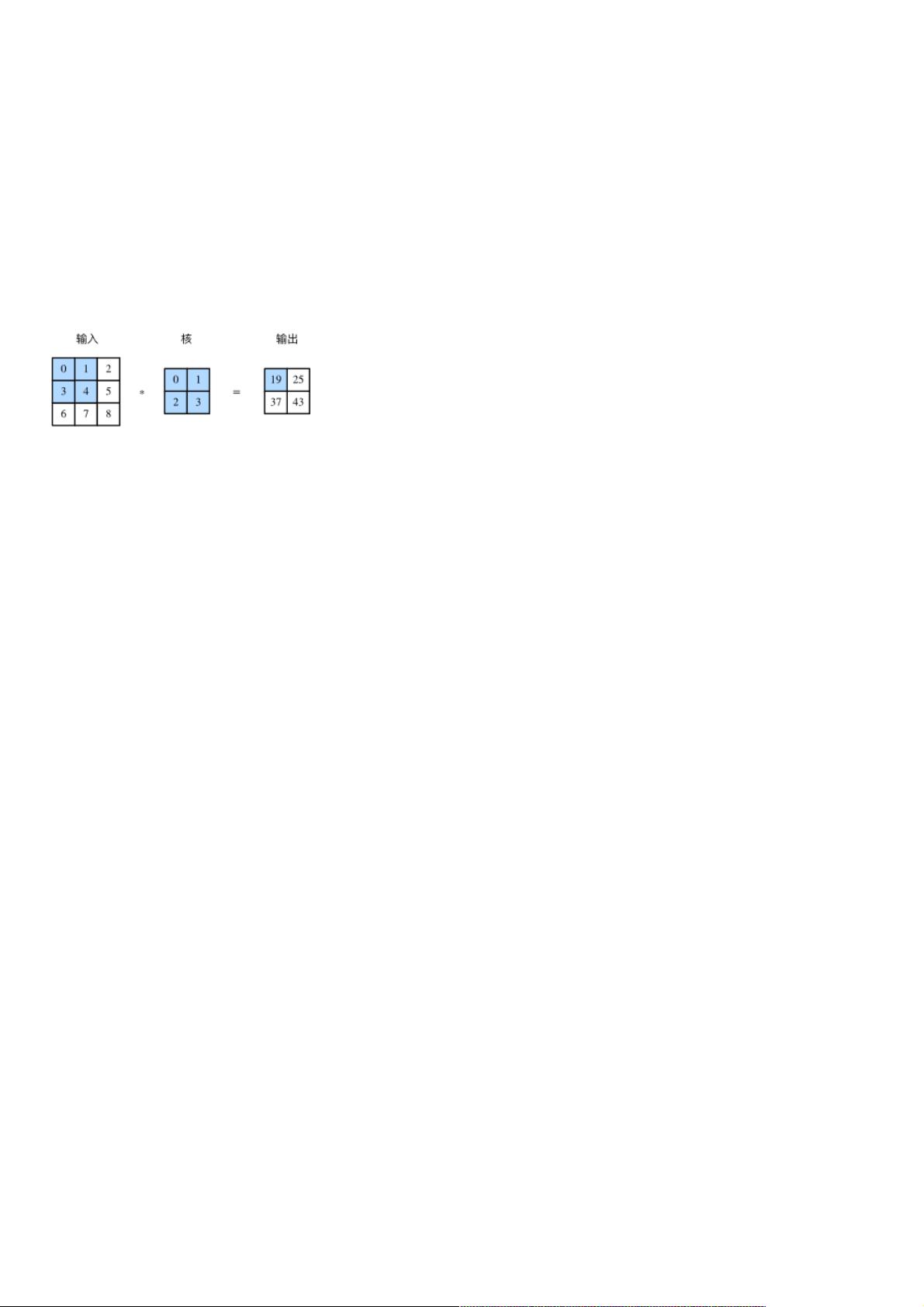

1. **二维互相关运算**:卷积层虽然名为卷积,但实际操作中更常使用的是互相关运算。在二维卷积中,一个输入数组(如3x3或(3,3)尺寸)与一个二维核(kernel)数组(如2x2大小)通过逐元素相乘并求和的方式进行运算,生成一个输出特征图,如图5.1所示。

2. **卷积层与核数组**:卷积核或过滤器是核心组件,其窗口(2x2)在输入数组上滑动,每个位置的输出值是对应窗口内输入值与核数组元素的乘积之和。例如,在图5.1中,输出数组的第一个元素计算过程为0×0+1×1+3×2+4×3=19。

3. **特征图与感受野**:输出特征图是卷积操作的结果,它展示了输入数据的不同方面被卷积核检测到的程度。感受野是指卷积核在输入上的作用范围,随着窗口在输入上移动而变化。

4. **填充和步幅**:为了控制特征图的尺寸和输出特征的细节程度,可以使用填充(padding)来增加输入的边界,而步幅(stride)则决定窗口移动的间距,这两者共同影响了卷积的过程。

5. **多输入通道和多输出通道**:在实际应用中,卷积层可能处理多个输入通道(例如RGB图像的三个通道),并且可以输出多个通道的特征图,这些通道可以用于不同的任务。

6. **1×1卷积层**:这是一种特殊的卷积,窗口大小为1x1,主要用于减小通道数量、提取特征组合或作为全连接层的替代。

7. **卷积层与全连接层的比较**:卷积层在保持局部连接性和参数共享特性的同时,减少了模型的参数数量,而全连接层则连接了所有输入单元,适合处理一维数据。

8. **池化层**:为了减少计算量、缓解过拟合和提高模型的不变性,池化层会将特征图划分为固定大小的区域,并对每个区域进行降采样,常见的有二维池化层。

9. **PyTorch实现**:文章提到了如何使用Python库PyTorch来实现卷积层和池化层的操作,这对于实际编程和理解这些概念至关重要。

通过深入理解这些基础知识,开发者能够构建和优化卷积神经网络,应用于图像分类、物体检测、语义分割等各种计算机视觉任务。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2024-03-21 上传

2023-08-30 上传

2021-05-07 上传

2022-10-26 上传

2021-01-27 上传

点击了解资源详情

weixin_38604653

- 粉丝: 3

- 资源: 946

最新资源

- C语言数组操作:高度检查器编程实践

- 基于Swift开发的嘉定单车LBS iOS应用项目解析

- 钗头凤声乐表演的二度创作分析报告

- 分布式数据库特训营全套教程资料

- JavaScript开发者Robert Bindar的博客平台

- MATLAB投影寻踪代码教程及文件解压缩指南

- HTML5拖放实现的RPSLS游戏教程

- HT://Dig引擎接口,Ampoliros开源模块应用

- 全面探测服务器性能与PHP环境的iprober PHP探针v0.024

- 新版提醒应用v2:基于MongoDB的数据存储

- 《我的世界》东方大陆1.12.2材质包深度体验

- Hypercore Promisifier: JavaScript中的回调转换为Promise包装器

- 探索开源项目Artifice:Slyme脚本与技巧游戏

- Matlab机器人学习代码解析与笔记分享

- 查尔默斯大学计算物理作业HP2解析

- GitHub问题管理新工具:GIRA-crx插件介绍