利用Spark和Docker扩展科学工具:EasyMapReduce解析

版权申诉

156 浏览量

更新于2024-06-21

收藏 18.15MB PDF 举报

"藏经阁-EasyMapReduce利用Spark和Docker扩展科学工具"

这篇内容主要探讨了如何利用现代技术,如Apache Spark和Docker,来解决科学计算工作流程中的可扩展性和隔离性问题。EasyMapReduce是一个项目,旨在简化大规模生物信息学计算的流程,通过Spark的分布式处理能力和Docker的容器化技术,实现科学工具的高效并行化和隔离运行。

首先,我们来看一下科学计算工作流程面临的主要挑战:

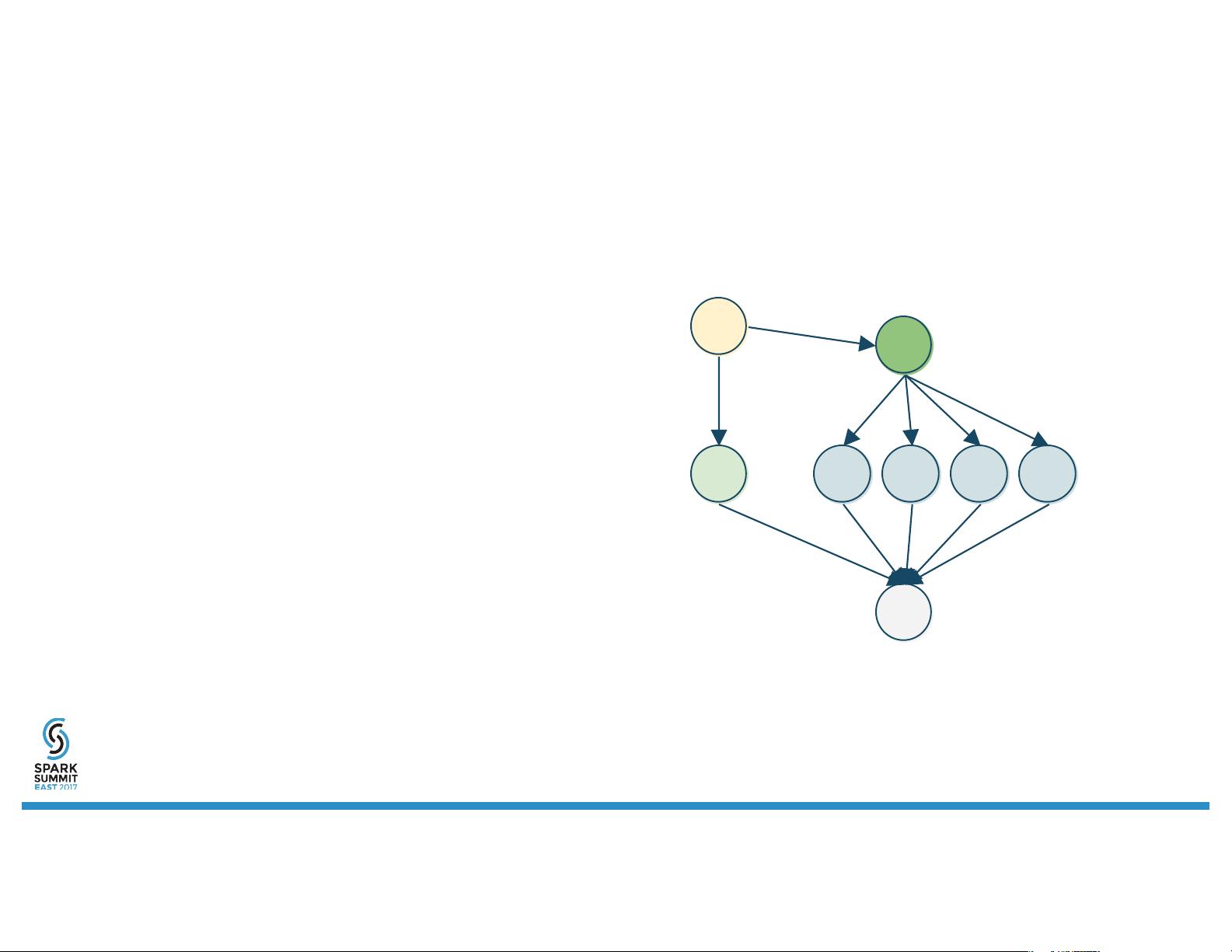

1. **工作流定义**:在科学研究中,通常需要将多个软件工具串联起来形成一个复杂的工作流。这需要清晰地定义各个步骤以及它们之间的依赖关系。

2. **现有软件的隔离和并行化**:科学计算通常依赖于特定版本的库和软件,不同工具可能有冲突。同时,为了提高计算效率,需要将这些工具并行化执行。

Docker在此处的角色是提供**应用容器**,它允许将软件及其依赖项封装在独立的环境中,确保每个工具运行时不受系统其他部分的影响。这解决了软件版本冲突的问题,并且便于在不同环境间移植。

传统的虚拟机(VM)技术通过hypervisor层实现隔离,但每个VM都包含一个完整的操作系统,这会消耗大量资源。相比之下,Docker容器共享主机操作系统,只加载运行所需的应用和库,因此启动更快,资源利用率更高。

Apache Spark则是一个用于大数据处理的开源框架,特别适合于数据密集型任务。Spark提供了一个内存计算模型,能够在集群中高效地并行处理数据,从而大幅缩短计算时间。对于可以并行化的工具,例如在Case1中提到的"trivially parallelizable tools",可以通过Spark将工具实例化并在数据的不同部分上并行运行,提高了处理速度。

最后,提到了**局部性感知调度**的概念,这是Spark的一项优化策略。它考虑了数据和计算资源的位置,尽可能将计算任务分配到数据所在的节点上,以减少数据传输,从而提升性能。

EasyMapReduce结合Spark和Docker,提供了一种有效的方式来扩展科学工具的处理能力,使得大规模数据处理变得更加便捷和高效。这种方式不仅可以简化工作流定义,还能保证软件的隔离运行,并实现资源的优化利用,尤其适合于数据密集型的生物信息学等领域。

2023-08-29 上传

2018-02-13 上传

2022-06-18 上传

2022-06-18 上传

2022-06-18 上传

2022-07-14 上传

2019-05-12 上传

2018-12-11 上传

weixin_40191861_zj

- 粉丝: 85

- 资源: 1万+

最新资源

- JHU荣誉单变量微积分课程教案介绍

- Naruto爱好者必备CLI测试应用

- Android应用显示Ignaz-Taschner-Gymnasium取消课程概览

- ASP学生信息档案管理系统毕业设计及完整源码

- Java商城源码解析:酒店管理系统快速开发指南

- 构建可解析文本框:.NET 3.5中实现文本解析与验证

- Java语言打造任天堂红白机模拟器—nes4j解析

- 基于Hadoop和Hive的网络流量分析工具介绍

- Unity实现帝国象棋:从游戏到复刻

- WordPress文档嵌入插件:无需浏览器插件即可上传和显示文档

- Android开源项目精选:优秀项目篇

- 黑色设计商务酷站模板 - 网站构建新选择

- Rollup插件去除JS文件横幅:横扫许可证头

- AngularDart中Hammock服务的使用与REST API集成

- 开源AVR编程器:高效、低成本的微控制器编程解决方案

- Anya Keller 图片组合的开发部署记录