优化算法探析:从牛顿法到Gauss-Newton型BFGS

需积分: 10 179 浏览量

更新于2024-09-09

收藏 188KB DOC 举报

"该文档主要介绍了逻辑回归模型相关的优化算法,特别是牛顿法和拟牛顿法的应用。文档没有提供源代码,重点在于理论和算法的理解。"

在机器学习领域,逻辑回归是一种广泛应用的分类算法,用于预测离散的输出结果,如二元分类问题。优化算法在逻辑回归中扮演着关键角色,以找到最优的模型参数。文档中详细讨论了两种优化方法:牛顿法和拟牛顿法。

牛顿法是一种迭代优化技术,用于求解非线性方程组。在逻辑回归的背景下,这涉及到找到使损失函数最小化的参数。牛顿法的迭代公式基于函数的雅可比矩阵(Jacobian),但当雅可比矩阵奇异时,牛顿法可能无法找到合适的方向进行更新。这是牛顿法的局限性。

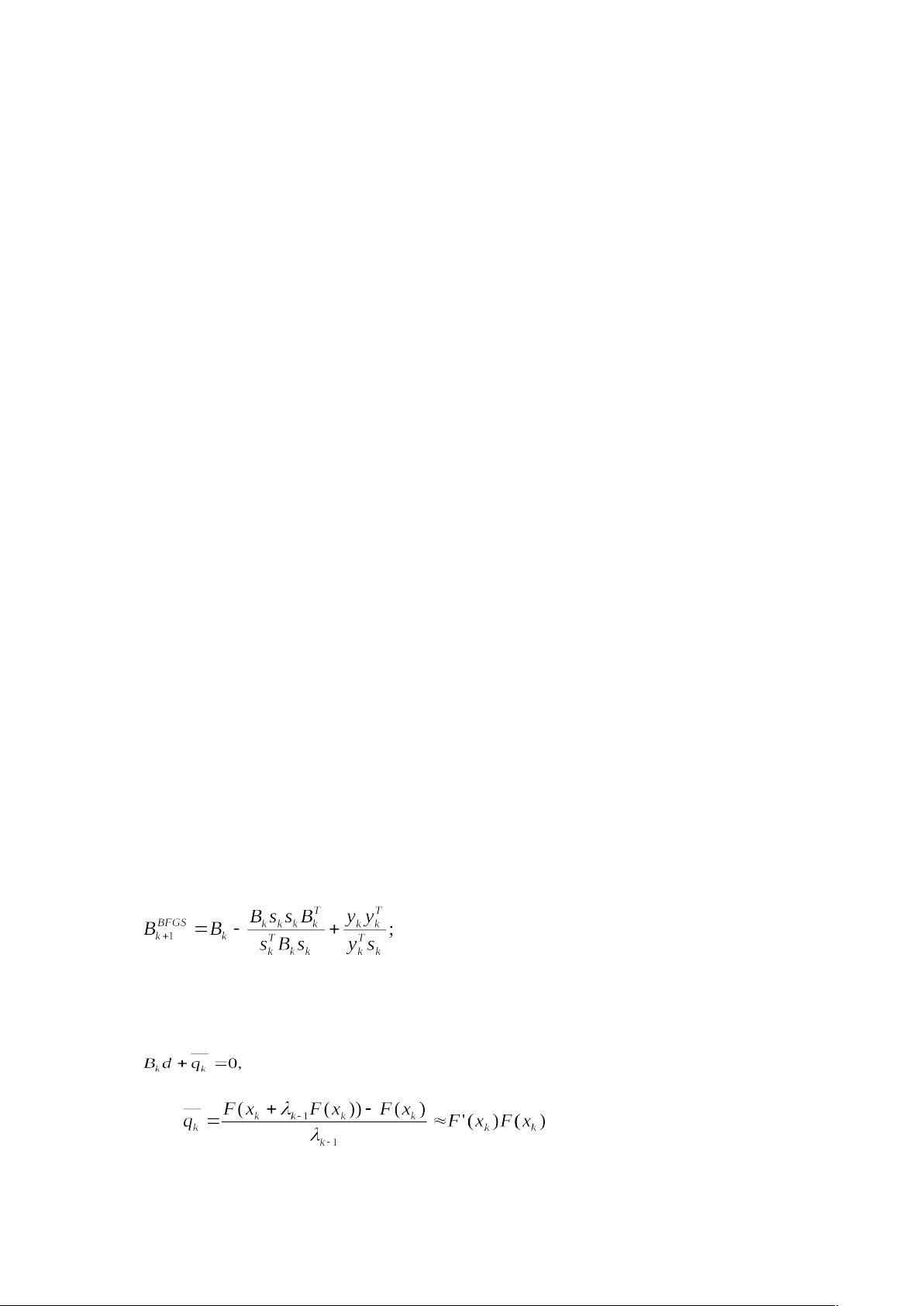

拟牛顿法正是为了解决这个问题而提出的。它不直接使用雅可比矩阵,而是通过近似矩阵来模拟其行为。常见的拟牛顿法包括Broyden秩一校正(R1)、对称秩一校正(SR1)、Davidon-Fletcher-Powell(DFP)公式和Broyden-Fletcher-Goldfarb-Shanno(BFGS)公式。其中,BFGS方法因其良好的数值稳定性和效率而被广泛使用。

1999年,Li和Fukushima提出了一种Gauss-Newton型的BFGS方法,该方法结合了Gauss-Newton法和BFGS的优点,适用于解决无约束优化问题。这种方法的拟牛顿方向由特定的方程决定,同时保持了拟牛顿方程的性质。

2003年,Gu等人进一步发展了这一思想,提出了适用于对称非线性方程组的保守和修正的Gauss-Newton型BFGS方法。这些方法考虑了范数下降的线性搜索,确保了全局收敛性,尤其适用于大型问题的求解,因为它们在计算和存储方面的要求相对较低。

这份文档深入探讨了逻辑回归模型的优化策略,特别是牛顿法和拟牛顿法的变体,对于理解和应用这些算法解决实际问题具有重要的参考价值。虽然没有提供源代码,但理论知识的详尽阐述对于理解这些优化技术的工作原理至关重要。

2019-11-15 上传

2023-09-13 上传

2023-07-21 上传

2021-02-27 上传

2013-10-30 上传

2021-02-22 上传

2024-07-18 上传

2021-10-03 上传

2024-02-06 上传

bakangs1

- 粉丝: 0

- 资源: 1

最新资源

- 构建基于Django和Stripe的SaaS应用教程

- Symfony2框架打造的RESTful问答系统icare-server

- 蓝桥杯Python试题解析与答案题库

- Go语言实现NWA到WAV文件格式转换工具

- 基于Django的医患管理系统应用

- Jenkins工作流插件开发指南:支持Workflow Python模块

- Java红酒网站项目源码解析与系统开源介绍

- Underworld Exporter资产定义文件详解

- Java版Crash Bandicoot资源库:逆向工程与源码分享

- Spring Boot Starter 自动IP计数功能实现指南

- 我的世界牛顿物理学模组深入解析

- STM32单片机工程创建详解与模板应用

- GDG堪萨斯城代码实验室:离子与火力基地示例应用

- Android Capstone项目:实现Potlatch服务器与OAuth2.0认证

- Cbit类:简化计算封装与异步任务处理

- Java8兼容的FullContact API Java客户端库介绍