神经网络基础:从M-P神经元模型到正则化

需积分: 0 6 浏览量

更新于2024-08-04

收藏 1.24MB DOCX 举报

"本文主要介绍了神经网络的基本概念和神经元模型,强调了正则化在防止过拟合中的重要作用,并简述了M-P神经元模型的结构和激活函数的使用,特别是Sigmoid函数的特性。"

在机器学习领域,神经网络是一种模仿生物神经系统的结构和功能的模型,用于处理各种复杂的学习任务。正则化是神经网络中一个至关重要的概念,其目的是通过在损失函数中加入惩罚项来控制模型的复杂度,避免过拟合现象。在训练过程中,正则化使网络在试图最小化预测误差的同时,也要最小化权重参数的大小,从而达到平衡模型性能和泛化能力的效果。

神经网络的基本组成单元是神经元,它们通过复杂的连接方式形成网络。生物神经元具有树突、轴突和细胞体等结构,而在数学模型中,神经元被简化为M-P神经元模型。这个模型接受多个输入信号,每个信号都带有相应的权重,这些加权后的输入信号汇总后与神经元的阈值进行比较。如果总输入超过阈值,神经元会输出一个信号,否则不输出。

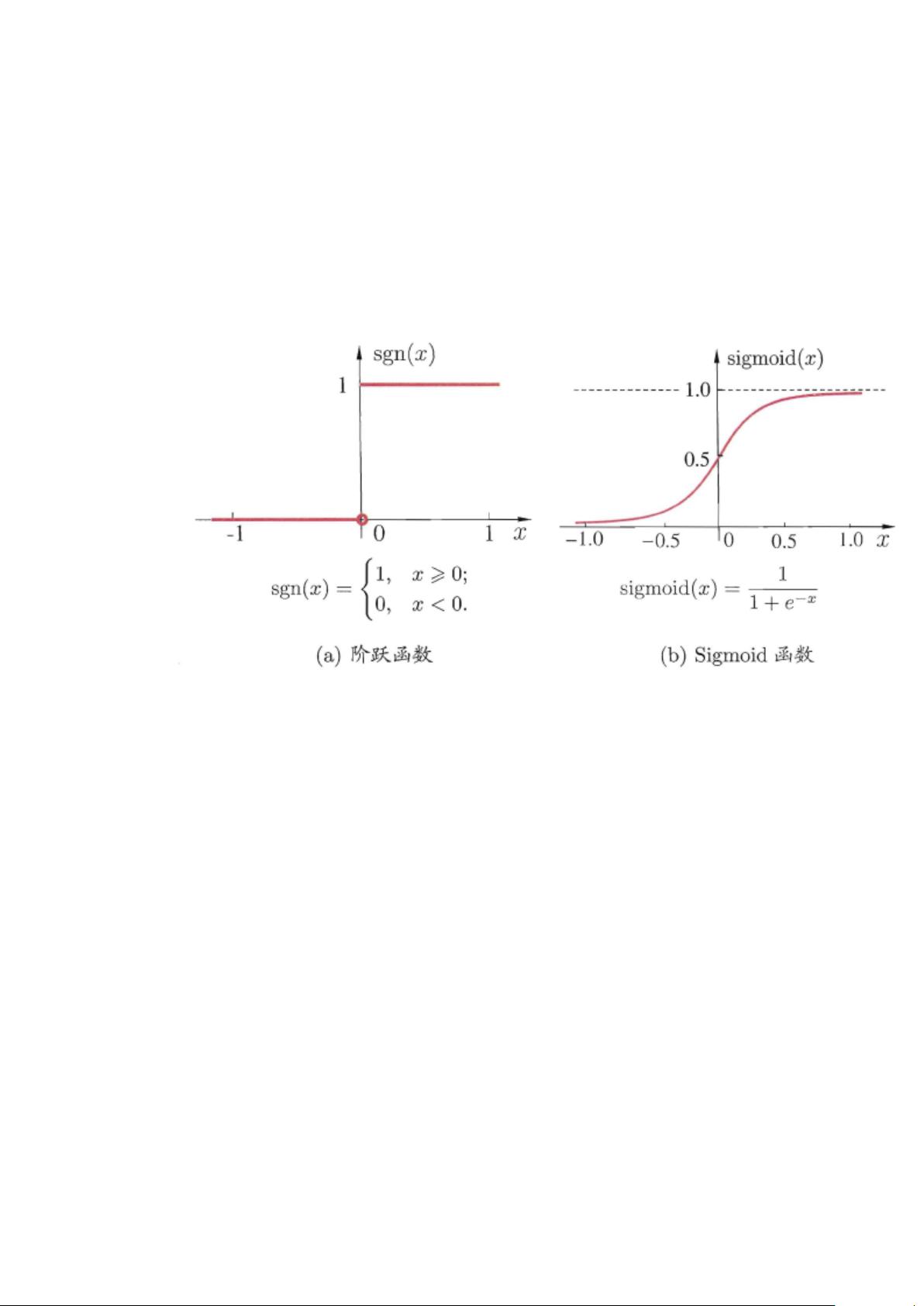

激活函数在神经元模型中起到关键作用,它决定了神经元何时被激发。早期的M-P神经元模型使用了阶跃函数,但由于其非连续性和不光滑性,实际应用中往往采用Sigmoid函数作为替代。Sigmoid函数可以将实数范围内的输入值压缩到(0,1)之间,提供了连续且可微的输出,有利于网络的梯度下降优化过程。

Sigmoid函数的输出值可以解释为神经元的激活程度或概率,对于二分类问题,0.5通常作为分类的阈值。然而,Sigmoid函数在输入接近正负无穷时导数值非常小,可能导致梯度消失的问题,因此在现代深度学习中,人们更倾向于使用ReLU(Rectified Linear Unit)及其变种,如Leaky ReLU和ELU,这些激活函数在解决梯度消失问题上表现更好。

神经网络通过正则化和合理的神经元模型来实现高效学习和泛化,而激活函数的选择则直接影响网络的表达能力和训练效果。随着研究的深入,神经网络模型和理论不断发展,如深度学习、卷积神经网络和循环神经网络等,为各种复杂问题的解决提供了强大的工具。

2021-09-21 上传

2022-08-08 上传

2022-08-04 上传

2022-08-03 上传

2022-08-03 上传

2022-07-14 上传

2022-07-15 上传

忧伤的石一

- 粉丝: 31

- 资源: 332

最新资源

- Aspose资源包:转PDF无水印学习工具

- Go语言控制台输入输出操作教程

- 红外遥控报警器原理及应用详解下载

- 控制卷筒纸侧面位置的先进装置技术解析

- 易语言加解密例程源码详解与实践

- SpringMVC客户管理系统:Hibernate与Bootstrap集成实践

- 深入理解JavaScript Set与WeakSet的使用

- 深入解析接收存储及发送装置的广播技术方法

- zyString模块1.0源码公开-易语言编程利器

- Android记分板UI设计:SimpleScoreboard的简洁与高效

- 量子网格列设置存储组件:开源解决方案

- 全面技术源码合集:CcVita Php Check v1.1

- 中军创易语言抢购软件:付款功能解析

- Python手动实现图像滤波教程

- MATLAB源代码实现基于DFT的量子传输分析

- 开源程序Hukoch.exe:简化食谱管理与导入功能