深度学习集成:探索与前景

150 浏览量

更新于2024-06-17

收藏 1.79MB PDF 举报

"集成深度学习研究综述:机遇与挑战"

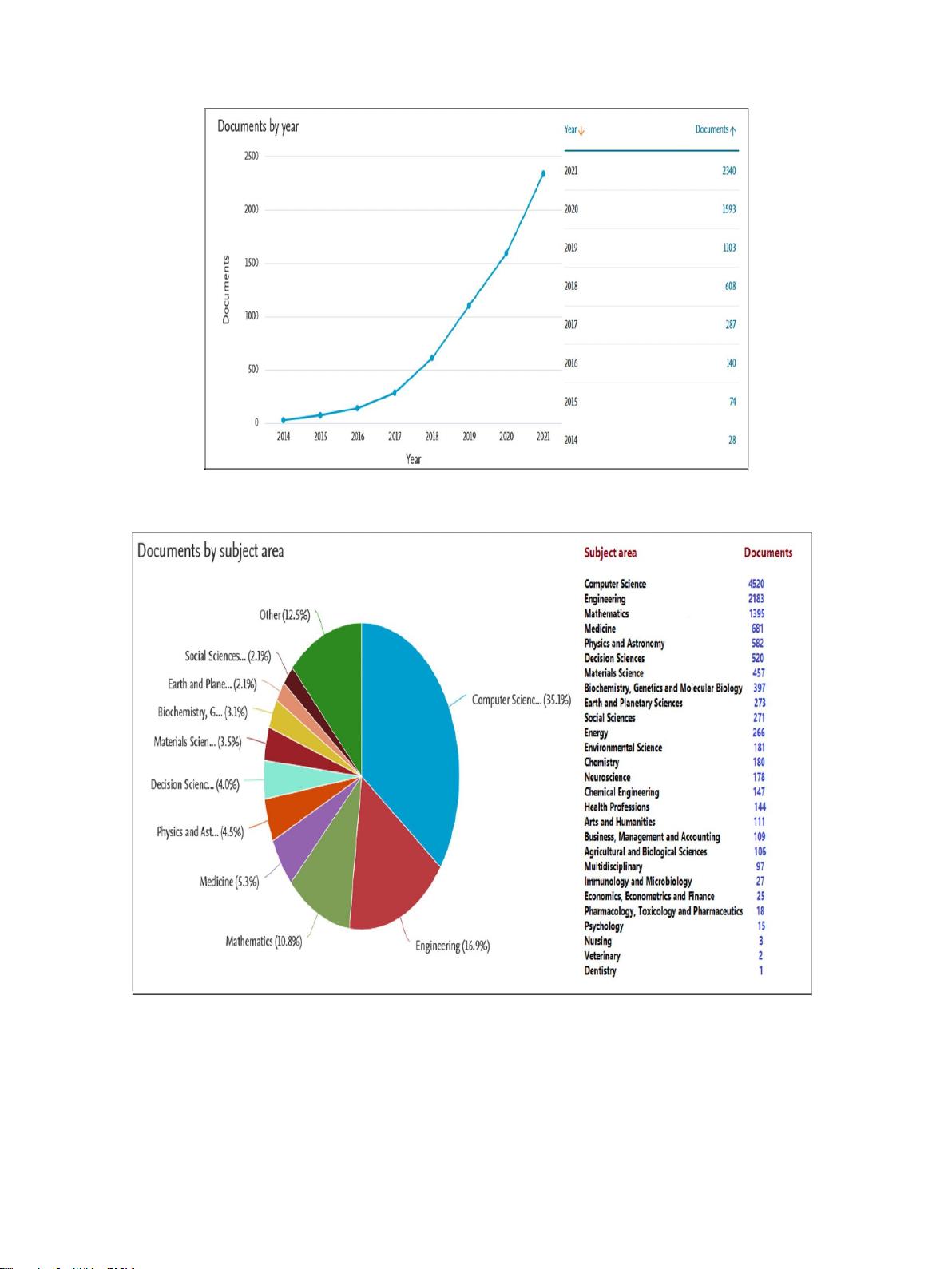

集成深度学习是当前机器学习领域的一个热门话题,它结合了集成学习和深度学习的优势,旨在解决深度学习模型中的一些固有问题,如超参数调优的需求大、计算资源消耗高以及模型泛化能力的提升。本文对集成深度学习进行了全面的研究综述,探讨了其潜在的机会和面临的挑战。

集成学习是一种通过合并多个弱预测器以创建强预测器的技术,这种方法通常能提高模型的稳定性和准确性。其成功的关键因素包括基线模型的训练策略和融合策略。在数据采样方面,有各种方法如自助采样(bootstrapping)、过采样和欠采样,用于创建不同的训练集,从而促进模型多样性。在训练基线分类器时,可以采用并行或序列的方式,每个模型可能具有不同的初始化权重或结构。而融合方法则涵盖了投票法(如硬投票和软投票)和元学习法,通过整合不同模型的预测结果来提升整体性能。

包围方法是集成学习中的一个重要分支,其目标是通过构建多样化的模型集合来包围目标函数的解决方案空间。其中,装袋(bagging)通过随机子样本创建多样性,提升模型稳定性;增强(boosting)通过逐步加强弱模型,使其聚焦于先前模型犯错的数据点;而堆叠(stacking)则采用元学习思想,利用一个额外的层来学习不同模型的权重,进一步优化集成。

文章详细分析了集成学习在深度学习环境中的应用,强调了深度学习模型在图像识别、自然语言处理、语音识别等多个领域取得的重大进展。然而,深度学习的复杂性和需要大量手动调整的超参数仍然是阻碍其广泛应用的难题。因此,集成深度学习的出现旨在通过集成策略减轻这些负担,实现模型性能的提升。

集成深度学习的研究涵盖了各种创新方法,如深度学习模型的并行或串联集成、动态集成以及基于模型的深度学习架构设计等。这些方法在保持深度学习的灵活性和表达能力的同时,利用集成学习的原理来增强模型的泛化能力和鲁棒性。尽管已取得一些进展,但集成深度学习仍然面临许多挑战,包括如何有效地组合多种深度模型、如何减少计算成本以及如何在有限数据条件下实现良好性能。

集成深度学习是一个充满机遇与挑战的前沿领域,它为机器学习提供了新的视角和解决方案,有望在未来推动人工智能技术的发展。研究人员将继续探索新的集成策略,以应对大数据时代下模型复杂性和计算效率的平衡问题,以及如何在实际应用中更好地发挥深度学习和集成学习的协同效应。

243 浏览量

120 浏览量

214 浏览量

146 浏览量

点击了解资源详情

336 浏览量

133 浏览量

172 浏览量

cpongm

- 粉丝: 5

最新资源

- Tejartchi字体:一种新型的字体设计风格

- 微信红包背后的算法原理与Python实现解析

- 掌握Dijkstra算法:Java实现路径最短计算

- 基于QT的FTP服务器与客户端实现教程

- 支持通用指令的micromark扩展实现细节

- Android UI设计:学习与分享漂亮的界面

- Technovia字体:全新的设计与应用

- 网易云信IM服务端Java实现:完整消息功能支持

- Android圆形圆角控件实现与自定义技巧

- 实现ES2019规范的String.prototype.trimEnd的polyfill

- 企业文化建设:公司图书馆与信息中心PPT要点解析

- havash:PHP 实现的高效密码散列方案

- 基于CycleGAN的图像转换系统实现与示例分析

- Visual Studio Code 1.52.0版32位安装包发布

- Nuxt.js动态文档实现技术探究

- 安卓图片圆角裁剪工具与代码简化教程