深度学习基础:从神经网络到深度学习解析

需积分: 5 164 浏览量

更新于2024-07-15

2

收藏 8.65MB PPTX 举报

"从神经网络到深度学习.pptx"

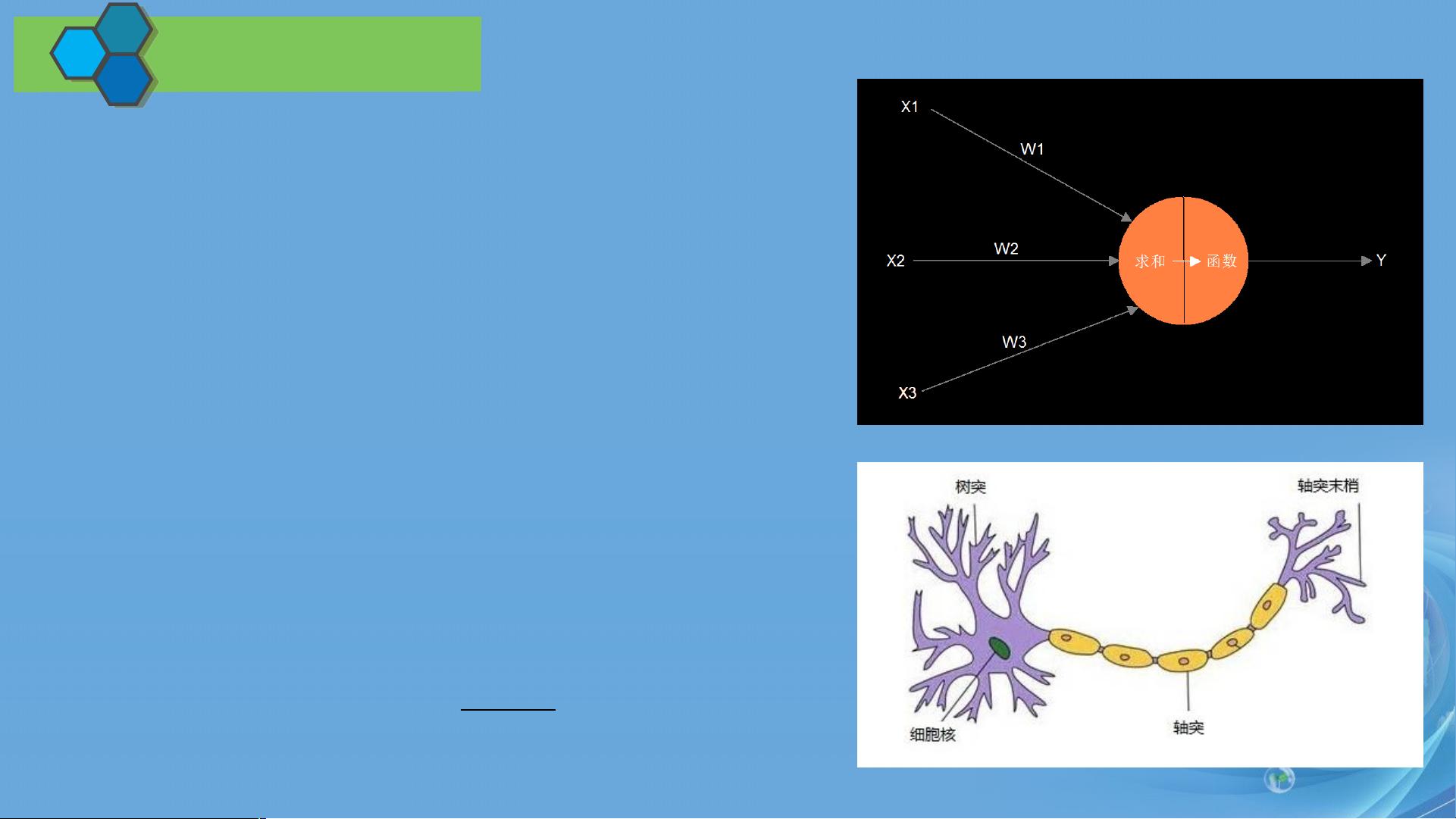

这篇资料深入浅出地介绍了神经网络的基本概念和深度学习的原理。神经网络,作为人工智能领域的重要组成部分,是模拟生物大脑神经元工作方式的一种计算模型。它由众多的处理单元——神经元构成,这些神经元之间通过权重连接,形成了复杂的网络结构。

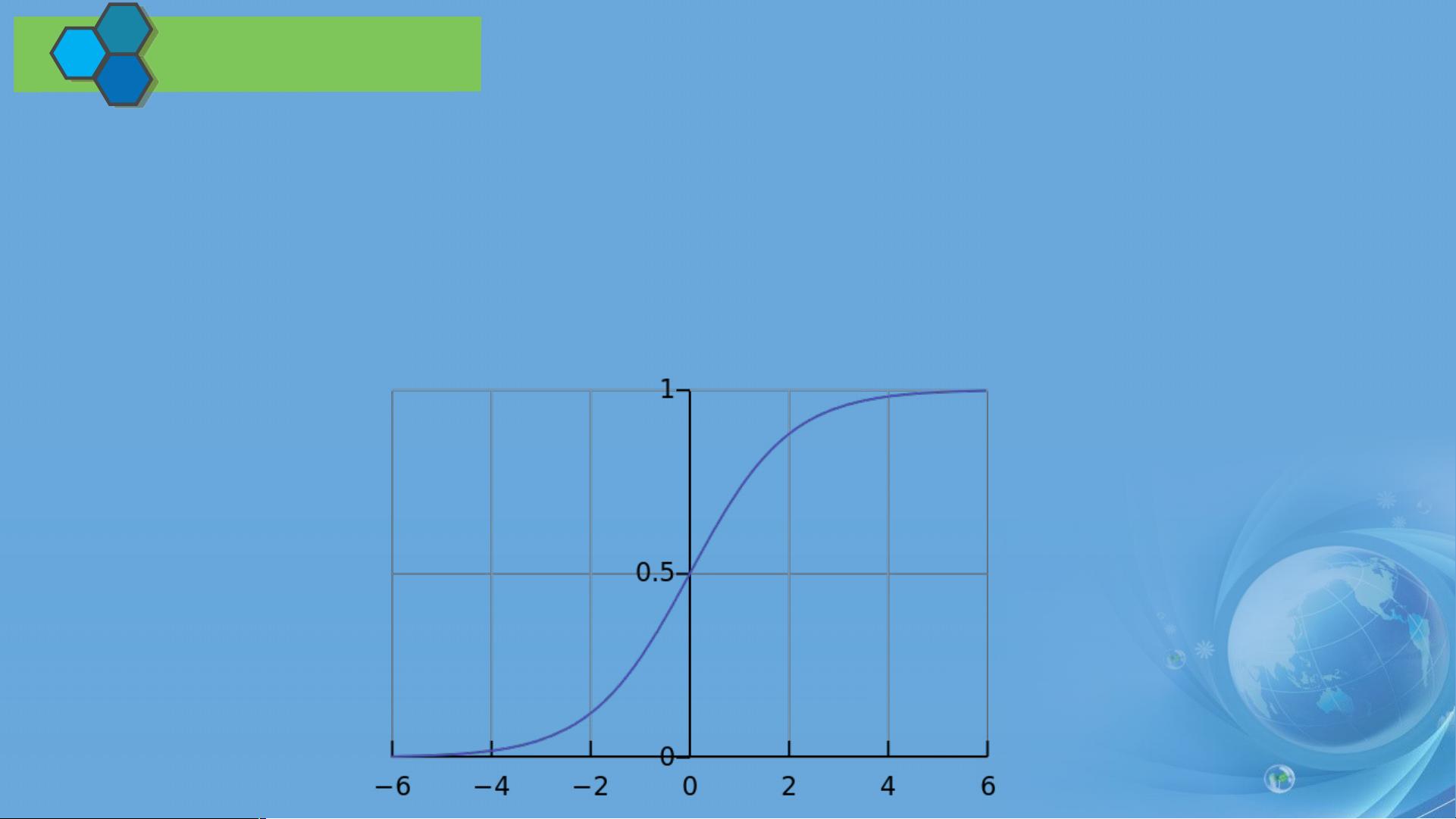

在神经网络中,每个神经元接收来自其他神经元的输入,经过加权求和后,再通过激活函数转化为非线性的输出。激活函数如sigmoid、ReLU等,它们的作用是引入非线性,使神经网络有能力学习更复杂的模式。权重是神经网络学习的核心,它们在训练过程中通过优化算法进行调整,以最小化预测输出与实际输出之间的误差。

提到训练,这里提到了有教师和无教师学习两种类型。有教师学习,如反向传播(BP)神经网络,需要已知的正确标签(即期望输出)来指导网络调整权重。训练过程通常采用梯度下降算法,通过计算损失函数关于权重的梯度来更新权重,以减小误差。而无教师学习,如自组织映射(SOM)或聚类算法,则不依赖于标注数据,而是让网络自行发现数据中的结构。

神经网络的层数决定了其复杂度和表达能力。当网络包含多个隐藏层时,我们就称之为深度学习。深度学习的关键在于它可以逐层学习和抽取特征,从原始数据中构建越来越抽象的表示。例如,在图像识别任务中,底层可能学习边缘和颜色,中层可能学习纹理和形状,高层则可能识别物体类别。深度学习已经在计算机视觉、自然语言处理、语音识别等领域取得了显著成果。

卷积神经网络(CNN)是深度学习中的一种重要架构,尤其适合图像处理。它利用卷积层来提取局部特征,池化层来降低计算复杂度,全连接层进行分类决策。此外,还有一些其他类型的深度网络,如循环神经网络(RNN)用于处理序列数据,长短期记忆网络(LSTM)解决了RNN的梯度消失问题,以及生成对抗网络(GAN)用于生成新的数据样本。

深度学习的成功离不开大量数据的支撑。数据集的质量和数量直接影响着模型的性能。在实际应用中,数据预处理、数据增强等技术常被用来提高模型的泛化能力。同时,超参数调优、正则化、早停等策略也有助于防止过拟合,提升模型在未知数据上的表现。

神经网络和深度学习是当前人工智能领域的基石。理解它们的基本原理和运作机制,对掌握现代机器学习技术至关重要。这份资料详细介绍了这些概念,并通过实例帮助读者更好地理解和掌握神经网络和深度学习的精髓。

1227 浏览量

952 浏览量

2024-11-10 上传

2024-11-10 上传

2024-11-10 上传

2024-11-08 上传

2024-10-27 上传

2024-10-28 上传

一醉千里

- 粉丝: 92

最新资源

- C#实现顾客点餐用餐模拟全过程

- OBM官方1.2增强版io修正,无需验证即可替换

- ASPAX咖啡处理插件:简化CoffeeScript文件管理

- Ruby项目部署手册:电影院系统配置指南

- VB实现比赛抽签分组程序详解

- GoShip:轻松部署代码到服务器的开源工具

- 《高性能MySQL》中文第三版精讲

- Oracle DBA面试题集精选

- AWS转录结果转换为VTT字幕文件工具

- PHP在nd_4项目中的应用及压缩包解析

- VC++仿MSN界面设计:图形按钮与控件美化

- ECShop积分明细展示功能开发教程

- ArduinoSpritz加密库:CSPRNG与数据加密技术

- C# 菜单工具栏美化技巧:简单实现调用

- 周立功can转usb驱动程序:亲测有效

- Axure原型设计组件库:提升产品设计效率