随机森林详解:提升预测准确性的强大机器学习方法

需积分: 5 160 浏览量

更新于2024-06-20

收藏 886KB PDF 举报

随机森林是一种强大的机器学习算法,属于集成学习方法,特别适用于需要高准确度预测的任务。在决策树基础上构建,它通过训练多棵决策树并让它们进行投票来做出最终决策,显著降低了模型的方差,提高了泛化能力。随机森林的优势在于其简单而高效,每棵树都在不同的随机子集上训练,这使得单个树的偏差保持一致,但个体之间的差异降低了整体误差。

具体实现步骤如下:

1. **数据获取与准备**:

首先,你需要从sklearn库中导入必要的数据生成工具,如`make_moons`函数,用于创建二维数据集。通过调用`make_moons(random_state=42, n_samples=500, noise=0.3)`,你可以创建一个具有月牙形状的样本数据集,其中包含500个样本,噪声级别设置为0.3,确保数据的复杂性和多样性。

2. **模型构建**:

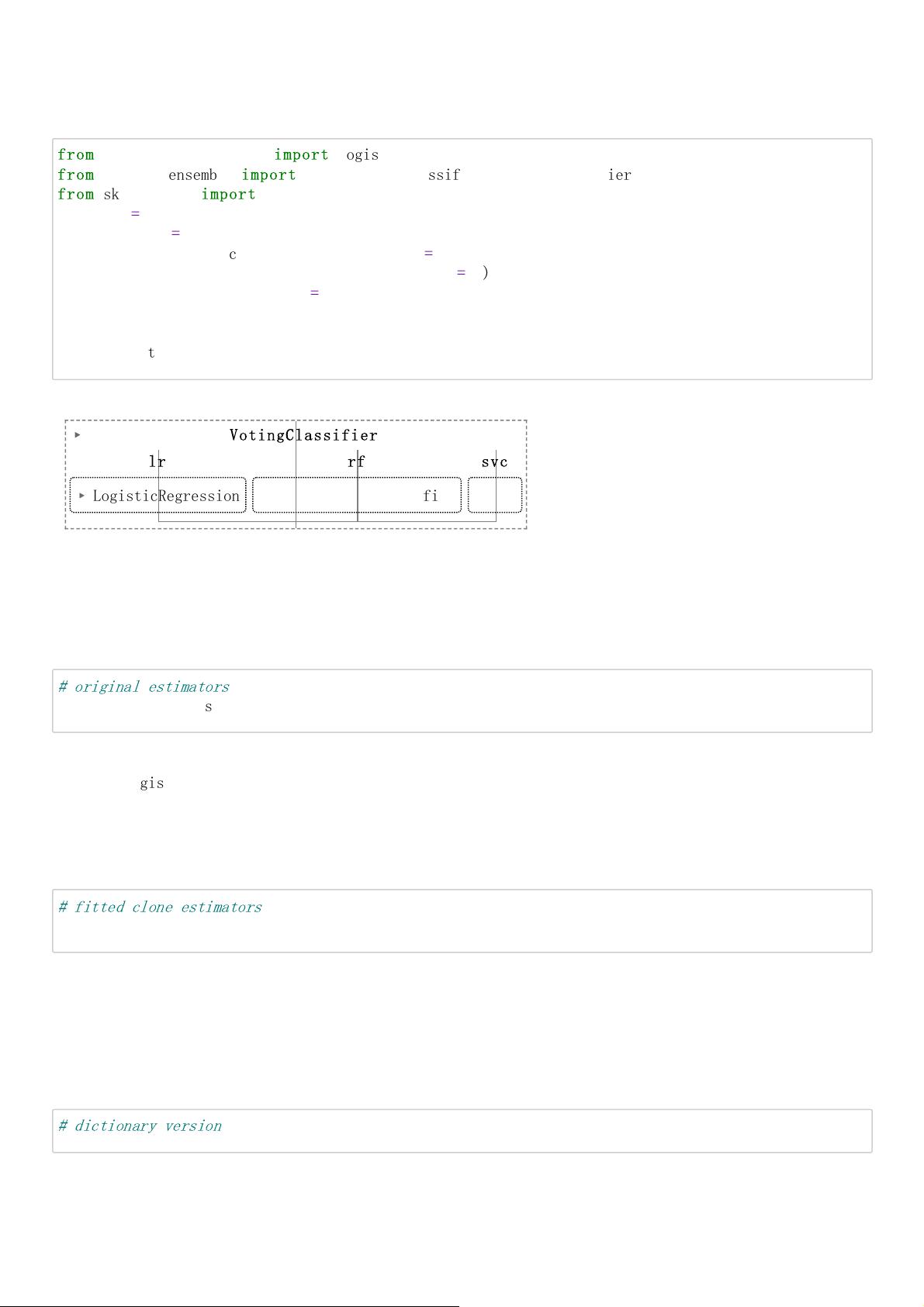

使用Python的`sklearn`库中的`VotingClassifier`类,你可以构建一个投票分类器,结合多个决策树模型。投票的方式可以是多数投票(最常见的类别获胜),将不同决策树的预测结果汇总,选择最常出现的类别作为最终预测。

3. **特征重要性评估**:

随机森林模型还提供了计算特征重要性的功能,这对于理解哪些特征对模型性能影响最大非常有用。你可以使用`sklearn.datasets.load_iris`或其他类似函数加载数据集,然后通过`RandomForestClassifier`的`feature_importances_`属性获取特征的重要性评分。这可以帮助你优化特征选择,提高模型的解释性和性能。

4. **模型训练与评估**:

将数据拆分为训练集和测试集,使用训练数据训练随机森林模型,然后在测试集上评估模型的性能,如精确度、召回率、F1分数等指标。由于随机森林具有良好的泛化能力,它通常能在测试集上展现出较高的预测准确性。

随机森林是一种实用且高效的机器学习工具,通过集成众多决策树,实现了较低的偏差和较高的稳定性能。它不仅适用于分类问题,也可以应用于回归任务,并且通过特征重要性分析有助于我们理解模型背后的工作原理。在实际应用中,根据具体任务和数据特点调整参数,能够进一步优化模型效果。

AI是这个时代的魔法

- 粉丝: 173

- 资源: 15