深度学习:神经网络与手写数字识别实践

需积分: 37 129 浏览量

更新于2024-07-19

收藏 348KB PDF 举报

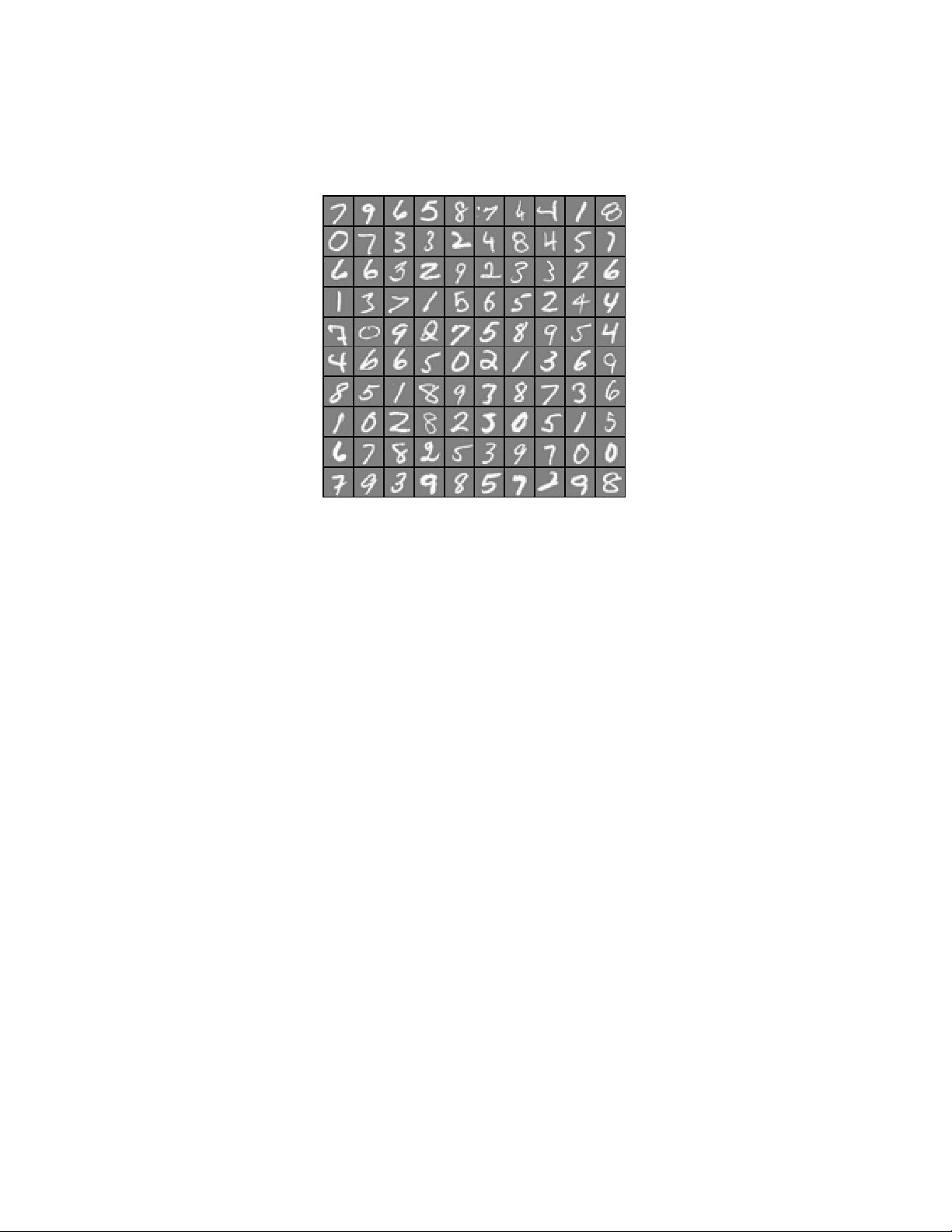

"本资源是斯坦福大学机器学习课程中关于神经网络的课后作业4,主要内容涉及神经网络的学习——反向传播算法在手写数字识别任务中的应用。完成此练习前,建议观看相关视频讲座并解答复习问题。提供有起步代码、训练数据集以及预先训练好的神经网络参数。"

在机器学习领域,神经网络是一种模仿人脑神经元结构的模型,广泛应用于图像识别、语音识别、自然语言处理等多种复杂任务中。在本次"机器学习 习题4"中,重点是理解和实现神经网络的反向传播算法(Backpropagation Algorithm),这是一种在神经网络中优化权重参数的有效方法,用于减少预测结果与实际结果之间的误差。

反向传播算法的工作原理如下:

1. **前向传播(Forward Propagation)**:输入数据通过神经网络的各个层次,每个节点根据其权重和激活函数计算出输出值。对于多层感知器(Multilayer Perceptron,MLP),这通常涉及到线性加权和非线性激活函数(如Sigmoid或ReLU)的连续应用。

2. **损失函数计算**:计算神经网络的预测输出与真实标签之间的差异,常用的是交叉熵损失函数(Cross-Entropy Loss)。

3. **反向传播误差**:从损失函数开始,利用链式法则计算每个权重对损失的梯度,将误差逆向传播回网络的所有层。

4. **权重更新**:使用梯度下降法(Gradient Descent)或其他优化算法(如Adam或RMSprop)更新权重,以减小损失函数。

在这个练习中,你将用到的数据集`ex4data1.mat`包含手写数字的训练样本,这些样本通常由像素值表示,形成一个多维向量。`ex4weights.mat`文件提供了预先训练的神经网络参数,这可能是为了让你专注于反向传播的实现而不是从零开始训练网络。

提供的`displayData.m`函数可以帮助你可视化数据,这对于理解数据分布和调试模型非常有用。`fmincg.m`是一个优化函数,它可能被用来替代梯度下降,以更高效地寻找损失函数的最小值。

完成这个练习,你需要:

1. **理解并实现前向传播**:计算输入数据通过神经网络后的预测输出。

2. **定义损失函数**:根据预测输出和真实标签计算损失。

3. **实现反向传播**:计算权重的梯度,并确保计算正确。

4. **优化权重**:使用优化算法更新权重以减小损失。

5. **评估模型**:使用测试数据集检查模型性能,例如计算准确率。

最后,`submit.m`脚本用于提交你的解决方案,验证你的算法是否正确实现了反向传播并有效解决了手写数字识别问题。在实践中,理解和掌握神经网络的反向传播算法对于提升模型的预测能力至关重要,也是机器学习工程师必备的技能之一。

108 浏览量

2024-04-17 上传

275 浏览量

2024-12-28 上传

191 浏览量

1822 浏览量

萌图美颜SDK

- 粉丝: 2

- 资源: 3

最新资源

- 适合做手机展示的点击图片放大效果

- opencv-3.4.3.rar

- P-SCAN接口EMC设计标准电路与技术资料-综合文档

- Programacion-III-Proyecto-Final

- sahmieyab:Sahmieyab

- flutter_boost:FlutterBoost是一个Flutter插件,可以以最少的工作量将Flutter混合集成到您现有的本机应用程序中

- WAH壁挂式控制箱产品电子样本.zip

- 图片墙桌面效果

- 通讯录源码java-protobuf-AddressBook:GoogleProtobuf和Java。来源:https://github.co

- laravel-shop:Laravel商店套餐

- 基卡德

- OpenIoTHub::sparkling_heart:一个免费的物联网(IoT)平台和私有云。 [一个免费的物联网和私有云平台,支持内网穿透]

- Ajax-ljq_weixin.zip

- jquery实现图片放大效果

- 精通direct3d图形及动画程序设计源代码下载

- JRoll:平滑滚动移动网络