R语言中的K均值聚类分析实践

下载需积分: 0 | PDF格式 | 5.9MB |

更新于2024-08-05

| 58 浏览量 | 举报

"该资源是关于无监督学习中的聚类分析,特别是K-means聚类算法在R语言中的应用。通过一个模拟案例展示了如何使用R的kmeans函数进行聚类,并探讨了聚类效果和参数设定。"

在无监督学习中,聚类是一种常用的方法,用于将相似的数据点归入同一类别,而无需预先知道类别的信息。K-means聚类是一种简单且常用的聚类算法,其核心思想是通过迭代优化,使得每个数据点尽可能接近其所属类别的中心,而类别的中心则是该类别所有数据点的均值。

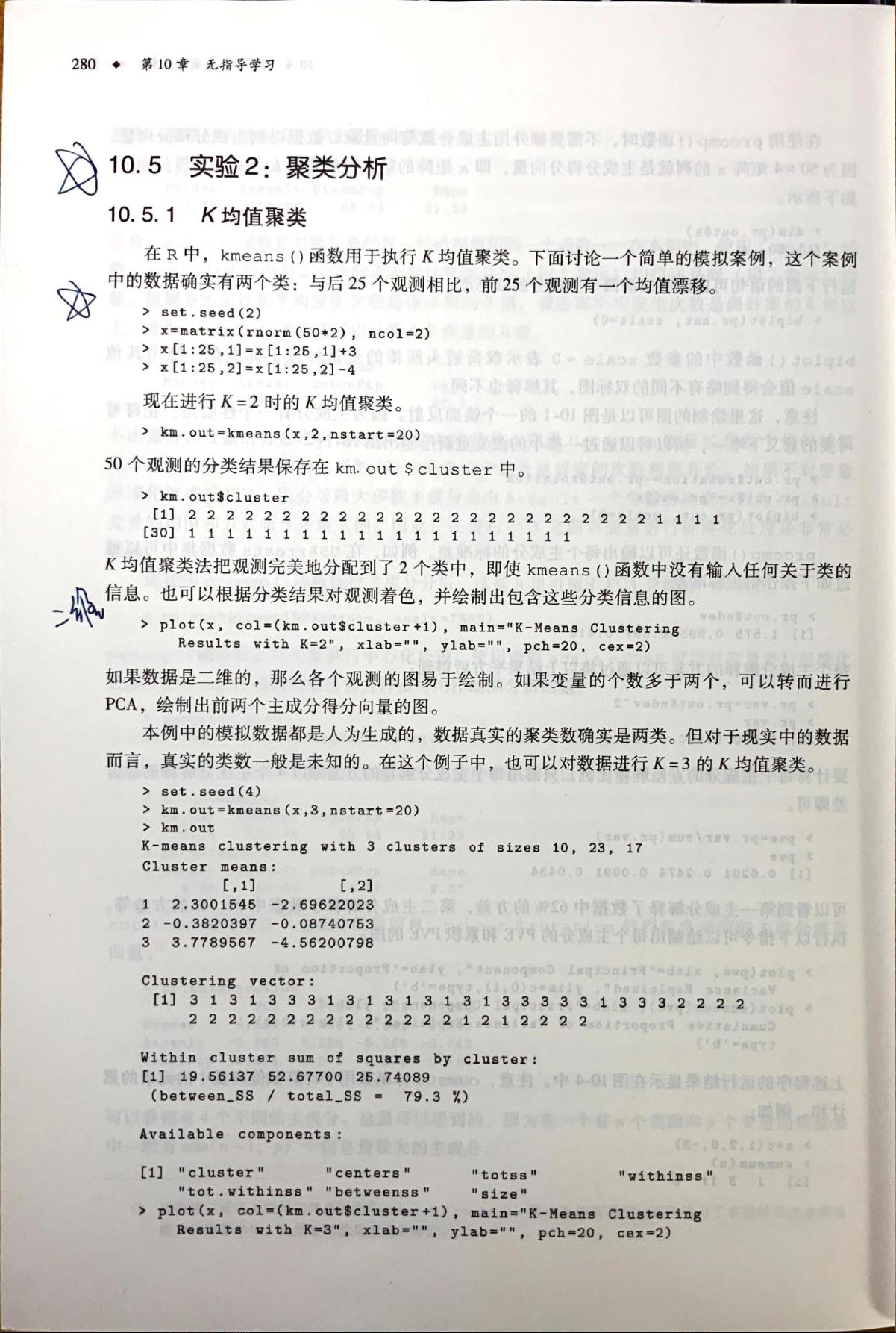

在R语言中,K-means聚类可以通过`kmeans()`函数实现。这个函数接受两个主要参数:`x`代表数据集,`k`表示想要划分的类别数量。在提供的示例中,首先设置随机种子以确保结果可重复,然后创建了一个50行2列的随机正态分布数据矩阵`x`。为了模拟两类数据,前25个观测值在第一列和第二列分别有一个均值漂移。接着,调用`kmeans(x, 2, nstart=20)`执行K-means聚类,其中`2`表示设定2个聚类,`nstart=20`指定了运行K-means的初始中心选择次数,以避免局部最优解。

运行后,聚类结果存储在`km.out$cluster`中,显示50个观测被完美地分配到两个类别中。通过将聚类结果与数据点的颜色关联,可以直观地看到聚类效果。在二维数据上,可以直接绘制数据点并着色,而在多维数据中,可以利用主成分分析(PCA)降低维度后再进行可视化,例如画出前两个主成分得分的图。

在实际应用中,真实的数据类数通常是未知的。因此,选择合适的类别数量是个挑战。示例中展示了将数据进行K=3的聚类,可以看到聚类结果可能不那么明显,且聚类中心和分类情况会有所不同。

K-means算法的性能依赖于初始中心的选择。`nstart`参数可以设置多次启动,每次使用不同的随机中心,最终选取使总平方误差最小的那次结果。此外,K-means算法对异常值敏感,且假设数据分布是球形的,如果数据分布不均匀或存在噪声,可能会影响聚类效果。

在评估聚类质量时,可以使用如轮廓系数等方法,它衡量了每个数据点与其所在簇其他点的平均距离与到最近簇的平均距离的比值,从而判断聚类的紧密度和分离度。对于实际问题,理解数据的先验知识和选择适当的聚类数量至关重要。

相关推荐

daidaiyijiu

- 粉丝: 20

- 资源: 322