"藏经阁-A Con&nuously Deployed Hadoop.pdf"是一份关于阿里云在持续部署Hadoop分析平台的详细指南。这份文档探讨了不同阶段的开发、部署和运营流程,旨在优化大数据处理和分析能力,确保高效的IT服务。

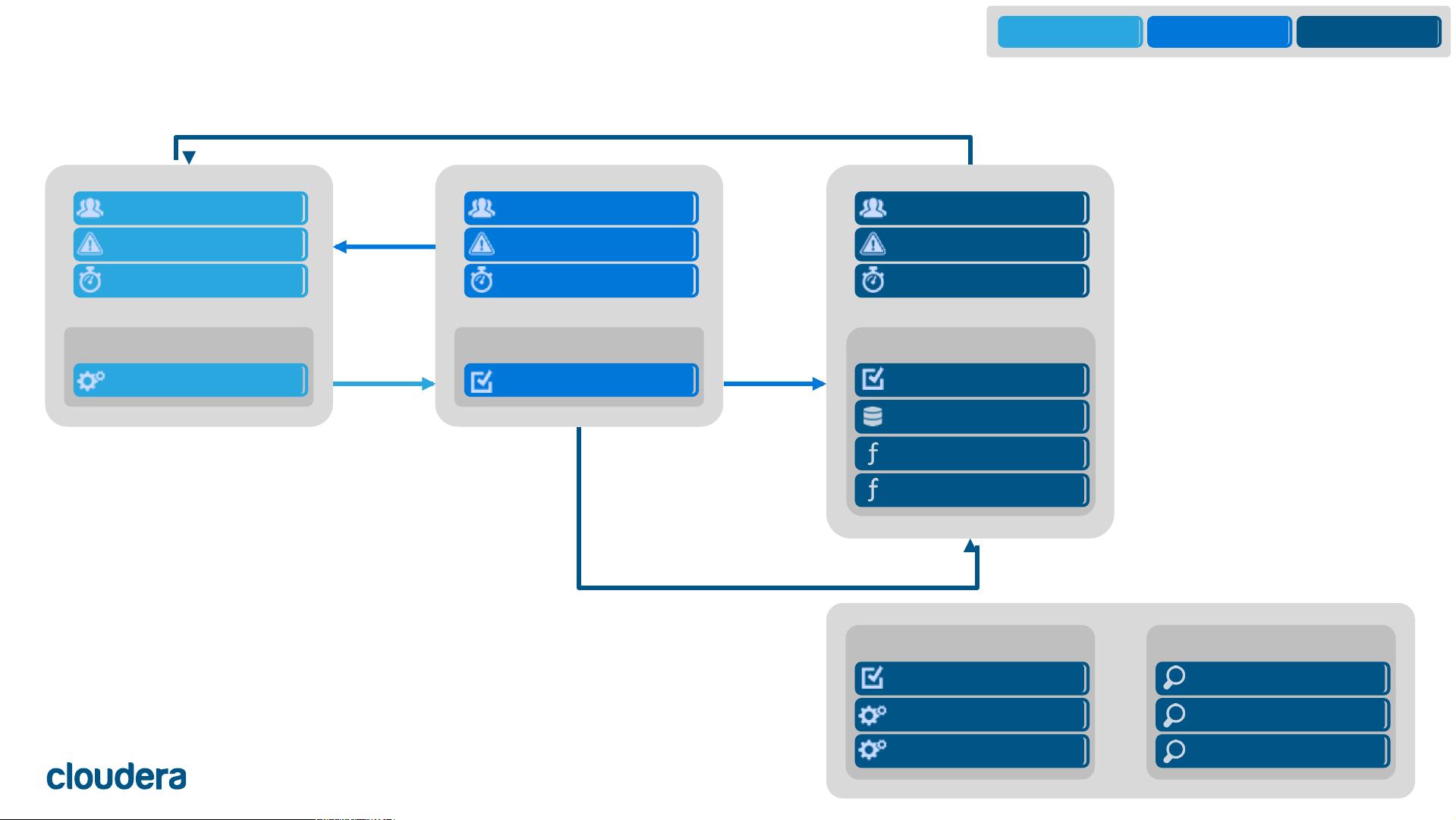

首先,文档强调了持续部署的重要性,即通过自动化工具如Logical Pilot Delivery Pipeline实现数据科学家(DS)、分析师和应用开发者(Apps)的工作效率提升。这种持续部署允许团队在预生产(Pre-Production)阶段进行定期的100% bug检测,确保每月或每月到年度的开发过程中,目标是在每月或年度周期内将bug率降至最低,如DS、Analysts、Apps团队的月度和年度平均bug率分别为100%、90%和10%。

在整个生命周期中,操作(Opera&ons)部分涵盖监控(Monitor)、资源配置(Provision)、自动化(Automate)以及生产(Produc&on)等关键环节。例如,Hourly级别的操作着重于小时级的监控和自动化的数据工程任务,而Monthly和Yearly级别的工作则可能涉及到更复杂的治理、审计(Governance, Audit)、安全(Security)和数据源追踪(Lineage)管理。

此外,文档特别提到了不同的交付管道模型,如Logical Nascent、Logical Staged和Logical Manual Delivery Pipeline,分别对应着不同频率的测试和质量标准,如每周的System Smoke Test(系统烟雾测试),确保每周和每周内达到0%的bug率。对于非SLA(服务水平协议)和SLA场景,也明确了备份数据(BackupData)和生产工作负载(Produc&onWorkload)的重要性。

在用户接受测试(UserAcceptanceTest)和DevOps实践(DevOps)方面,文档表明了定期的性能和质量检查,如每周的10% bug率,确保最终产品满足业务需求和安全标准。在整个流程中,无论是开发、生产和运维,都强调了治理、审计和安全控制,以保障数据科学(DataScience)项目的稳健运行。

总结来说,"藏经阁-A Con&nuously Deployed Hadoop.pdf"提供了阿里云如何运用持续部署策略来优化Hadoop平台的实践经验,包括各个阶段的流程管理、质量控制和安全措施,以提升大数据处理的效率和可靠性。