探索聚类算法:K-means、层次聚类与应用实例

需积分: 17 178 浏览量

更新于2024-07-18

收藏 13.98MB PDF 举报

聚类算法是一种无监督学习方法,其目标是将未标记的数据样本按照某种相似性准则分组成多个类别或簇。本资源主要讲解了三种常见的聚类算法:K-means聚类、层次聚类以及混合高斯模型。

K-means聚类:

- 原理:通过定义每个簇中心(质心)并迭代调整,使得每个样本点与其所属簇的质心的距离最小。损失函数通常是各簇内部点到质心的平方误差总和。K-means算法包括初始化质心、分配样本到最近的质心、更新质心和重复步骤直到收敛。

- 应用注意点:K-means对初始质心的选择敏感,可能需要多次运行并选择最佳结果。此外,它假设簇是球形的,且数据分布应满足簇中心的存在。

层次聚类:

- 原理:通过计算样本间的相似度构建树状结构,可以是自底向上(凝聚法)或自顶向下(分裂法)。每个阶段通过合并或划分形成层次结构,直到达到预设的聚类数目或达到某个停止条件。

- 应用注意点:层次聚类需要选择合适的相似度度量,并可能产生高度分支的树结构,解读和解释相对复杂。

混合高斯模型:

- 原理与简单应用:这是一种概率模型,假设每个簇由一个高斯分布表示。通过最大似然估计来确定各个高斯分布的参数,适用于数据具有多峰或多模态分布的情况。

- 应用:可用于密度估计、异常检测等任务,但计算复杂度较高。

聚类示例:

- 聚类的应用广泛,如邮件分类(工作、财务和个人等)、用户购买行为分析、图像边缘检测、发现共同兴趣群体,以及在监督学习中处理稀疏特征。

评估聚类效果:

- 常用的评估指标有:高类间距(簇间差异大)、低类内距(簇内差异小),即高类内相似度、低类间相似度。直观上,好的聚类应该让同一簇内的样本紧密相连,不同簇间的样本分离明显。

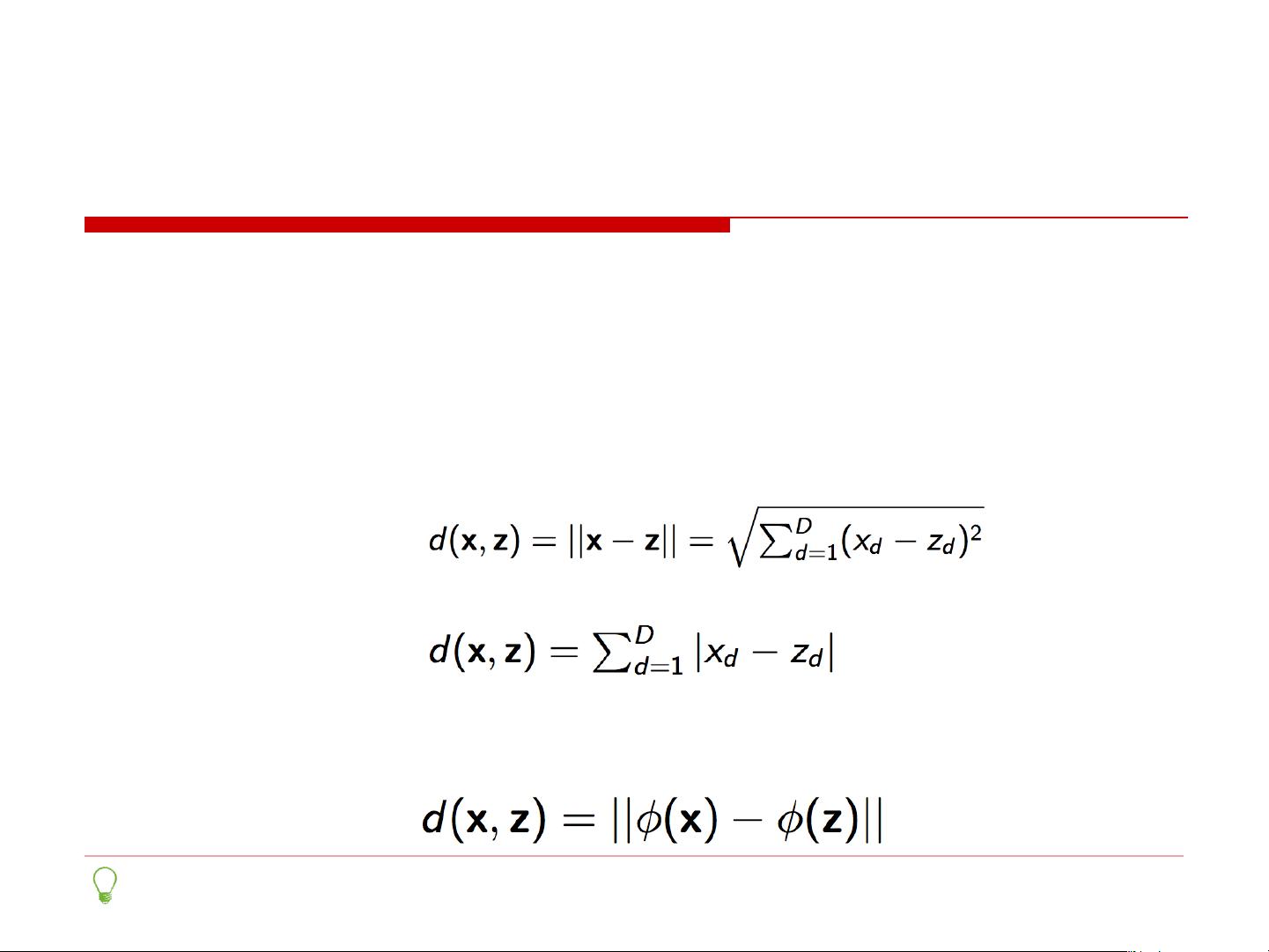

相似度与距离:

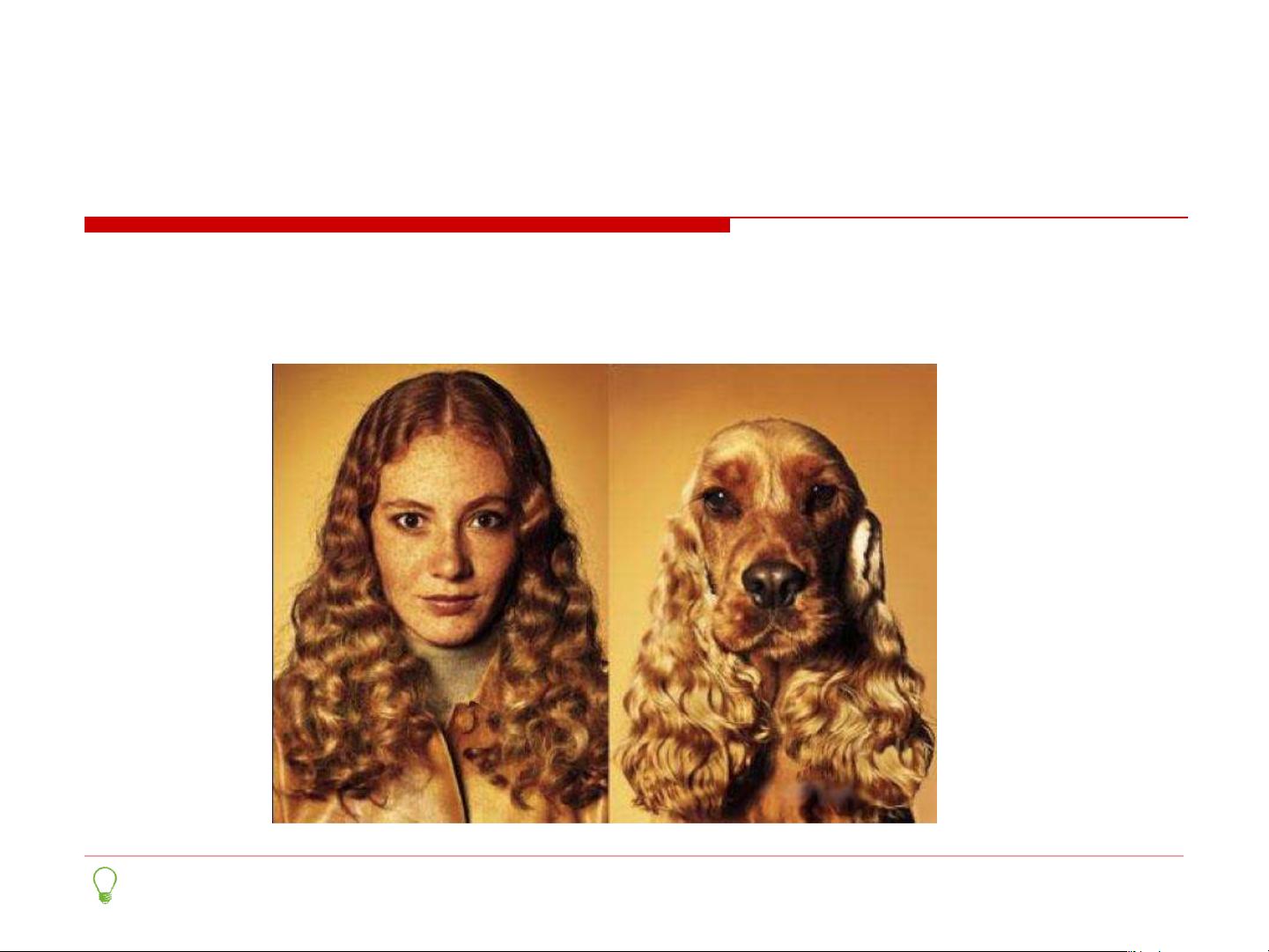

- 聚类过程中,相似度是关键,它决定了样本间的连接关系。相似度通常与距离呈负相关,即相似度越高,距离越小。选择合适的距离度量取决于具体的应用场景,如图片内容、像素颜色、文本内容、社交网络偏好等。

总结:

该资源提供了对聚类算法基础理论和实际应用的深入探讨,包括K-means、层次聚类以及混合高斯模型的介绍,强调了选择合适相似度度量和评估聚类质量的重要性。通过这些方法,可以帮助数据分析师和机器学习工程师理解和运用聚类技术解决实际问题。

2017-10-17 上传

2023-02-20 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

qq_17148449

- 粉丝: 3

- 资源: 15

最新资源

- SSM Java项目:StudentInfo 数据管理与可视化分析

- pyedgar:Python库简化EDGAR数据交互与文档下载

- Node.js环境下wfdb文件解码与实时数据处理

- phpcms v2.2企业级网站管理系统发布

- 美团饿了么优惠券推广工具-uniapp源码

- 基于红外传感器的会议室实时占用率测量系统

- DenseNet-201预训练模型:图像分类的深度学习工具箱

- Java实现和弦移调工具:Transposer-java

- phpMyFAQ 2.5.1 Beta多国语言版:技术项目源码共享平台

- Python自动化源码实现便捷自动下单功能

- Android天气预报应用:查看多城市详细天气信息

- PHPTML类:简化HTML页面创建的PHP开源工具

- Biovec在蛋白质分析中的应用:预测、结构和可视化

- EfficientNet-b0深度学习工具箱模型在MATLAB中的应用

- 2024年河北省技能大赛数字化设计开发样题解析

- 笔记本USB加湿器:便携式设计解决方案