深度解析卷积神经网络:从LeNet到池化层

166 浏览量

更新于2024-08-27

1

收藏 237KB PDF 举报

"本文详细介绍了卷积神经网络(CNN)的基础知识,包括卷积层和池化层的概念、运算方式以及其在图像处理中的应用。文中提到了卷积层通常使用互相关运算而非卷积运算,并解释了感受野、填充和步幅的概念。此外,还讨论了多通道输入和池化层的作用,如最大池化和平均池化。文章通过LeNet和AlexNet两个代表性卷积神经网络结构的阐述,展示了CNN在图像分类任务中的应用。"

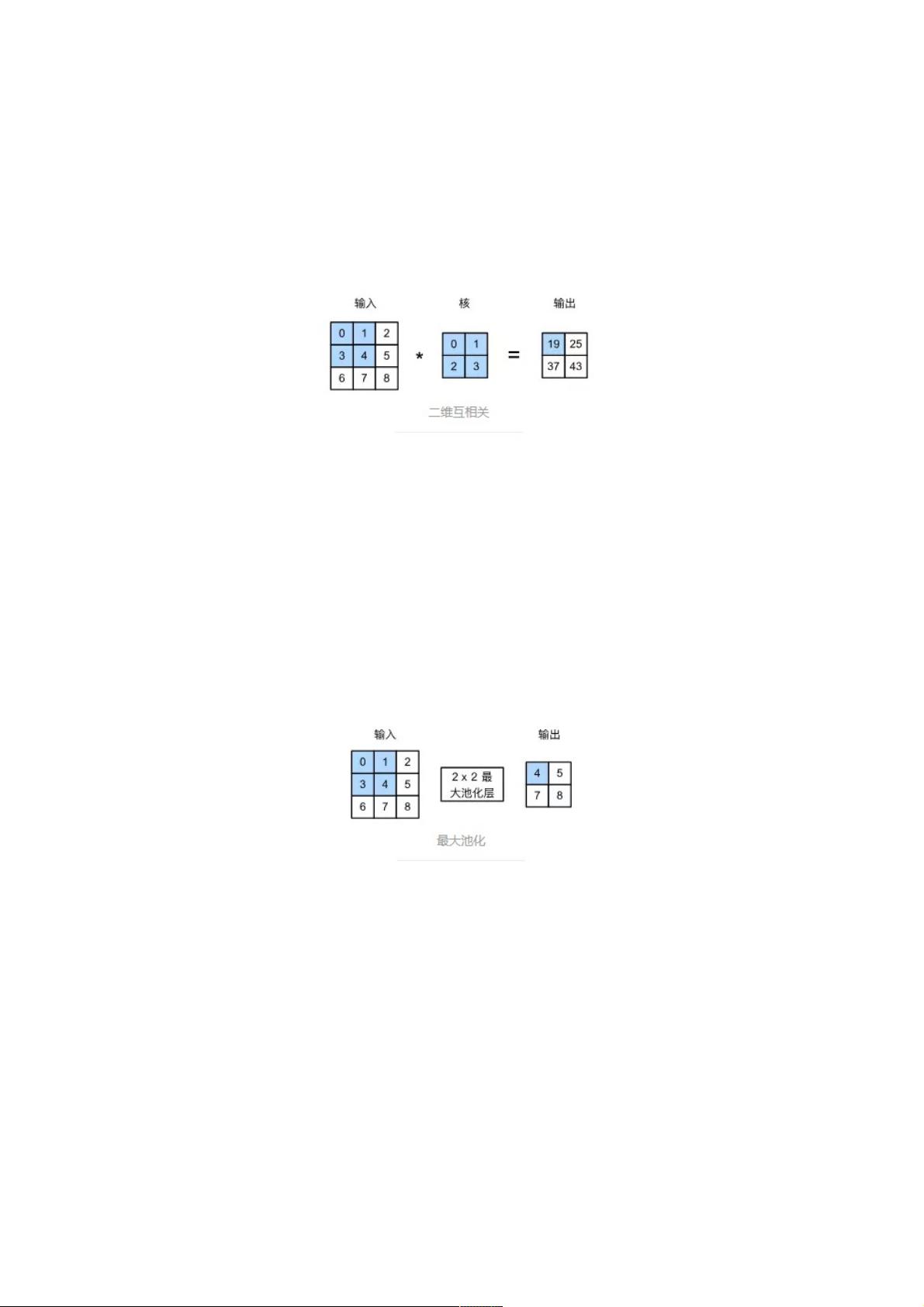

卷积神经网络(CNN)是一种专门用于处理具有空间结构数据,如图像的深度学习模型。卷积层是CNN的核心组成部分,它通过应用一系列可学习的滤波器(filter)来提取输入图像的特征。滤波器在输入数据上进行滑动,执行互相关运算,生成特征图。特征图记录了输入图像在特定位置和尺度上的特征响应。

卷积运算与互相关运算在实际应用中几乎等价,区别在于运算的方向。卷积运算通常考虑滤波器与输入数据的位置关系,而互相关更直观,滤波器被固定在输入数据上,只移动输入数据。卷积层的输出——特征图,反映了输入在特定空间区域的特征表示,每个元素对应一个感受野,即影响该元素计算的所有输入区域。

在卷积层中,为了保持输出尺寸或者调整模型复杂度,通常会使用填充(padding)和步幅(stride)的概念。填充是在输入边界添加额外的元素,步幅决定了滤波器滑动的步长。这两个参数影响了特征图的尺寸和模型对细节的敏感程度。

池化层作为CNN的另一个关键组件,通过在输入上应用池化窗口,对区域内的元素求最大值或平均值,降低了模型对位置的依赖性,同时减少了计算量和参数数量。最大池化保留了最重要的特征,而平均池化则平滑了输出。

LeNet是最早的卷积神经网络之一,由卷积层和最大池化层组成的基本单元重复堆叠,最后通过全连接层进行分类。全连接层将特征图展平为一维向量,便于进行线性分类。AlexNet是LeNet的升级版,加深了网络结构,引入了ReLU激活函数和数据增强技术,显著提升了图像分类性能。

通过学习和理解这些基础知识,读者可以更好地掌握卷积神经网络的工作原理,并进一步研究其他复杂的CNN架构,如VGG、ResNet和Inception等,这些网络在现代计算机视觉任务中扮演着至关重要的角色。

633 浏览量

161 浏览量

2020-09-20 上传

2020-05-13 上传

2020-02-24 上传

2020-09-04 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

weixin_38743076

- 粉丝: 7

- 资源: 925

最新资源

- Java毕业设计项目:校园二手交易网站开发指南

- Blaseball Plus插件开发与构建教程

- Deno Express:模仿Node.js Express的Deno Web服务器解决方案

- coc-snippets: 强化coc.nvim代码片段体验

- Java面向对象编程语言特性解析与学生信息管理系统开发

- 掌握Java实现硬盘链接技术:LinkDisks深度解析

- 基于Springboot和Vue的Java网盘系统开发

- jMonkeyEngine3 SDK:Netbeans集成的3D应用开发利器

- Python家庭作业指南与实践技巧

- Java企业级Web项目实践指南

- Eureka注册中心与Go客户端使用指南

- TsinghuaNet客户端:跨平台校园网联网解决方案

- 掌握lazycsv:C++中高效解析CSV文件的单头库

- FSDAF遥感影像时空融合python实现教程

- Envato Markets分析工具扩展:监控销售与评论

- Kotlin实现NumPy绑定:提升数组数据处理性能