基于Q学习的交通视频中运动物体智能识别与深度标注

179 浏览量

更新于2024-08-28

收藏 390KB PDF 举报

本文主要探讨了计算机科学与信息系统领域中的人类级别运动物体识别技术在交通视频分析中的应用。随着信息技术的发展,大数据已经成为智能规划和决策制定的关键资源,尤其是交通视频,其包含了丰富的原始信息,如车辆、行人等移动目标的行为动态。然而,由于交通视频通常场景拥挤且清晰度较低,传统的处理方法可能无法有效提取和识别运动对象。

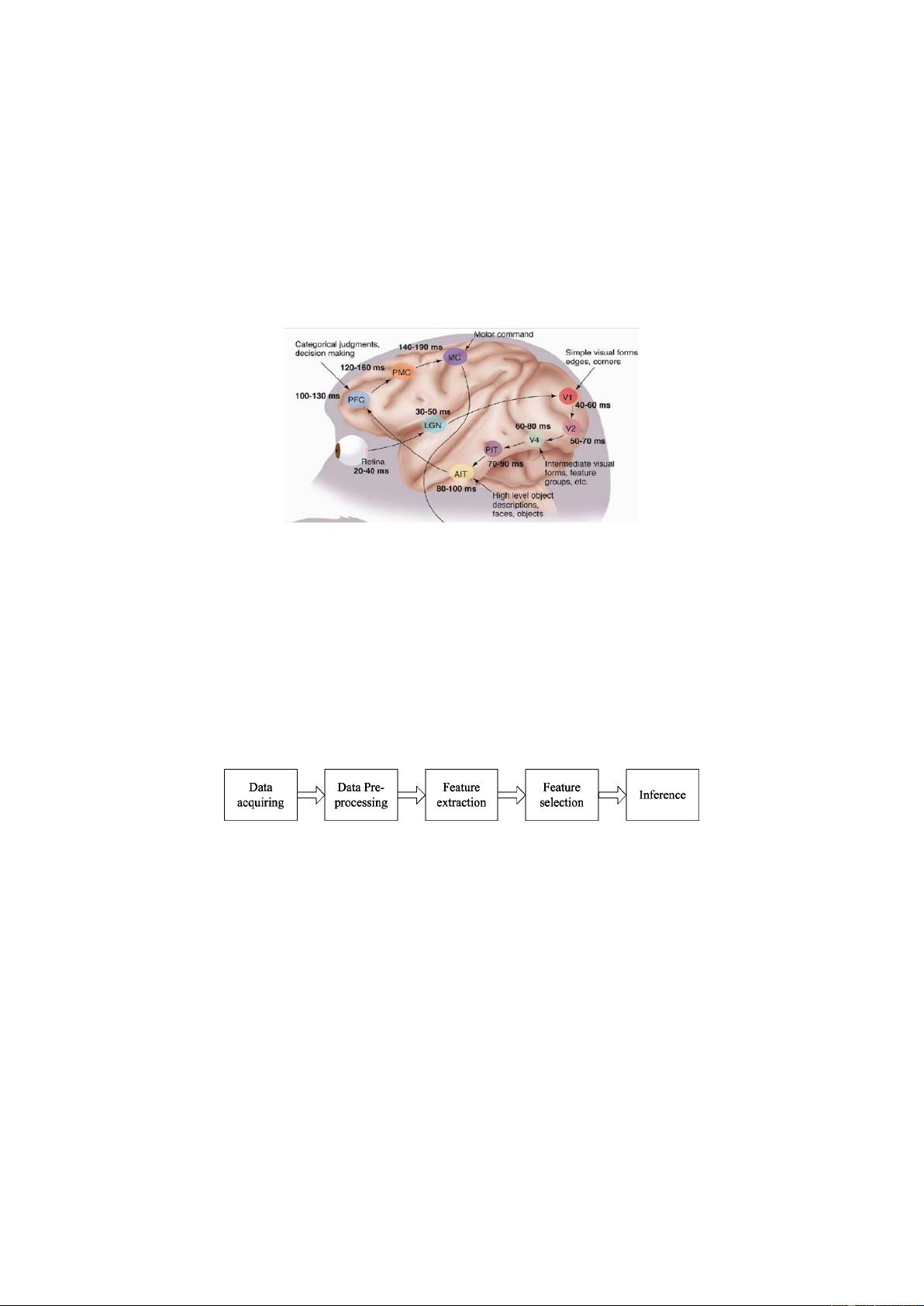

深度学习作为一种强大的工具,被用来提升从大数据中理解和解析复杂模式的能力。它通过模仿人脑神经网络的工作原理,学习到高级特征表示,使得对图像内容的理解达到了人类水平。在处理交通视频时,这种方法尤其适用,因为它能够处理海量数据并准确地识别运动物体。

文章提出了一种结合Q-learning(强化学习的一种)的运动物体识别方法。Q-learning在这里被用来优化对运动对象的定位过程,特别是通过寻找最紧凑的区域来包围每一个移动对象。这种策略避免了一次性处理整个图像的低效性,而是将图像分割,针对每个运动对象进行局部分析,提高了识别的效率和准确性。

算法首先通过Q-learning找到运动物体的区域,然后运用优化策略确定包含对象的最小矩形框,确保在实时性方面有所保障。这一步骤对于交通监控和智能交通系统尤为重要,因为快速、准确地识别运动物体有助于实时分析交通流量、预测事故风险以及实现自动化控制。

接下来,已经识别出的对象会进一步通过深度神经网络进行语义标记,也就是赋予它们具体的类别标签,如车辆类型、行人行为等,从而提升数据的可用性和可解释性。深度学习模型在此阶段发挥了重要作用,它们可以从大量训练样本中学习到丰富的上下文信息,增强物体识别的精度。

实验结果显示,这种基于Q-learning和深度学习的方法在交通视频中的运动物体识别任务上表现出了显著的效果,证明了其在实际应用中的可行性。通过这种方式,计算机科学与信息系统领域的研究者们正在逐步突破大数据处理的挑战,为未来的智能交通系统提供更为精确和高效的解决方案。

2023-11-12 上传

2021-11-11 上传

2024-01-27 上传

2023-04-02 上传

2023-05-30 上传

2023-02-07 上传

2023-05-22 上传

2023-04-30 上传

2023-12-19 上传

weixin_38698590

- 粉丝: 6

- 资源: 943

最新资源

- C++标准程序库:权威指南

- Java解惑:奇数判断误区与改进方法

- C++编程必读:20种设计模式详解与实战

- LM3S8962微控制器数据手册

- 51单片机C语言实战教程:从入门到精通

- Spring3.0权威指南:JavaEE6实战

- Win32多线程程序设计详解

- Lucene2.9.1开发全攻略:从环境配置到索引创建

- 内存虚拟硬盘技术:提升电脑速度的秘密武器

- Java操作数据库:保存与显示图片到数据库及页面

- ISO14001:2004环境管理体系要求详解

- ShopExV4.8二次开发详解

- 企业形象与产品推广一站式网站建设技术方案揭秘

- Shopex二次开发:触发器与控制器重定向技术详解

- FPGA开发实战指南:创新设计与进阶技巧

- ShopExV4.8二次开发入门:解决升级问题与功能扩展