Hadoop2.x:新一代数据处理框架的革新

需积分: 9 94 浏览量

更新于2024-07-19

收藏 1.34MB PPTX 举报

"本文将对Apache Hadoop 2.x进行详细介绍,并对比分析与Hadoop 1.x的区别。Hadoop 2.x引入了多项新特性,旨在解决Hadoop 1.0存在的局限性,如资源隔离、元数据扩展性、访问效率、数据丢失问题以及MapReduce的扩展性挑战。"

在Hadoop 1.0时代,HDFS(分布式文件系统)面临一些关键问题,例如缺乏资源隔离机制,这可能导致不同应用之间的资源争夺。元数据扩展性不足限制了系统处理大量文件和目录的能力,同时,访问效率不高,特别是在处理小文件时。此外,Hadoop 1.0的HDFS存在数据丢失的风险,这可能影响系统的整体稳定性。

MapReduce作为Hadoop 1.0的主要计算框架,也存在明显的局限。集群的最大节点数和并发任务数分别限制在4000和40000,这在大数据处理需求不断增长的背景下显得捉襟见肘。JobTracker承担了过多的职责,如作业调度、资源管理和故障恢复,这导致其负载过重,一旦故障,整个系统将面临崩溃。此外,MapReduce仅支持批处理模式,时效性较差,且资源管理效率低下,无法适应多样化计算需求。

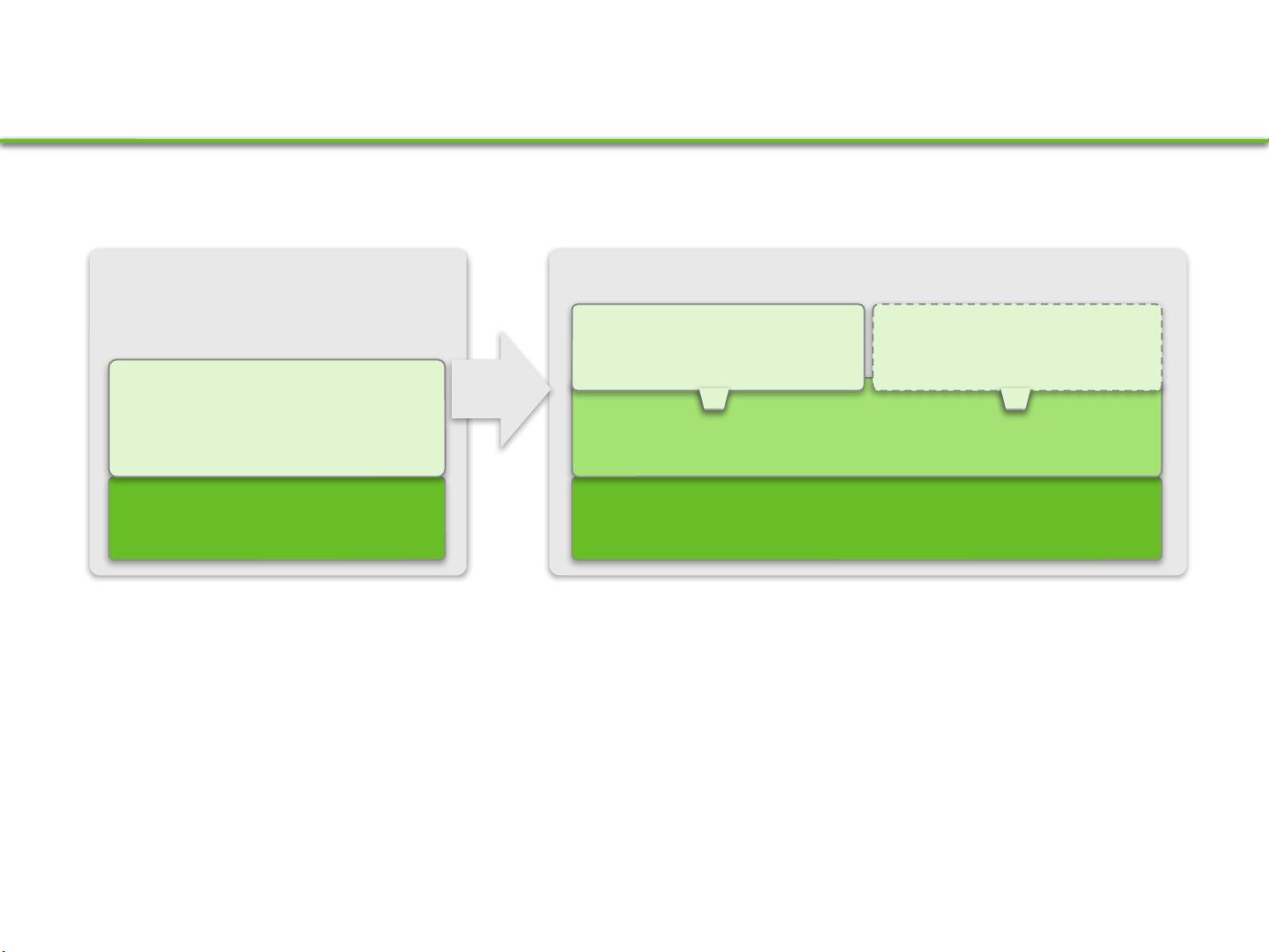

Hadoop 2.0作为下一代数据处理平台,旨在克服这些问题,它由HDFS、MapReduce和YARN(Yet Another Resource Negotiator)三个核心组件构成。HDFS引入了NameNode Federation和High Availability,增强了系统的扩展性和可靠性。MapReduce运行在YARN之上,保持了原有的编程模型,但将作业管理和资源调度分离,从而提升了系统的灵活性和性能。

YARN是Hadoop 2.0的重大创新,它的出现直接针对Hadoop 1.x的MapReduce框架在扩展性、可靠性、资源利用率以及多计算框架协作上的不足。ResourceManager负责全局资源管理和调度,NodeManager管理单个节点的资源,而ApplicationMaster则协调应用的执行。这种设计使得Hadoop 2.0能够支持多种计算框架,如传统的MapReduce、实时计算的Storm和内存计算的Spark,实现了从单一的批量处理系统向多功能数据处理平台的转变。

Hadoop 2.x通过改进HDFS和引入YARN,不仅提升了系统的扩展性和可靠性,还降低了单点故障风险,提高了资源利用率,从而更好地满足了大数据时代多样化的计算需求。这种演进反映了大数据处理技术的持续进步,为开发者和企业提供了更强大、更灵活的数据处理解决方案。

2020-03-16 上传

2017-09-29 上传

2023-03-16 上传

2024-01-19 上传

2024-09-02 上传

2023-06-11 上传

2023-05-25 上传

2023-05-28 上传

xbbad496

- 粉丝: 0

- 资源: 1

最新资源

- app:詹金斯的应用程序

- react-hot-export-loader:一个Webpack加载器,自动插入react-hot-loader代码,灵感来自react-hot-loader-loader

- DIY制作属于自己的CP2102 USB-UART桥接器(原理图+PCB源文件)-电路方案

- 雅典:开源网络思想。 内部封闭测试正在进行中! 通过https:forms.gle9L1D1T7R3G7pvh1e7加入候补名单。 赞助我们以更快获得测试版!

- uni-app之flex布局教程 uniapp在线教程 uni app视频教程

- jamesSampica.github.io:自己的博客

- Android动画效果源代码

- 教师招聘学习软件支持幼儿教师招聘,小学中学教师招聘,小学中学教育学心理学等等

- LoveAndShare:基于Python django建造的知识分享与视频播放网站

- fp-gitlab-example:用于转换API请求以使用fp-ts的示例代码

- 彻底搞懂Spring+SpringMVC+MyBatis 框架整合(IDEA版,含源码)

- EmployeeWageComputation

- my-first-webpage

- getting_cleaning_data:回购获取和清洁数据; JHU课程; 数据科学专业

- MPLAB ICD2仿真器原理图+PCB+HEX文件-电路方案

- 灰白经典婚纱照网站模板