2020年信息技术会议时间及模型探讨:GNN应用与Sentence2Vec研究

需积分: 0 13 浏览量

更新于2024-08-04

收藏 601KB DOCX 举报

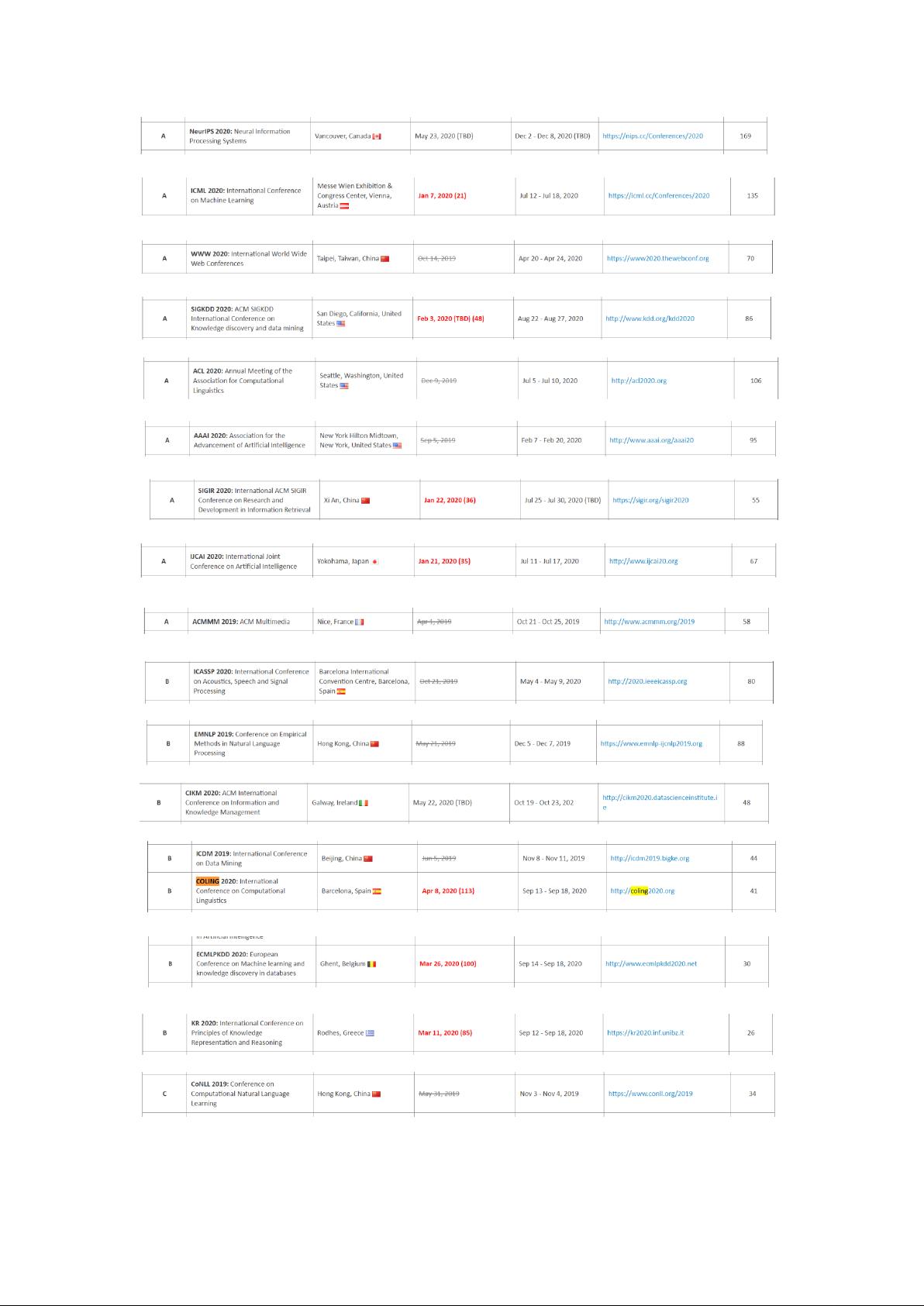

在本文档中,主要讨论了几个重要的会议时间安排,包括SIGGRAPH 2022、IJCAI 2020、SIGIR 2020、SIGKDD 2020、以及ICML 2020,这些会议集中在自然语言处理和计算机图形学领域。具体关注的知识点包括:

1. **会议与自然语言处理(NLP)**: 文档提到的ACL、EMNLP和CONLL都是NLP领域的顶级会议,讨论的话题可能涉及文本处理、语言模型、命名实体识别、句法分析等。作者考虑使用BERT模型对句子进行编码以获取节点特征,并探索如何结合实体知识图谱,如Framenet和Wordnet,来构建图表示。Framenet提供框架理论,Wordnet则是词义网络,它们可以用来增强模型理解和上下文关联。

2. **图神经网络(GNN)应用**:提到的GNN技术,如GCN(图卷积网络)和GraphSAGE,被提及用于节点嵌入,通过聚合邻居节点的信息并进行线性变换,有助于捕捉文本中的语义关系。这里还提到了LSTM(长短时记忆网络)和自注意力机制,这些都被认为是构建深度学习模型的有效工具。

3. **Sentence2Vector**: 文档中提到研究如何将句子转化为固定长度的向量表示,这是许多NLP任务的基础,如情感分析、机器翻译等。

4. **模型实现与协作**:涉及到团队成员的合作,如模型设计由杨子宁负责,输入处理由朱晓祥负责。他们可能在探索如何将上述技术集成到实际项目中。

5. **其他会议与研究方向**:除了上述会议,还有CIKM、COLING、ECMLPKDD、ICMR、KR和ICCBR等会议,涵盖了不同的领域,如信息检索、机器学习、知识发现和推理等。特别提到的多任务文章可能是IJCAI上接收的,这表明团队正在关注跨任务学习和迁移学习的应用。

6. **模型评估与基准**:如SNLI和MultiNLI数据集,这些是用于自然语言推理任务的标准评估集,可能用于模型性能的比较。

本文讨论的核心是结合NLP技术,尤其是图模型(如GNN)和预训练模型(如BERT),在会议论文中所探讨的问题,以及如何将这些技术应用于实际项目中,同时关注了相关的研究进展和评估标准。

2022-01-28 上传

271 浏览量

2022-11-05 上传

2024-11-12 上传

2024-11-01 上传

141 浏览量

2024-11-10 上传

2024-09-13 上传

2023-07-16 上传

WaiyuetFung

- 粉丝: 934

- 资源: 316

最新资源

- 单片机实验指导书资料

- 用Eclipse开发J2ME手机游戏入门讲座.doc

- ARM嵌入式系统C语言编程

- JAVA基础好东西啊快来看看吧

- 安装 oracle 数据库 10g 的基础知识

- 数据结构教学大纲 数据结构考研复习

- SQL Server笔试题解答

- flex 3 cookbook

- 软件工程VC++深入详解,包括mfc的相关介绍,一定让您功力大增

- java葵花宝典——知识库

- MB V6 Inst Notes SLES 10 Linux

- Eclipse in Action A GUIDE FOR JAVA DEVELOPERS

- 网络经典命令行(网络高手必备)

- 编程\WinXP技巧小结

- 单片机入门之c51语言

- ACM入门 系统地向初学ACM的同学讲解ACM的注意事项