图神经网络在自然语言处理中的最新进展与应用

需积分: 9 76 浏览量

更新于2024-07-16

收藏 14.39MB PDF 举报

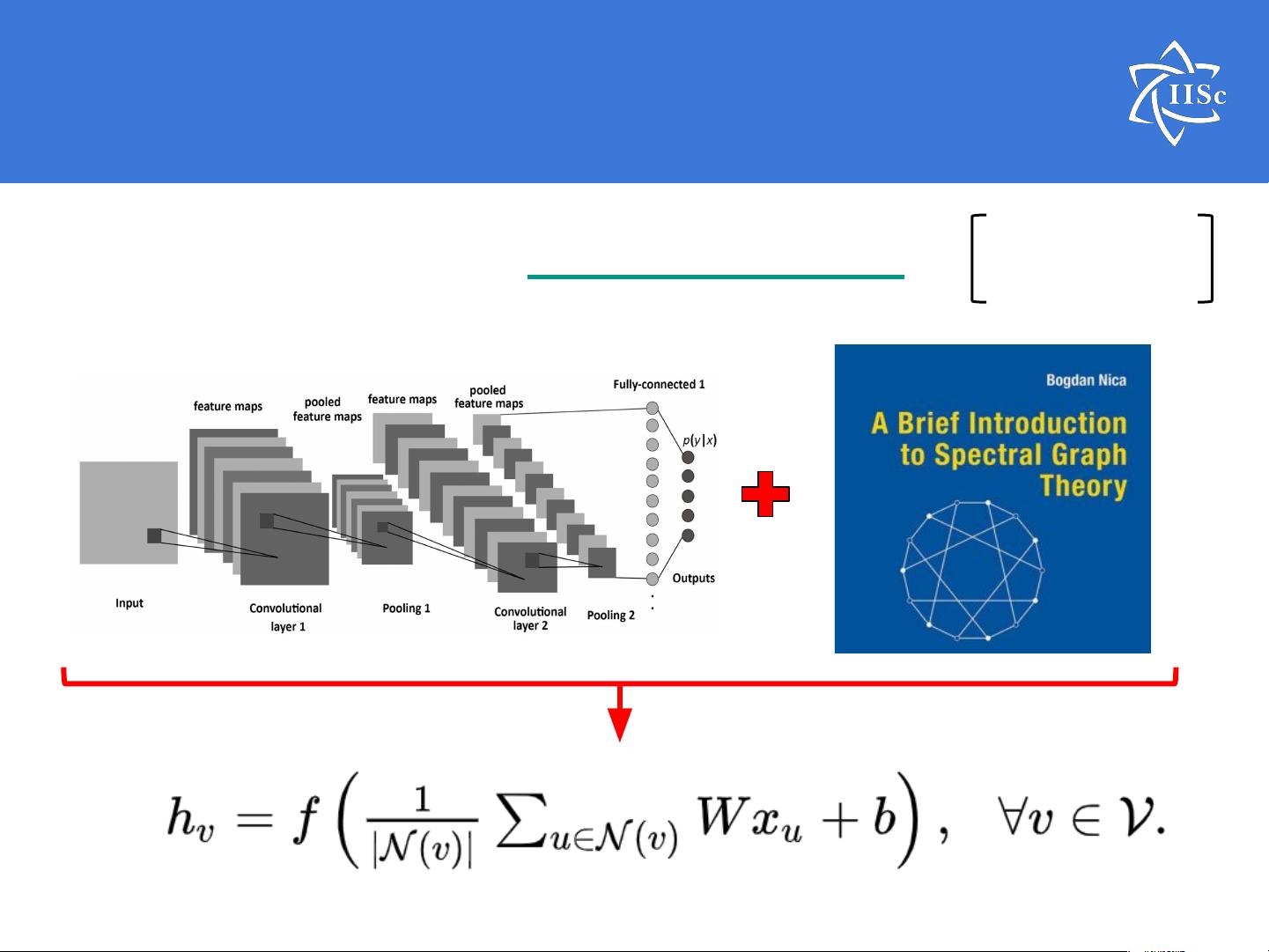

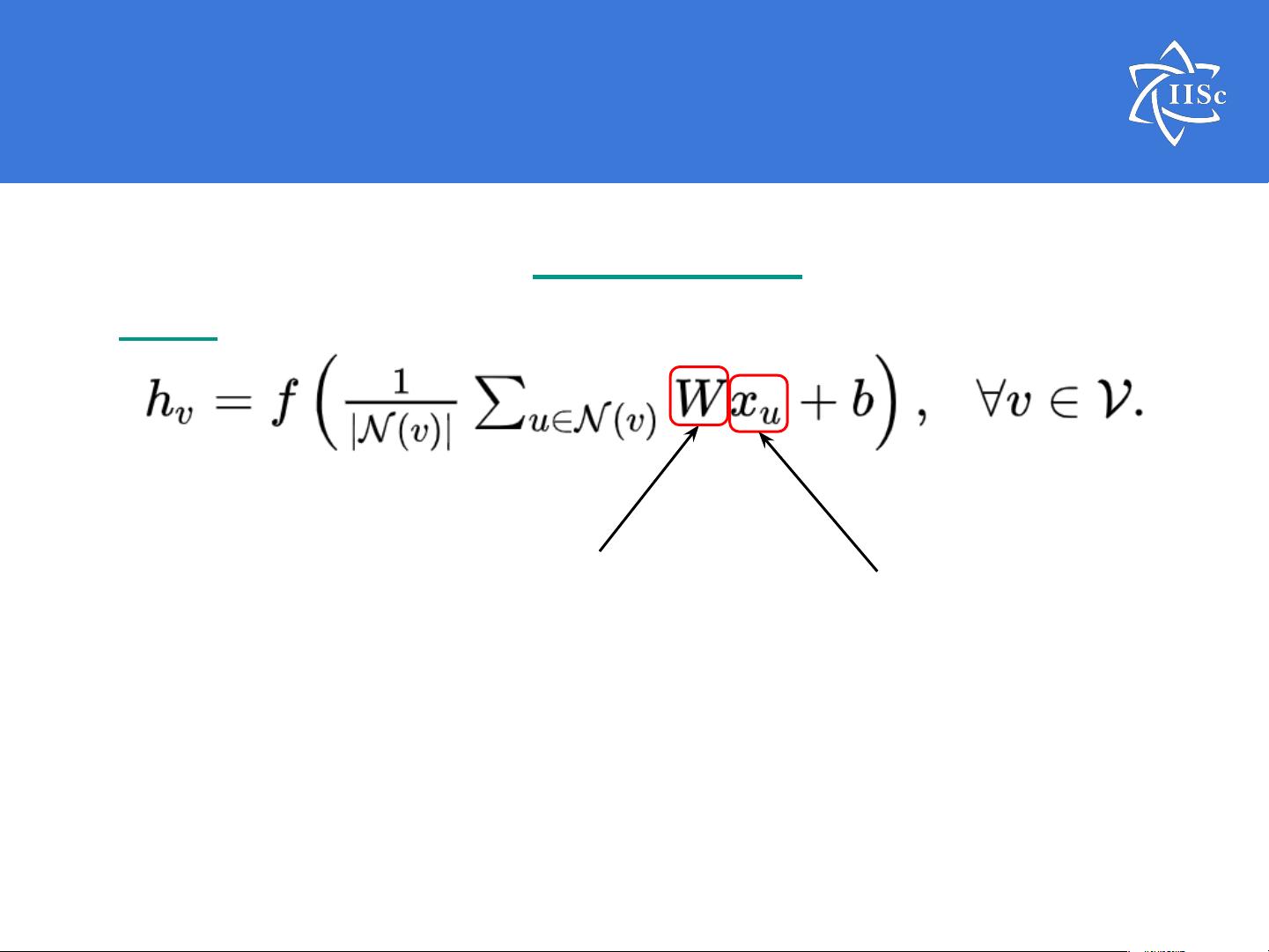

本教程是关于EMNLP2019年香港会议上的一篇论文,标题为"Graph Neural Networks for Natural Language Processing (NLP)"。该教程旨在深入探讨图神经网络(Graph Neural Networks, GNNs)在自然语言处理领域的最新进展,特别是针对Graph Convolutional Networks (GCNs) 的应用。作者们来自印度班加罗尔的印度科学学院,强调了在NLP中广泛使用图形结构的重要性,因为它们在诸如句法驱动的机器翻译(Syntax-based MT)、关系抽取等任务中发挥着关键作用。

传统的深度学习方法,如递归网络和Transformer,虽然在NLP中取得了显著成就,但如何有效地整合图结构是一个尚未解决的问题。随着图SSL(图半监督学习)和Label Propagation等技术的发展,图神经网络开始崭露头角,它们不仅能学习节点和图的嵌入,还能处理超越简单相似性的关系,并且通常表现出更好的性能。

教程的核心内容包括以下几个部分:

1. **介绍**:阐述了图神经网络在NLP中的兴起背景,以及为什么在这个领域采用图结构而非传统的深度学习模型,例如它能处理复杂的关系和动态结构。

2. **动机与应用**:引用了一些早期研究,如Bunescu和Mooney(2005)和Yamada和Knight(2001)的工作,这些研究展示了图在机器翻译和其他任务中的实际应用。

3. **图神经网络的优势**:对比了图神经网络与图SSL/LP的方法,强调了GNNs的学习能力,它们能够捕捉节点之间的复杂关系,并通过隐式正则化提升模型效果。

4. **GNNs在NLP任务中的应用**:详细讨论了GNNs在诸如语义角色标注、机器翻译、关系抽取等任务中的具体应用实例,展现其在处理NLP问题上的实用性。

5. **教程大纲**:概述了整个教程的结构,包括对基础概念的介绍,技术细节的演示,以及可能的实践案例分析。

这篇教程提供了深入理解图神经网络在NLP中的关键技术和应用的宝贵资源,适合那些希望在这一领域进一步探索的学者和从业者。通过阅读此教程,读者将能够掌握如何利用GCNs和其他GNN技术来解决NLP中的挑战,并了解它们相对于传统方法的优越性。

2021-03-20 上传

2021-03-12 上传

2021-02-21 上传

2023-10-20 上传

2023-10-20 上传

2022-06-28 上传

2023-08-12 上传

2020-09-09 上传

yi-anchen

- 粉丝: 0

- 资源: 1

最新资源

- Python中快速友好的MessagePack序列化库msgspec

- 大学生社团管理系统设计与实现

- 基于Netbeans和JavaFX的宿舍管理系统开发与实践

- NodeJS打造Discord机器人:kazzcord功能全解析

- 小学教学与管理一体化:校务管理系统v***

- AppDeploy neXtGen:无需代理的Windows AD集成软件自动分发

- 基于SSM和JSP技术的网上商城系统开发

- 探索ANOIRA16的GitHub托管测试网站之路

- 语音性别识别:机器学习模型的精确度提升策略

- 利用MATLAB代码让古董486电脑焕发新生

- Erlang VM上的分布式生命游戏实现与Elixir设计

- 一键下载管理 - Go to Downloads-crx插件

- Java SSM框架开发的客户关系管理系统

- 使用SQL数据库和Django开发应用程序指南

- Spring Security实战指南:详细示例与应用

- Quarkus项目测试展示柜:Cucumber与FitNesse实践