揭秘Spark Shuffle:性能优化关键与实现机制

189 浏览量

更新于2024-08-30

收藏 204KB PDF 举报

在Spark源码系列的第六篇文章中,作者深入剖析了Shuffle这一关键操作在Spark中的重要性及其对性能的影响。Shuffle是Spark基于RDD操作模型中的核心步骤,特别是当执行诸如`reduceByKey`、`groupByKey`等聚合操作时,会触发数据的重新分布和计算。这些操作的核心在于将数据集按照键值对进行划分,然后将相同键的值进行聚合。

首先,作者指出在`reduceByKey`函数中,用户可以指定分区的数量(`numPartitions`),这是为了控制数据的并行处理程度。如果不指定,Spark会根据默认规则或配置自动决定分区数量。具体来说:

1. 如果用户自定义了分区函数`partitioner`,则会按照该函数进行数据划分。

2. 如果没有自定义分区,Spark会根据`spark.default.parallelism`的配置来决定,这是用户设置的默认并行度。

3. 若`spark.default.parallelism`也没有设置,那么就会使用输入数据本身的分片数量,这在处理Hadoop输入数据时尤为重要,因为可能涉及到额外的逻辑处理。

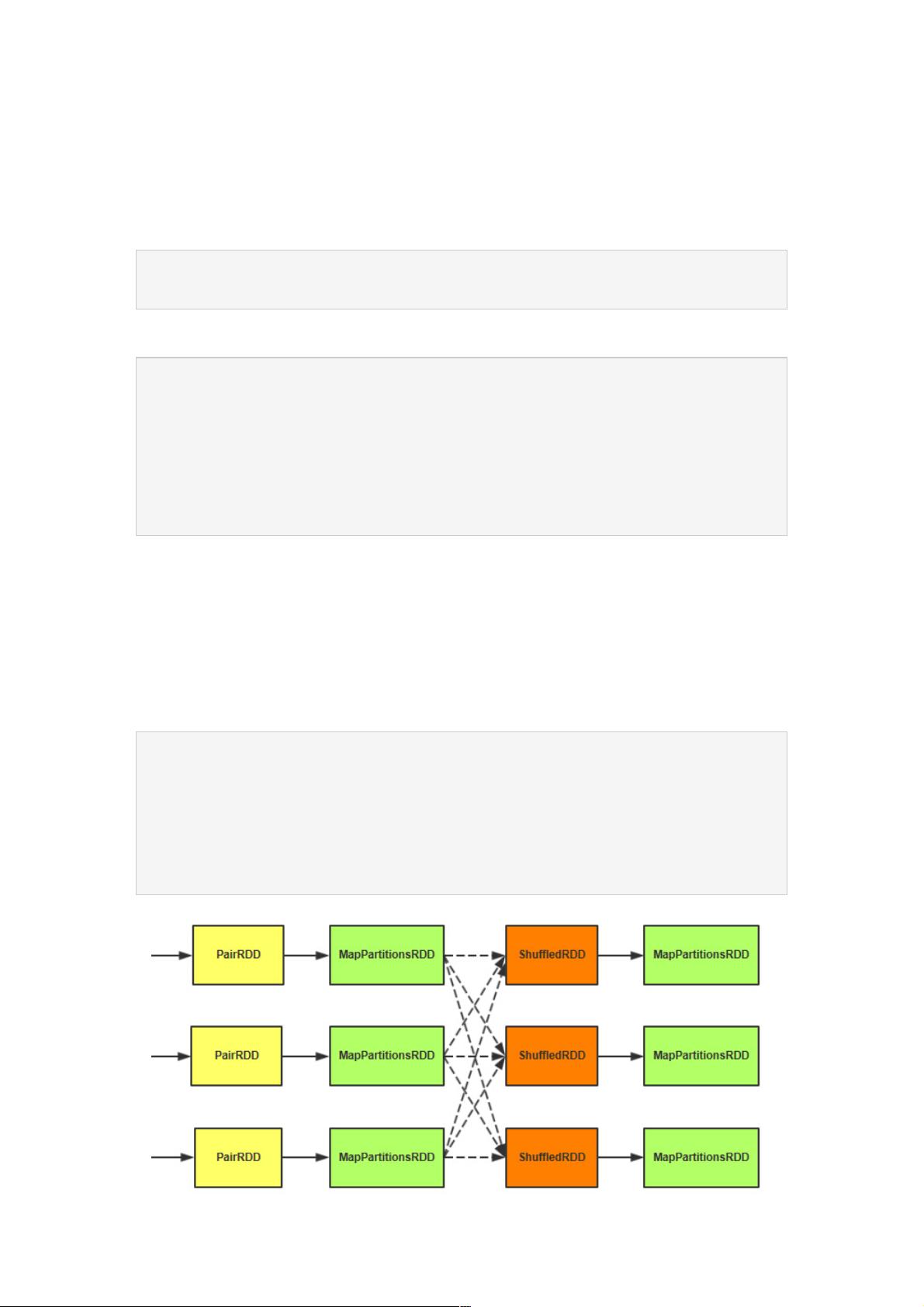

Shuffle过程本身包括以下几个步骤:

- 数据划分:原始RDD的元素会被分配到不同的分区中,每个分区负责一部分键值对。

- 数据交换:分区之间的数据通过网络进行交换,确保具有相同键的值聚集在一起。

- 聚合计算:接收数据的分区对相同键的值进行`func`函数的聚合操作。

- 结果合并:各个分区的聚合结果被收集起来,形成最终的键值对结果。

整个过程对于Spark性能至关重要,因为它决定了数据的分布策略和通信开销。理解并优化Shuffle操作有助于提高Spark应用程序的运行效率和吞吐量,尤其是在大数据处理场景下。因此,掌握Shuffle的工作原理对于开发Spark应用的工程师来说是必不可少的技能。

158 浏览量

610 浏览量

861 浏览量

113 浏览量

162 浏览量

124 浏览量

345 浏览量

110 浏览量

250 浏览量

weixin_38729269

- 粉丝: 4

- 资源: 851

最新资源

- saturn::globe_with_meridians:新的迷你快速浏览器

- 企业前台大厅模型设计

- 基于python+django+vue开发的工作数据获取与可视化

- NodeJS-Sample-Project:使用Express的节点Js上的样本项目,具有基本结构和数据库连接

- 战利品

- myBinomTest(s,n,p,Sided):具有任意二项式概率的 1 或 2 边二项式检验-matlab开发

- 银行存款余额调节表格excel模版下载

- 演唱会舞台3D模型

- autoprop:从访问器方法推断属性

- ABAssignment04

- 物品交接明细表excel模版下载

- desafio_conceitos_node

- vewa_app2:VEWA 网络应用程序

- 中式现代风会议室模型

- gritjz.github.io:史蒂芬·张的个人网站

- 工程质量验收记录表excel模版下载