探索Microsoft Lync Online Web App:无客户端参会指南

需积分: 9 59 浏览量

更新于2024-09-13

收藏 552KB PPTX 举报

"微软Lync Online Web App培训课程"

微软Lync Online Web App是一款基于浏览器的应用,用于参加和参与Lync Online会议,尤其适合那些没有安装Lync Online客户端或账户的用户。它允许用户无需额外安装软件即可参与到在线会议中。Lync Web App的核心依赖于微软的Silverlight插件,如果在用户的计算机上未检测到,系统会在加入会议时提供下载和安装的选项。

课程内容主要包括以下几个方面:

1. **Lync Web App概述**:讲解Lync Web App的功能和使用方式。演示者可以在会议中移动已由其他演示者上传的幻灯片。此外,任何与会者在会议进行过程中都可能被提升为演示者,这增加了会议的互动性和灵活性。

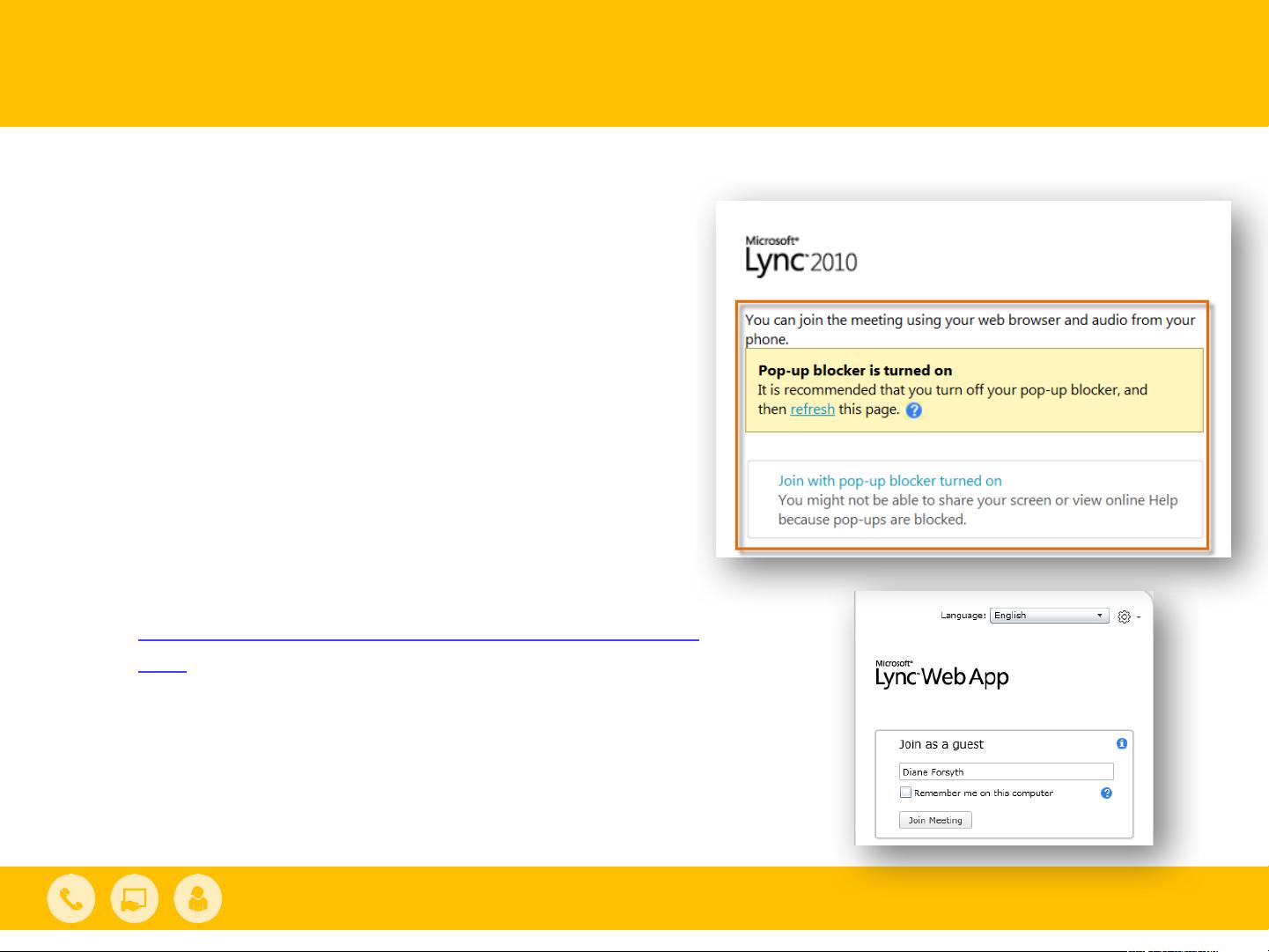

2. **在线会议体验**:详细介绍如何加入在线会议,以及作为嘉宾加入时的流程。参与者需要输入自己的名字,然后点击“加入会议”。在加入过程中,系统会自动检查并引导用户安装必要的Silverlight插件。

3. **会议音频**:如果组织者的账户启用了音频会议功能,会议中可以使用电话会议进行音频交流。这意味着与会者可以通过电话接入,无论他们身处何处,只要有网络连接,就能参与到会议中。

4. **管理你的会议**:这部分将教授如何在会议中执行各种管理任务,如控制权限、共享屏幕、邀请他人、管理聊天窗口等。对于会议主持人来说,掌握这些技巧至关重要,可以确保会议高效有序地进行。

5. **附录**:可能包含一些补充材料、常见问题解答、技术规格或其他辅助信息,帮助用户更好地理解和使用Lync Web App。

通过这次培训,用户不仅可以了解Lync Online的基本操作,还能掌握如何充分利用Lync Web App的各种特性,以提高远程协作的效率和质量。对于经常需要进行在线沟通和协作的团队成员,掌握这些技能是至关重要的。

2018-10-10 上传

2023-05-20 上传

2023-05-20 上传

2023-06-13 上传

2023-09-18 上传

2023-06-06 上传

2024-09-21 上传

MichaelTomas

- 粉丝: 0

- 资源: 2

最新资源

- ExtJS 2.0 入门教程与开发指南

- 基于TMS320F2812的能量回馈调速系统设计

- SIP协议详解:RFC3261与即时消息RFC3428

- DM642与CMOS图像传感器接口设计与实现

- Windows Embedded CE6.0安装与开发环境搭建指南

- Eclipse插件开发入门与实践指南

- IEEE 802.16-2004标准详解:固定无线宽带WiMax技术

- AIX平台上的数据库性能优化实战

- ESXi 4.1全面配置教程:从网络到安全与实用工具详解

- VMware ESXi Installable与vCenter Server 4.1 安装步骤详解

- TI MSP430超低功耗单片机选型与应用指南

- DOS环境下的DEBUG调试工具详细指南

- VMware vCenter Converter 4.2 安装与管理实战指南

- HP QTP与QC结合构建业务组件自动化测试框架

- JsEclipse安装配置全攻略

- Daubechies小波构造及MATLAB实现