信息论与纠错编码(第2版)习题解析:概率、信息熵与编码理论

"《信息论与纠错编码(第2版)》是孙丽华教授编著的一本关于信息论和纠错编码理论的教材,其中包含了习题解答,旨在帮助学生深入理解和掌握相关知识。这本书涵盖了信息的度量、熵、条件熵、互信息等基本概念,以及无失真编码和纠错编码的原理与应用。"

以下是根据提供的部分内容解释的相关知识点:

1. **信息论基础**

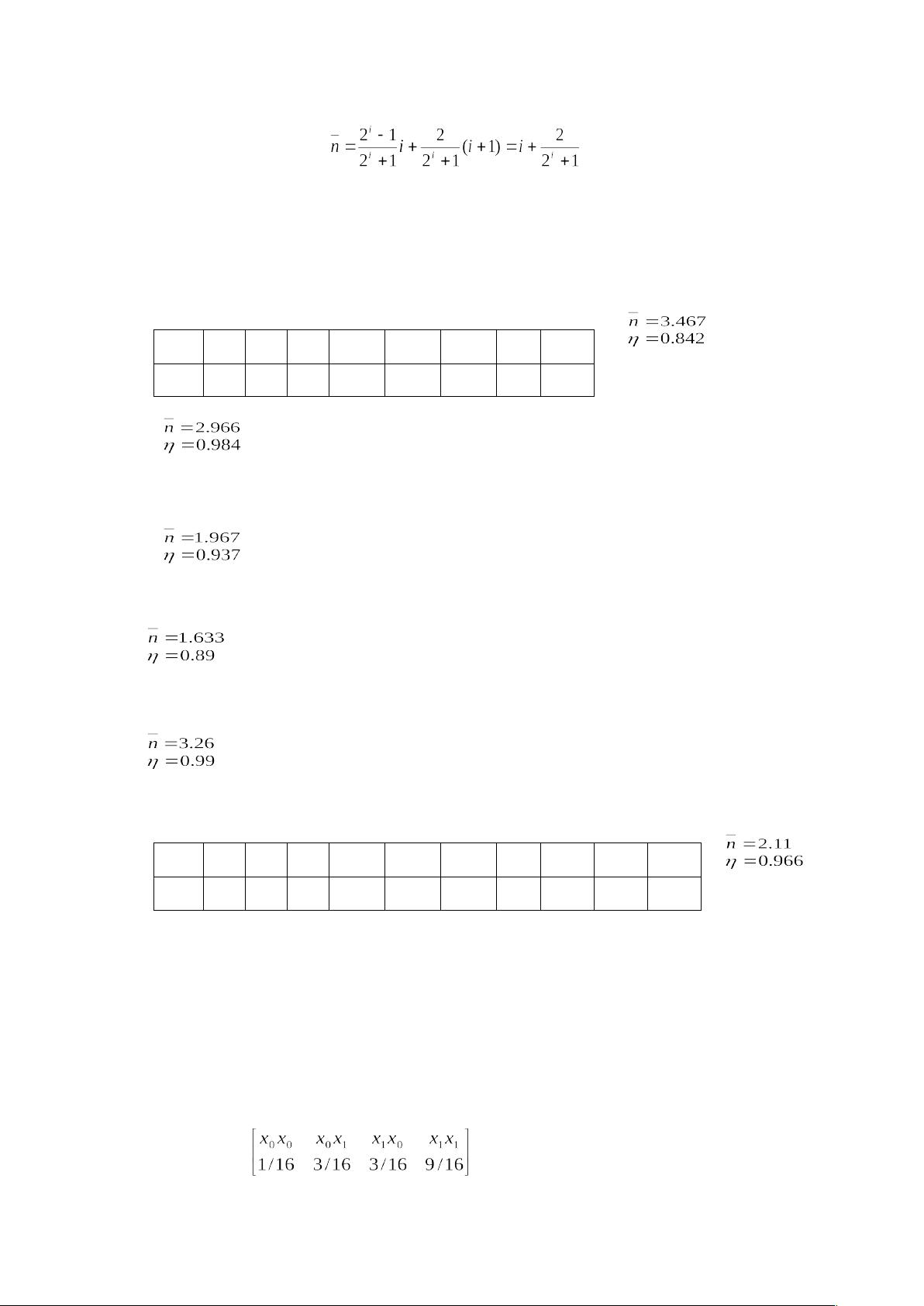

- **熵(Entropy)**:熵是衡量一个随机变量不确定性或信息量的度量,公式通常表示为H(X) = -∑ p(x) * log2(p(x)),其中p(x)是随机变量X的每个可能值的概率。

- **条件熵(Conditional Entropy)**:H(Y|X) 表示在已知随机变量X的情况下,随机变量Y的不确定性,它描述了在知道X的信息后Y的剩余不确定性。

- **互信息(Mutual Information)**:I(X;Y) 表示X和Y之间的相互依赖程度,是X和Y联合熵H(X,Y)与它们的边缘熵H(X)和H(Y)之差。

2. **信息的度量**

- **比特/符号(Bit/Symbol)**:这是衡量每发送一个符号所传输的信息量的单位。

- **二进制对数(Log base 2)**:在信息论中,通常使用以2为底的对数来计算熵和互信息,因为二进制是数据的基本传输单位。

3. **无失真编码**

- **最小码长定理**:对于离散信源,存在一种编码方式,使得每个消息都能被唯一地表示,并且期望码长等于信源的熵,这是无失真编码的一个关键特性。

- **紧致码**:如果每个消息都能被编码为不超过某个最大码长的码字,则称该码为紧致码。

4. **纠错编码**

- **纠错能力**:通过增加冗余信息,纠错编码可以检测和纠正传输过程中引入的错误,确保信息的正确接收。

以上知识点是信息论与纠错编码领域的核心概念,它们在通信、数据存储和网络传输等领域有着广泛应用。通过学习和解决书中的习题,读者可以加深对这些概念的理解并掌握如何计算和应用它们。

相关推荐

kukrilove

- 粉丝: 0

最新资源

- ALonelyPlace: 探索太空与海洋的诗歌艺术之旅

- 分析Python urllib2模块HTTP基本认证Bug与HTTPError处理

- 宠物管理系统:适合学习的简单JavaWeb程序

- 深入理解C++/C编程技巧与最佳实践

- C++实现的蜘蛛纸牌游戏详解

- WIN32API实现的高效关机小程序功能介绍

- 高效背单词小程序:记录与巩固生词神器

- 精选3款404错误页面模板免费下载

- C语言实现LDPC编码解码技术详解

- 图解GSM第三层信令及基础知识

- 深入理解缓存技术及其应用

- ASP网上书店数据库设计与后台管理

- ML-KNN-Bayes:基于Scikit-Learn的分类器构建与比较

- 微信界面与元素的高清图片集锦

- Android引导动画实现与sharepreferences应用教程

- 遗传算法在动力配煤中的GUI界面实现及MATLAB调试