掌握机器学习基石:最优化方法概览与关键知识点

需积分: 0 45 浏览量

更新于2024-06-22

2

收藏 4.21MB PDF 举报

最优化方法知识点总结涵盖了人工智能和机器学习领域中的核心数学知识,对深入理解和支持这些复杂算法至关重要。以下是主要内容概要:

1. 引言:

- 学会理解基本概念,如可行点和可行集,区分全局极小点和局部极小点。

- 范数的定义及其在验证集合与序列中的应用,掌握Hesse矩阵的求法。

- 凸集和凸函数的理解,掌握如何判断一个函数是否为凸函数及其极值点。

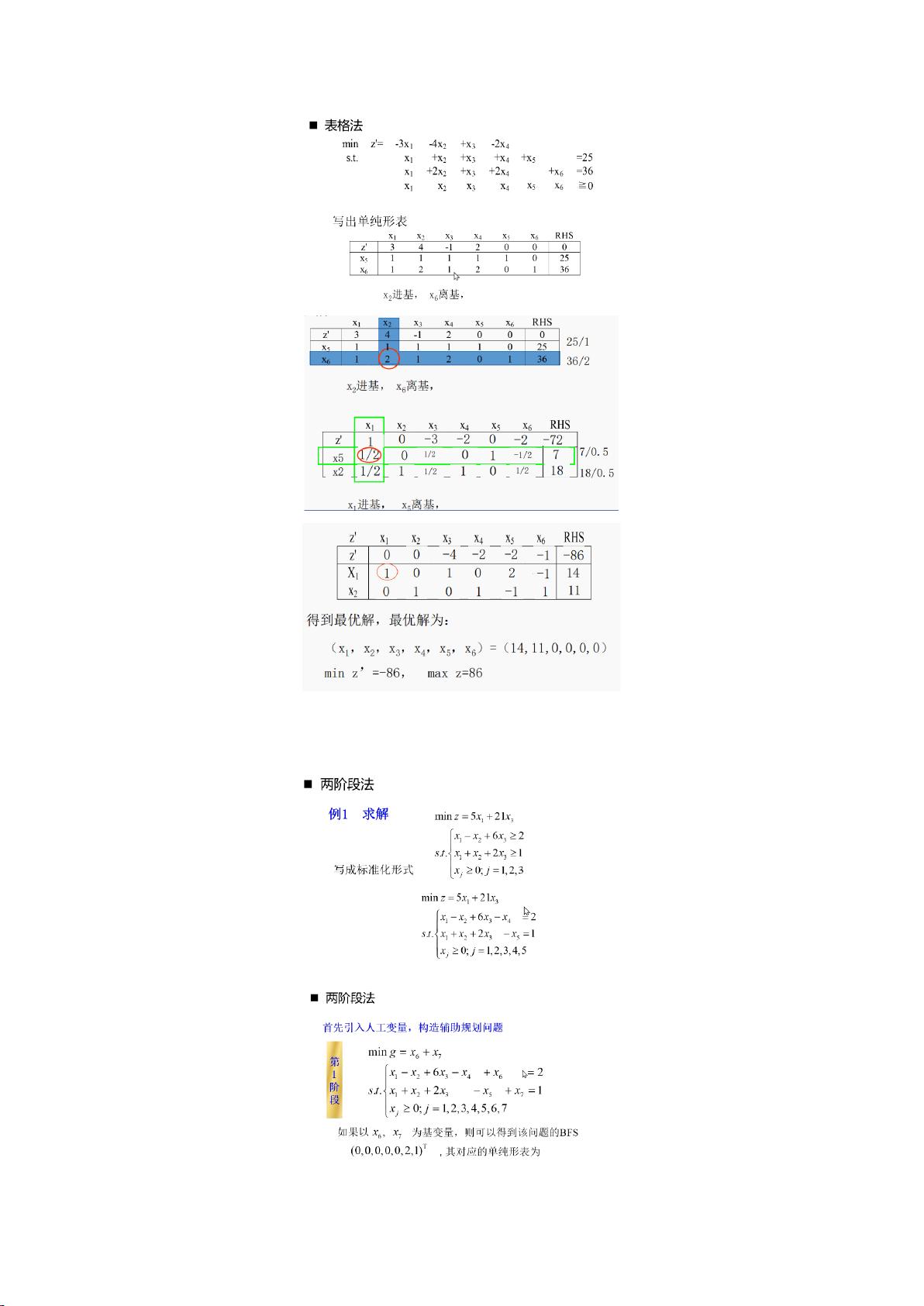

2. 线性规划:

- 基本解与基本可行解的区分,理解基本可行解个数的上限。

- 单纯形方法是关键,关注如何用表格法求解并识别最优解和最优值。

- 大M法的应用,虽然不涉及退化情形,但在特定情况下可能作为辅助工具。

3. 对偶原理与灵敏度分析:

- 掌握对偶理论,能写出对称和非对称形式的对偶问题。

- 灵敏度分析涉及到问题中参数变化对最优解的影响,通过改变c或a来观察响应。

4. 最优性条件:

- 必须熟悉连续可微的条件,理解和应用F-T条件和KKT条件。

- KKT点的判断在机器学习如SVM中有重要应用,但考试通常不直接测试KKT条件的二阶条件。

5. 一维搜索:

- 学习三种基本的试探方法:0.618法、Fibonacci法和进退法,理解它们的迭代公式和关系。

- 牛顿法的迭代公式和二阶收敛性是重要知识点,尽管抛物线方法和三次插值方法不列入考试范围。

6. 使用导数的最优化方法:

- 最速下降方法是基础,了解与牛顿方法的关系。

- 牛顿方法强调至少二阶收敛,提供典型应用实例。

- 阻尼牛顿方法和修正牛顿方法具有全局收敛性,共轭梯度方法(F-R方法)是考试的重点。

总结来说,这份知识点总结强调了最优化方法在人工智能和机器学习中的实际应用,特别是与线性规划、凸优化、一维搜索和梯度相关的数学工具。理解和掌握这些内容有助于更好地设计和理解复杂的机器学习模型,如SVM和神经网络。

2023-08-18 上传

2021-12-22 上传

2022-01-08 上传

2020-11-23 上传

2023-07-28 上传

2021-12-22 上传

猪猪的超超

- 粉丝: 702

- 资源: 5

最新资源

- 黑板风格计算机毕业答辩PPT模板下载

- CodeSandbox实现ListView快速创建指南

- Node.js脚本实现WXR文件到Postgres数据库帖子导入

- 清新简约创意三角毕业论文答辩PPT模板

- DISCORD-JS-CRUD:提升 Discord 机器人开发体验

- Node.js v4.3.2版本Linux ARM64平台运行时环境发布

- SQLight:C++11编写的轻量级MySQL客户端

- 计算机专业毕业论文答辩PPT模板

- Wireshark网络抓包工具的使用与数据包解析

- Wild Match Map: JavaScript中实现通配符映射与事件绑定

- 毕业答辩利器:蝶恋花毕业设计PPT模板

- Node.js深度解析:高性能Web服务器与实时应用构建

- 掌握深度图技术:游戏开发中的绚丽应用案例

- Dart语言的HTTP扩展包功能详解

- MoonMaker: 投资组合加固神器,助力$GME投资者登月

- 计算机毕业设计答辩PPT模板下载

已收录资源合集

已收录资源合集