深度学习驱动的端到端语音分离技术概述与应用

版权申诉

190 浏览量

更新于2024-07-05

收藏 3.41MB PDF 举报

端到端语音分离技术及应用.pdf是一份深度解析了2022年先进的语音分离技术及其在实际场景中的应用的精品研究报告。该报告重点关注于深度学习在语音分离领域的最新进展,涵盖了从理论框架到实践方案的全面介绍。

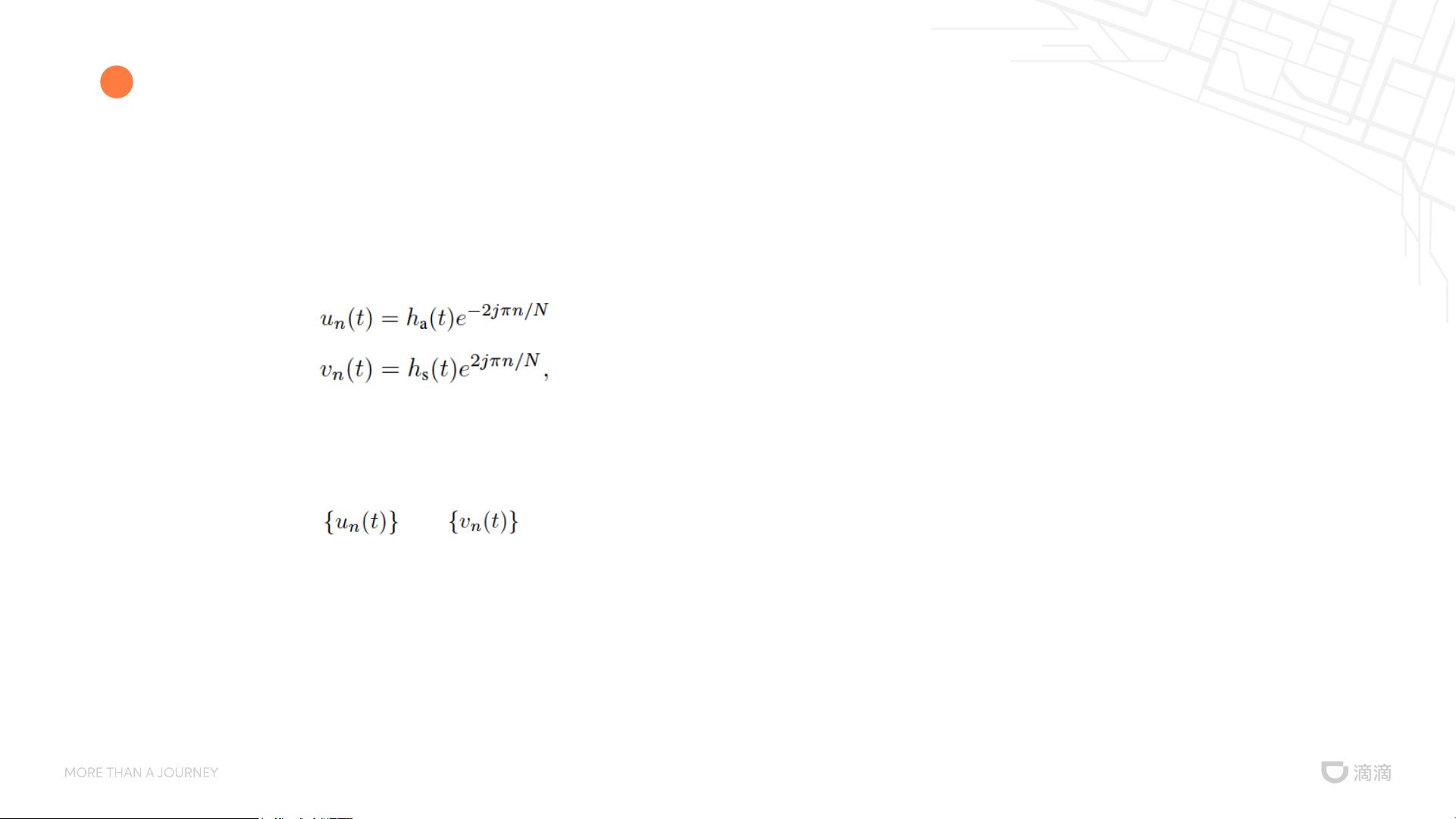

报告首先概述了语音分离的基本概念,它旨在从混杂的声音信号中分离出各个单独的语音源。技术的核心在于一种基于深度学习的方法,采用编码器-分离器-解码器的形式。这种结构允许信号在频域或时域进行处理,提供了两种主要的分离策略:

1. 频域方法:利用频谱分析,如短时傅立叶变换(STFT),将音频信号转换成频谱图,然后通过深度网络学习每个语音源的独立特征,并生成相应的掩码进行分离。这些掩码用于在频域内对原始信号进行多通道处理。

2. 时域方法:则更倾向于直接处理时间序列数据,例如使用循环神经网络(RNN)或卷积神经网络(CNN),在网络中捕捉到语音信号的时间相关性,通过时序建模来实现分离。

报告还区分了两种主要的分离方法:

- 分离基方法:这种方法强调通过学习每个语音源的特性,然后在隐藏空间中进行分离,最终通过解码器恢复原始信号。

- 波束形成法:这是一种基于阵列信号处理的技术,通过对多个麦克风接收到的信号进行加权处理,通过方向性滤波来分离不同方向的声源。

报告详细介绍了每个部分的最新状态,包括当前研究的挑战和未来发展趋势。例如,编码器的设计需要不断优化,以更好地捕捉声音特征;分离器的性能依赖于模型的复杂性和训练数据的质量;而解码器则需确保分离后的信号重建准确且无失真。

结论部分探讨了端到端语音分离技术面临的局限性,如噪声抑制、多说话人场景处理以及实时性问题,同时也提出了潜在的研究方向,比如联合语音识别与分离的集成系统、以及结合深度学习与传统信号处理方法的融合策略。

总体来说,这份报告为深入理解深度学习在语音分离领域的应用提供了有价值的知识框架和技术指南,对于从事语音处理、人工智能、通信工程等领域的专业人士具有很高的参考价值。

2021-08-10 上传

2021-08-31 上传

2021-08-31 上传

点击了解资源详情

2019-11-01 上传

2022-04-23 上传

2021-09-04 上传

2021-08-29 上传

2021-08-31 上传

Build前沿

- 粉丝: 728

- 资源: 2113

最新资源

- 构建基于Django和Stripe的SaaS应用教程

- Symfony2框架打造的RESTful问答系统icare-server

- 蓝桥杯Python试题解析与答案题库

- Go语言实现NWA到WAV文件格式转换工具

- 基于Django的医患管理系统应用

- Jenkins工作流插件开发指南:支持Workflow Python模块

- Java红酒网站项目源码解析与系统开源介绍

- Underworld Exporter资产定义文件详解

- Java版Crash Bandicoot资源库:逆向工程与源码分享

- Spring Boot Starter 自动IP计数功能实现指南

- 我的世界牛顿物理学模组深入解析

- STM32单片机工程创建详解与模板应用

- GDG堪萨斯城代码实验室:离子与火力基地示例应用

- Android Capstone项目:实现Potlatch服务器与OAuth2.0认证

- Cbit类:简化计算封装与异步任务处理

- Java8兼容的FullContact API Java客户端库介绍