机器学习公式大全:从朴素贝叶斯到EM算法

需积分: 14 65 浏览量

更新于2024-07-17

收藏 20.32MB PDF 举报

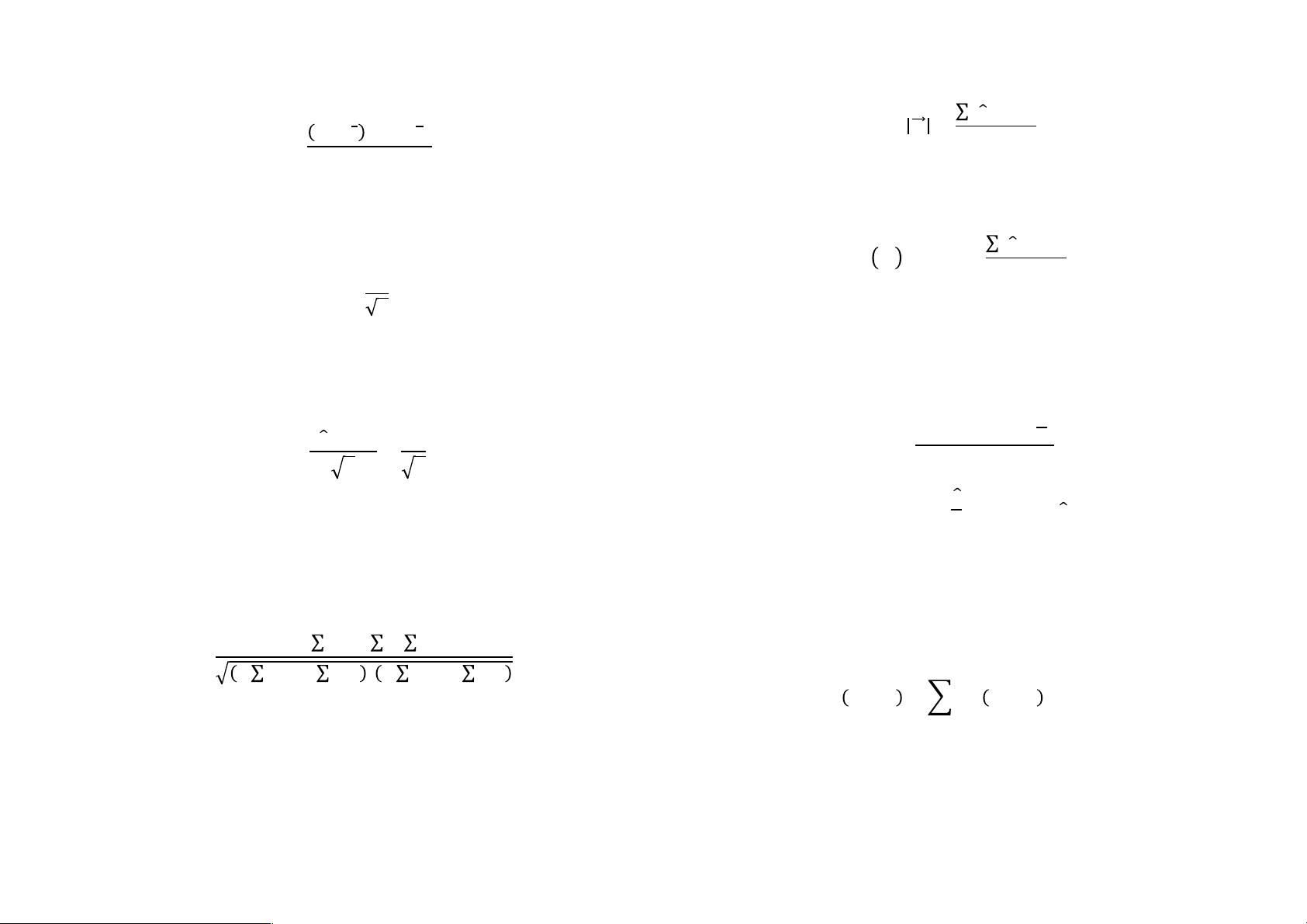

"140个机器学习公式" 是一个包含大量与机器学习相关的数学公式的集合,旨在作为查询工具,帮助用户理解和应用各种机器学习算法。这些公式涵盖了矩阵运算、概率论、贝叶斯理论等多个核心领域。

一、基础概率论公式

1. 贝叶斯定理:𝑃𝑎𝑐=𝑃𝑐𝑎.𝑃(𝑎) / 𝑃(𝑐),用于计算在给定证据条件下某一假设的概率。

2. 最大后验估计(MAP):ℎ!"#=argmax𝑃𝑐|𝑎.𝑃(𝑎),寻找最可能的类别或参数估计。

3. 最大似然估计(MLE):ℎ!"=argmax𝑃𝑐|𝑎,根据数据最大化模型对观测数据的似然性。

二、贝叶斯学习公式

1. 最优贝叶斯分类器:argmax𝑃𝑥𝑇.𝑃(𝑇|𝐷),选取使后验概率最大的类别。

2. 朴素贝叶斯分类器:argmax𝑃𝑆𝑝𝑜|𝑇𝑜𝑡.𝑃(𝑆𝑜𝑐|𝑆𝑝𝑜),基于特征独立假设进行分类。

3. 贝叶斯决策边界:通过比较不同类别的后验概率来确定分类决策。

三、统计与推断

1. 总概率法则:𝑇𝑜𝑡𝑎𝑙𝑃𝐵=𝑃𝐵|𝐴.𝑃(𝐴),用于计算复合事件的概率。

2. 混合模型:𝑃𝐵=𝑃𝐵|𝐴.𝑃(𝐴),表示混合分布的总体概率。

3. 高斯混合模型异常检测:𝑃𝑥𝑥=1/(2𝜋𝜎!).𝑒^(-1/2*(𝑥-𝑥)^2/𝜎^2),计算单变量正态分布的概率密度函数。

4. 贝叶斯网络:涉及条件概率的计算,如𝑡𝑢𝑝𝑙𝑒𝑠¬𝑓𝑜𝑟𝑦=0∧𝑦=1,表示给定某些父节点时,子节点的条件概率。

四、数值计算与优化

1. 拉普拉斯平滑:𝑃𝐴=(𝐴+0.5) / (𝐴+𝐵+1),用于处理计数问题中的零频率问题。

2. EM算法:E步骤更新条件概率𝑃𝑥|𝑥,M步骤更新参数𝑃𝑥′,通过迭代逼近最大似然解。

五、微积分与导数

1. 导数计算:如𝜕

𝜕𝑥𝑥!=𝑛.𝑥!!! 和 𝜕

𝜕𝑥𝑦!=𝜕𝑦!

𝜕𝑦.𝜕𝑦

𝜕𝑥,用于求解函数的斜率和曲线变化。

2. 乘积规则:𝑑

𝑑𝑥𝑓𝑥.𝑔𝑥=𝑓′𝑥𝑔𝑥+𝑓𝑥.𝑔′(𝑥),表示两个函数乘积的导数。

这些公式是机器学习中的基础工具,理解并能灵活运用它们对于掌握机器学习的核心概念至关重要。通过深入学习和实践,可以更有效地解决实际的机器学习问题。

283 浏览量

137 浏览量

181 浏览量

点击了解资源详情

2024-12-31 上传

349 浏览量

173 浏览量

172 浏览量

涯若

- 粉丝: 57

最新资源

- Verilog实现的Xilinx序列检测器设计教程

- 九度智能SEO优化软件新版发布,提升搜索引擎排名

- EssentialPIM Pro v11.0 便携修改版:全面个人信息管理与同步

- C#源代码的恶作剧外表答题器程序教程

- Weblogic集群配置与优化及常见问题解决方案

- Harvard Dataverse数据的Python Flask API教程

- DNS域名批量解析工具v1.31:功能提升与日志更新

- JavaScript前台表单验证技巧与实例解析

- FLAC二次开发实用论文资料汇总

- JavaScript项目开发实践:Front-Projeto-Final-PS-2019.2解析

- 76云保姆:迅雷云点播免费自动升级体验

- Android SQLite数据库增删改查操作详解

- HTML/CSS/JS基础模板:经典篮球学习项目

- 粒子群算法优化GARVER-6直流配网规划

- Windows版jemalloc内存分配器发布

- 实用强大QQ机器人,你值得拥有