Python实战:构建电影推荐引擎,深度解析协同过滤

版权申诉

100 浏览量

更新于2024-06-26

收藏 1.2MB PDF 举报

本资源是一份名为《Python机器学习项目开发实战:构建推荐引擎》的教程PDF,它专注于在Python环境下构建一个实用的推荐引擎,特别是在电影推荐场景中。推荐引擎是一种关键的机器学习应用,通过预测用户可能的兴趣,帮助用户快速找到相关的内容,提升用户体验并增加用户参与度。

在课程中,主要内容分为以下几个部分:

1. **数据处理与流水线**:

- 介绍数据处理流水线的重要性,这是构建机器学习模型的基础。通过组合基础数据处理函数,避免嵌套或循环,采用函数式编程的方法,创建可重用的数据预处理流程。

2. **机器学习算法基础**:

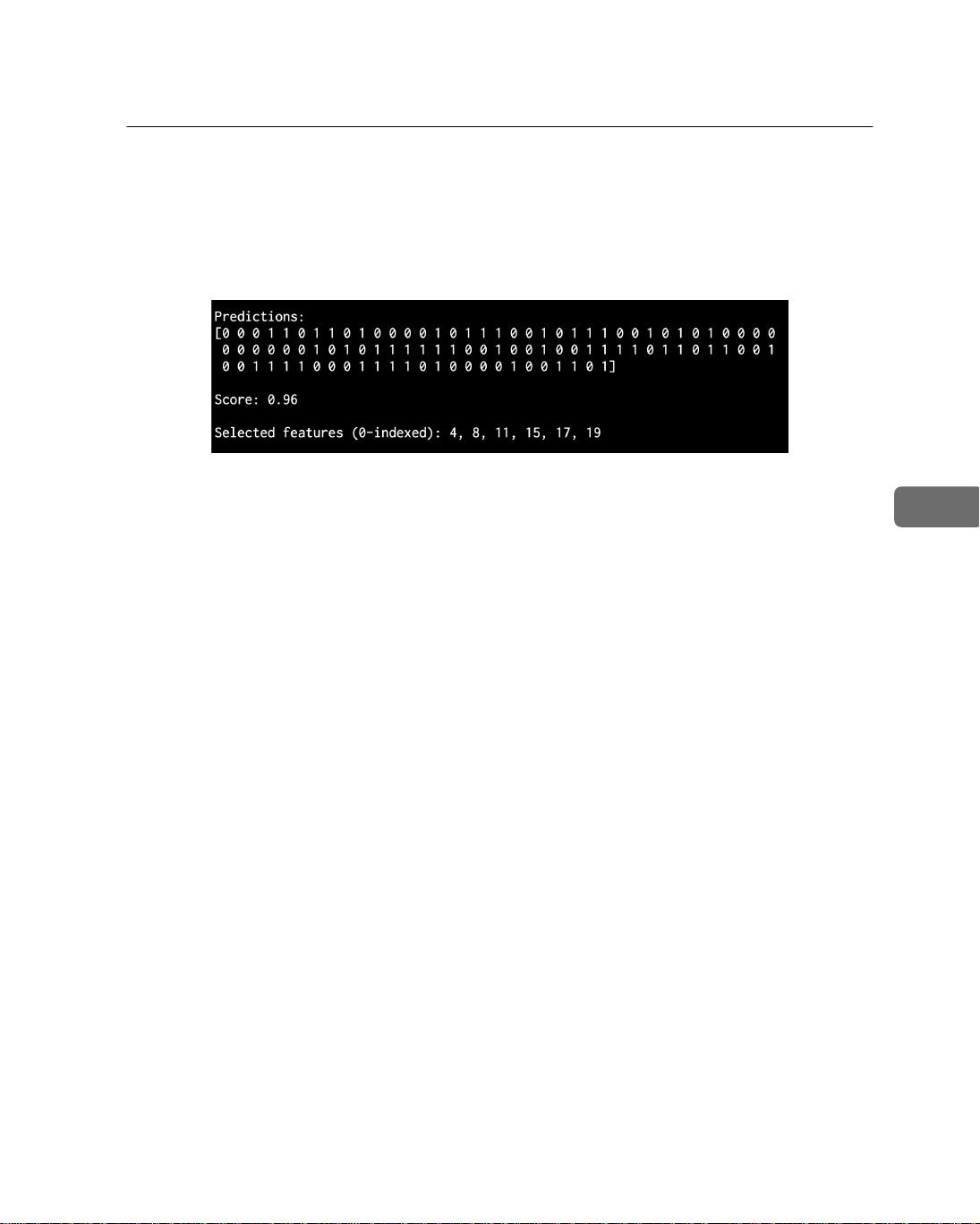

- 包括构建机器学习流水线,如KNN(K-Nearest Neighbors)分类器和回归器的使用。这些算法利用用户历史行为和相似用户的数据来预测用户兴趣。

- 计算欧氏距离分数和皮尔逊相关系数,前者衡量两点之间的空间距离,后者衡量两个变量间的线性相关性。

3. **协同过滤方法**:

- 推荐引擎的核心技术之一是协同过滤,包括两种主要类型:基于用户的协同过滤(User-based Collaborative Filtering),依赖用户行为和评分预测;以及基于物品的协同过滤(Item-based Collaborative Filtering),关注商品间的相似性。

4. **生成电影推荐**:

- 通过应用以上算法和方法,实际操作步骤包括找到相似用户、生成个性化推荐,并展示在电影推荐场景中的应用。

5. **案例分析与实践**:

- 提供具体的编程案例和实例,让读者能够理解和掌握推荐引擎的构建过程,包括编写代码和调试优化。

这份教程适合想要深入了解Python机器学习在推荐系统中的应用,尤其是初学者或希望提升推荐算法能力的开发者。通过学习,学员不仅可以掌握推荐引擎的基本原理,还能掌握在实际项目中实施和优化的方法。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2023-04-01 上传

2023-04-01 上传

2023-05-06 上传

2023-05-06 上传

2023-05-06 上传

2023-04-01 上传

好知识传播者

- 粉丝: 1678

- 资源: 4133

最新资源

- digital-ocean-backup-systems:创建快照并在一个命令中复制到不同区域

- quiz-service:测试服务

- WebLearning:web前端原始码和自我学习

- 基于ssm+vue果蔬商品管理系统.zip

- lib-anim:Android 动画库,动画相关的功能封装,方便使用, 支持动画的with操作和连续动画(组)操作,通过代理支持属性动画中的各种参数设置,完成同样的动画效果可以减少一半以上的y原生代码调用

- 线性调频信号的脉冲压缩_线性调频信号_

- 基于PHP实现的易商(B.A.D)电子商务网_phpshop_电子商务(源代码+html).zip

- quimm:点对点实时事件通知的实验工具

- Canvas-Flowmap-Layer:用于映射对象流的地图层。 扩展Esri JSAPI并在HTML画布上呈现

- 毕业设计 互助教学社区系统.zip

- 毕业设计,基于事理图谱的事件推理系统.zip

- CodeSearchEngineApp:源代码搜索引擎-Java-Search source code

- dotfiles_template:dot构建点文件的模板(使用Dotbot作为安装程序):scroll:

- Claire Magazine LIVE-crx插件

- 16.实现学生成绩查询系统 项目_成绩查询_

- 基于CMS实现的phpwebsite 1.6.2_phpwebsite_1_6_2(使用说明+源代码+html).zip