深度学习笔记:CNN结构与应用详解

需积分: 1 3 浏览量

更新于2024-07-18

收藏 15.96MB DOC 举报

深度学习笔记深入探讨了卷积神经网络(Convolutional Neural Networks,CNN)的相关概念和应用。CNN是一种特殊的神经网络架构,其核心在于其特有的局部感知和参数共享机制。以下是对这些关键知识点的详细阐述:

1. 局部感知:

CNN的设计灵感来源于人类视觉系统的工作原理,人脑对周围环境的理解往往是基于局部信息的处理。在图像处理中,相邻像素之间的关系更为密切,而距离较远的像素相关性较弱。因此,CNN中的每个神经元只关注其局部区域(称为感受野),而不是整个输入图像。这种局部连接方式显著减少了参数数量,使得网络更易于训练。

2. 特征提取层与特征映射:

CNN的核心结构包括特征提取层和特征映射层。特征提取层通过每个神经元与前一层的局部区域相连,提取出这些局部的特征。这种结构保证了特征在不同位置的不变性,如位移不变性。特征映射层由多个共享权重的神经元组成,每个神经元负责检测特定类型的特征,这进一步降低了网络的复杂性。

3. 权值共享:

在特征映射层,神经元之间的权值是相同的,这使得网络可以在同一特征映射上并行学习,提高了计算效率。同时,权值共享减少了网络的自由参数数量,减少了过拟合的风险,使模型更具泛化能力。

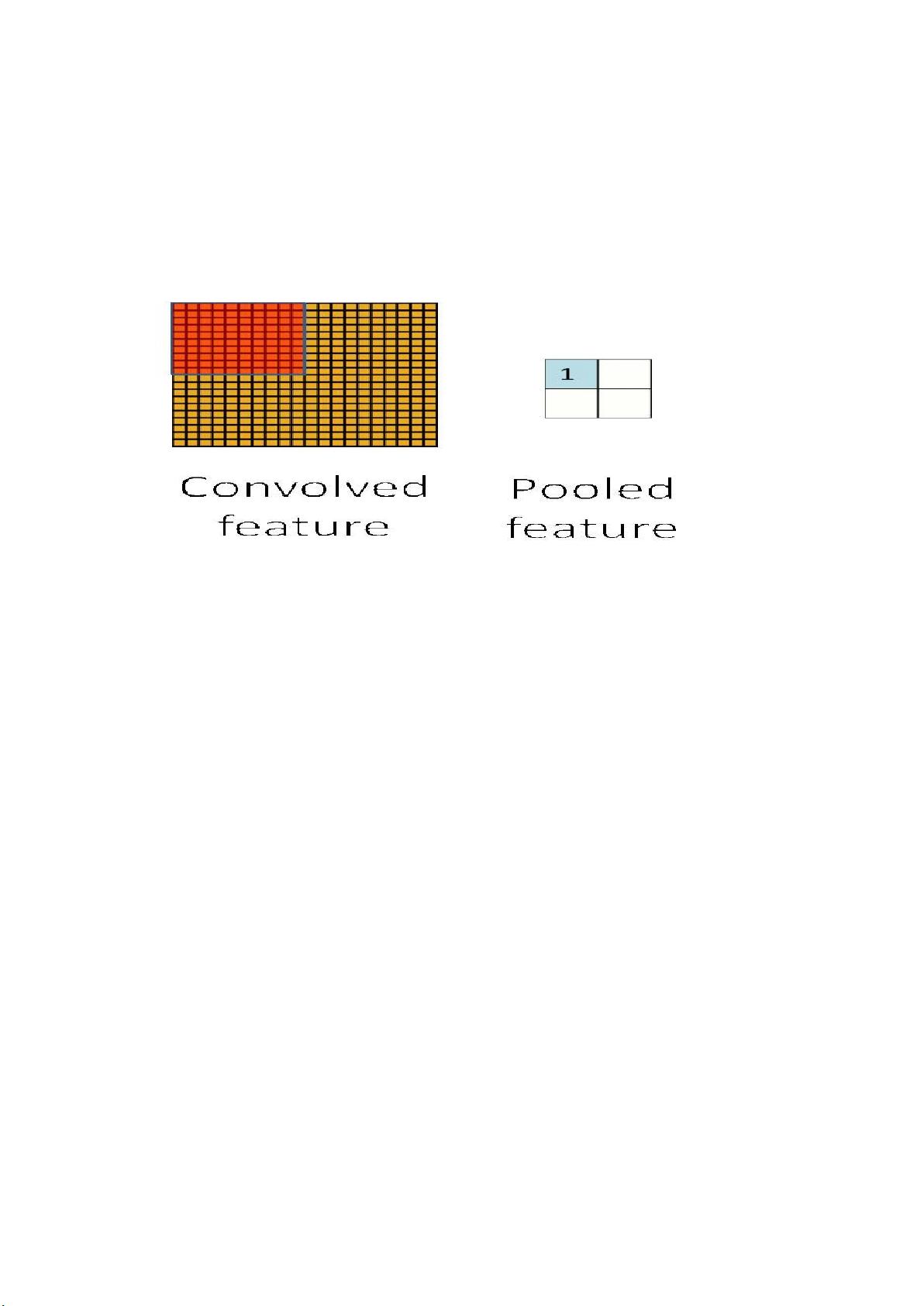

4. 卷积操作与池化:

CNN中的卷积层通过卷积操作提取特征,激活函数通常选择核小的sigmoid函数,确保特征提取的位移不变性。紧随卷积层的是池化层,用于降低特征分辨率,同时保持重要特征,提高模型的计算效率和鲁棒性。

5. 图像处理的应用:

CNN在图像识别、物体检测、人脸识别等领域表现出色,特别适合处理多维度输入的图像。通过减少参数和提高训练速度,CNN能够有效解决大规模图像数据的处理问题,避免了传统神经网络因参数过多而难以训练的问题。

6. 参数优化:

对于大型图像数据集,CNN通过局部感知和参数共享有效地控制了参数数量,使得大规模神经网络的训练成为可能。这极大地推动了图像处理技术的发展,如在自动驾驶、医疗影像分析等领域得到广泛应用。

总结来说,深度学习笔记中的卷积神经网络因其独特的结构和高效性能,在计算机视觉任务中占据主导地位。理解并掌握这些核心概念对于深入研究和实践深度学习至关重要。

522 浏览量

468 浏览量

点击了解资源详情

2024-05-09 上传

263 浏览量

135 浏览量

132 浏览量

weixin_30644767

- 粉丝: 0

最新资源

- Linux下实现语音实时对讲的技术细节

- 鹈鹕主题:Pelican程序员博客模板介绍

- Node.js API设计:清洁架构与测试驱动开发实践

- 基于List存储的订单管理系统实战教程

- React Context实现网站多语言切换教程

- 飞思卡尔MC9S12P128小型发动机ECU源代码解读

- ChipGenius专业版:移动设备芯片检测利器

- 三星775nd打印机官方驱动v3.13.12下载安装指南

- PHP包实现实用DNS记录检索功能

- 深入解析I2C通信协议及PMBus、SMBus子协议

- zanemelzer.github.io:探索前端开发的世界

- JDK 1.8 64位Windows版下载发布

- 创建功能性End2End系统测试工具链

- 实现肖像上传与动画生成的网络应用教程

- 微信小程序开发实践:使用Redux构建待办事项应用

- 免费开源的TortoiseSVN 1.8.4.24972版本客户端介绍