机器学习实战:Logistic回归深度解析

需积分: 29 114 浏览量

更新于2024-08-04

1

收藏 1.05MB PDF 举报

"《机器学习实战》第五章Logistic回归学习笔记主要讲解了Logistic回归的概念、应用及其在实际操作中的流程。Logistic回归是一种分类算法,它通过Sigmoid函数将连续的预测值转化为0或1的概率输出,适用于处理二分类问题。笔记详细介绍了Logistic回归的过程,包括数据收集、数据准备、数据分析、训练算法、测试算法以及使用算法的步骤。此外,还探讨了Logistic回归的优缺点和适用数据类型。在确定最佳回归系数时,引入了最优化方法,特别是梯度上升法,用于寻找使模型性能最优的参数。"

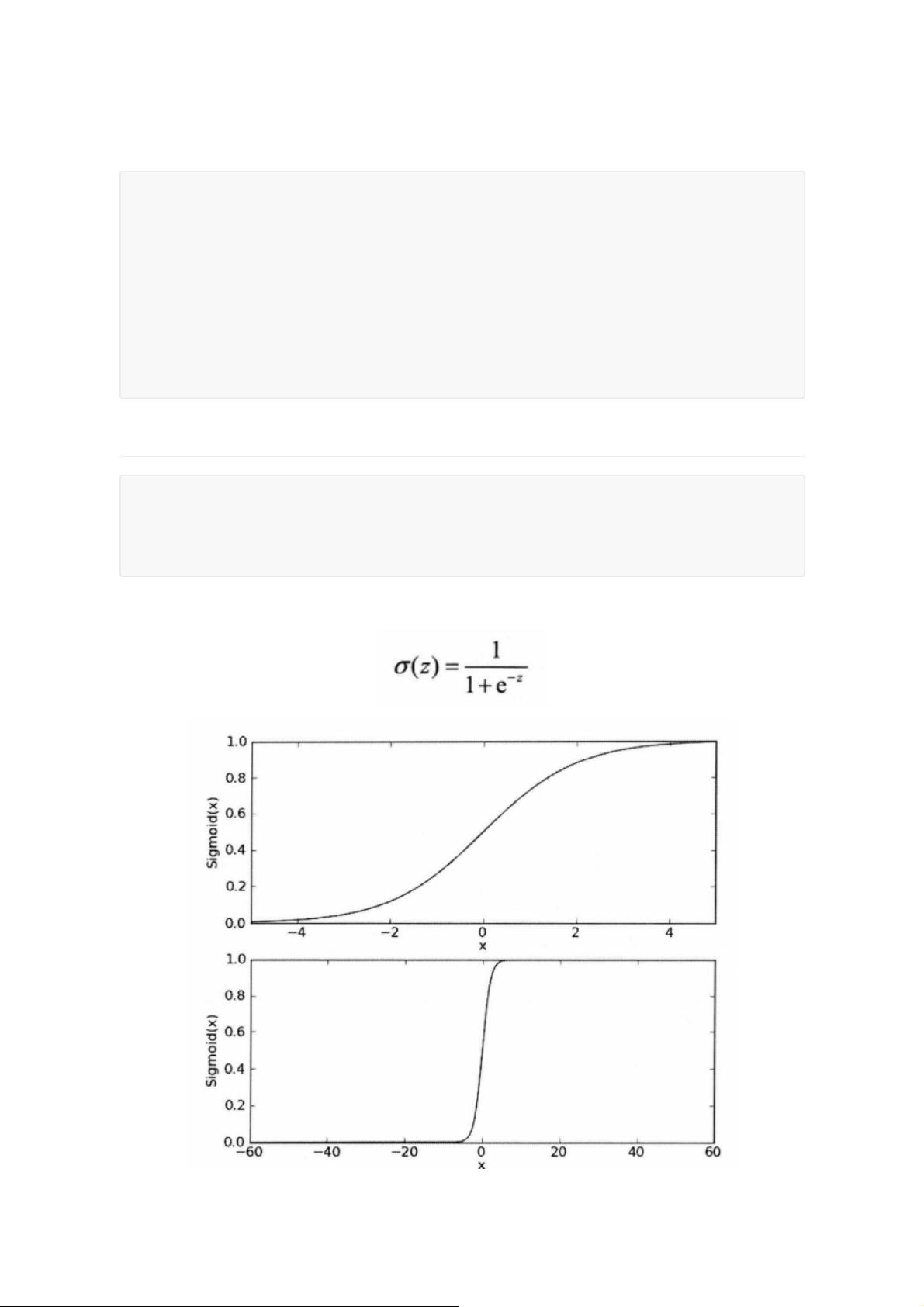

在Logistic回归中,回归并不意味着寻找最佳拟合直线,而是构建一个分类边界,使得数据点被正确分类。Sigmoid函数在此起着关键作用,它的输出范围限定在0到1之间,可以解释为正类的概率。当Sigmoid函数的输入z(特征与权重的线性组合)足够大时,输出接近1,反之接近0,从而实现分类。

训练Logistic回归模型的过程涉及以下步骤:

1. 收集数据:收集相关的数据集,用于训练模型。

2. 准备数据:将非数值型数据转换为数值型,确保数据适合进行数学计算,并且推荐使用结构化的数据格式。

3. 分析数据:对数据进行探索性分析,理解数据特性,发现潜在的关联或异常。

4. 训练算法:利用梯度上升法或其他优化算法调整权重,以找到最佳分类边界。

5. 测试算法:使用独立的数据集验证模型的性能,评估其分类准确性。

6. 使用算法:输入新数据,经过模型计算得出概率,依据阈值(通常为0.5)进行分类。

Logistic回归的优势在于其简单性和计算效率,但可能面临欠拟合问题,导致分类精度不高。它可以处理数值型和标称型数据,对于二分类问题尤为适用。在寻找最佳回归系数时,梯度上升法是一种常用方法,通过不断迭代更新参数,使损失函数(如对数似然损失)逐渐减小,从而达到优化模型的目的。

在实践中,梯度上升法会反复计算梯度,确定每次迭代的步长和方向,直至满足停止条件(如达到预设的迭代次数、梯度接近零或损失函数变化极小)。通过这种方式,Logistic回归能够找到一组权重,使得模型对训练数据的分类效果最佳,进而用于未知数据的预测。

2021-04-01 上传

2023-01-14 上传

2021-06-10 上传

2021-10-01 上传

2019-09-12 上传

Mr.狐友

- 粉丝: 581

- 资源: 3

最新资源

- 开源通讯录备份系统项目,易于复刻与扩展

- 探索NX二次开发:UF_DRF_ask_id_symbol_geometry函数详解

- Vuex使用教程:详细资料包解析与实践

- 汉印A300蓝牙打印机安卓App开发教程与资源

- kkFileView 4.4.0-beta版:Windows下的解压缩文件预览器

- ChatGPT对战Bard:一场AI的深度测评与比较

- 稳定版MySQL连接Java的驱动包MySQL Connector/J 5.1.38发布

- Zabbix监控系统离线安装包下载指南

- JavaScript Promise代码解析与应用

- 基于JAVA和SQL的离散数学题库管理系统开发与应用

- 竞赛项目申报系统:SpringBoot与Vue.js结合毕业设计

- JAVA+SQL打造离散数学题库管理系统:源代码与文档全览

- C#代码实现装箱与转换的详细解析

- 利用ChatGPT深入了解行业的快速方法论

- C语言链表操作实战解析与代码示例

- 大学生选修选课系统设计与实现:源码及数据库架构