"视觉中的Transformer-VIT模型实战"

下载需积分: 0 | DOCX格式 | 1.71MB |

更新于2024-01-25

| 136 浏览量 | 举报

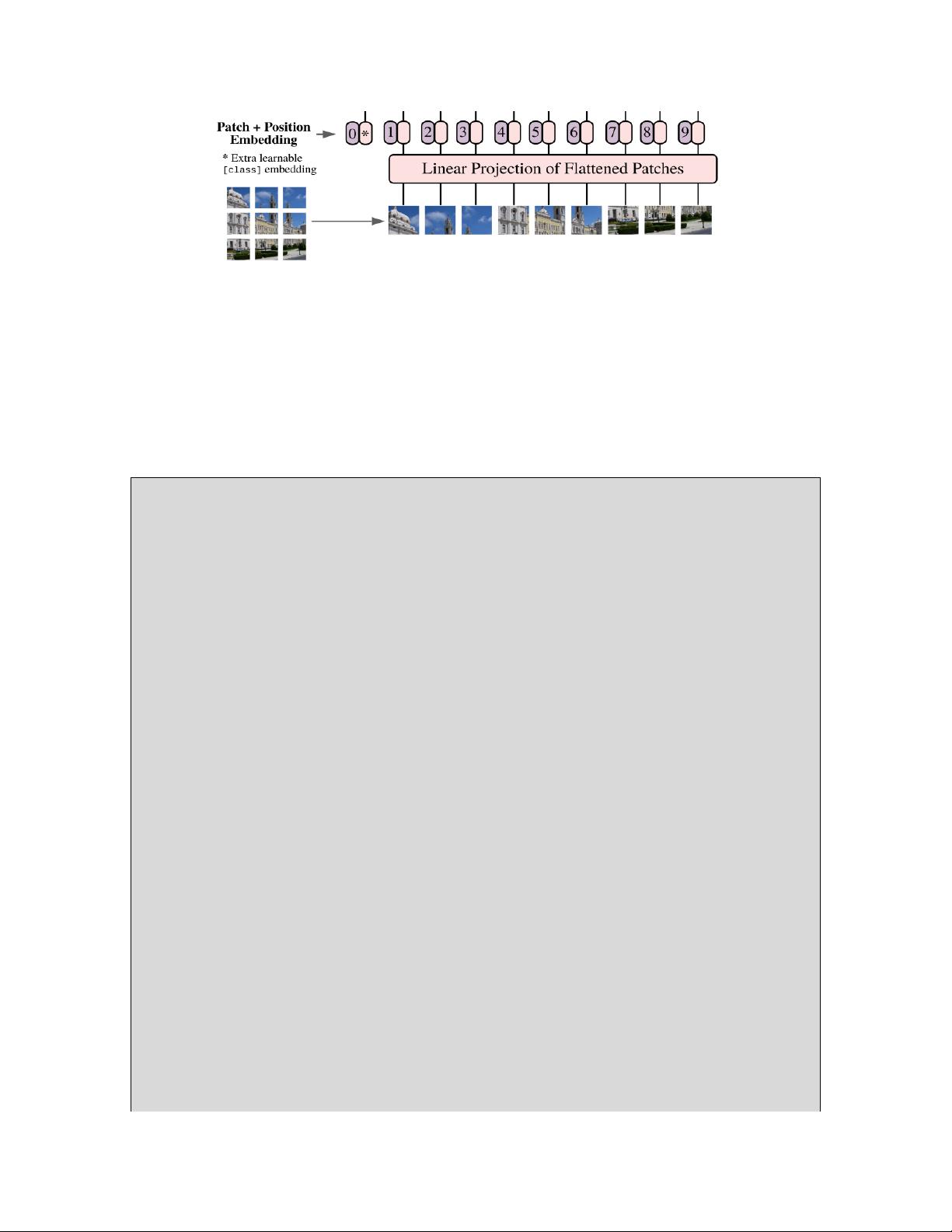

本章主要介绍了视觉中的Transformer-VIT模型实战。在过去的课程中,我们学习了Transformer结构在自然语言处理领域中的应用。Transformer最初是针对自然语言处理领域提出的,并在该领域取得了巨大成功。本章将重点介绍Transformer结构在计算机视觉领域的具体应用。Vision Transformer(VIT)可以被视为Transformer模型在图像领域的变体,它几乎没有对Transformer模型进行改动,而是直接将标准的Transformer模型迁移到图像领域,形成了Vision Transformer模型。为了使Transformer模型适用于图像,VIT将图像切分成许多子块,并将这些子块组成线性嵌入序列,然后将这些线性嵌入序列作为Transformer的输入,以模拟在自然语言处理领域中词组序列的输入。

在ViT模型介绍一节中,我们意识到以往的算法大多是保持卷积神经网络(CNN)整体结构不变,然后在CNN中增加注意力模块或者使用注意力模块替换CNN中的某些部分。然而,在ViT算法中,提出了不一定必须依赖于CNN,而仅仅使用Transformer结构也可以取得良好的效果。这种新颖的思路在计算机视觉领域引起了广泛关注和探讨。

ViT模型的核心思想是将图像数据转换成可以被Transformer结构处理的序列数据。通过将图像分成子块并组成线性嵌入序列,ViT模型可以在不引入卷积神经网络的情况下,直接将图像数据输入Transformer模型中进行处理。这种方法的引入使得在计算机视觉领域中使用Transformer模型变得更加简单和直观。

在ViT模型实战的具体实践中,我们将学习如何应用ViT模型来解决计算机视觉领域的实际问题。这包括如何对图像数据进行预处理和特征提取,以及如何构建ViT模型并进行训练与优化。通过实际的案例分析和编程实践,我们将掌握如何使用ViT模型来处理图像识别、目标检测和图像分割等任务。此外,我们还将学习如何对ViT模型进行调参和性能优化,以获得更好的模型效果和更高的精度。

总的来说,本章内容全面介绍了视觉中的Transformer-VIT模型实战,从理论基础到实际应用都进行了深入讲解。通过学习这一章内容,我们将深入了解Transformer结构在计算机视觉领域的应用原理和方法,同时也将掌握如何使用ViT模型来解决实际的图像处理问题。这对于进一步推动计算机视觉和深度学习技术的发展,具有重要的理论和实践意义。

相关推荐

2844 浏览量

868 浏览量

2024-10-20 上传

297 浏览量

121 浏览量

2024-10-21 上传

2024-10-20 上传

2024-10-18 上传

2024-10-15 上传

jzhh海天一色

- 粉丝: 10

最新资源

- jq双日历插件:日期区间选择控件

- 清新蓝色波纹商务PPT模板下载

- 数据结构实验:学生成绩管理与Huffman编码实现

- Iedis-2.591:高效的Redis数据库插件,离线安装,最低资源占用

- TDA100编程软件全新发布,四个版本全面更新

- 微信小程序点餐模板代码资源包

- 简易Windows RTMP服务器:无需虚拟机即可推流

- Python在新闻分类任务中的数据分析与机器学习应用

- 三层树状组织架构图PPT模板素材下载

- Eclipse单元测试必备Jar包资源整理

- 解决Kubernetes 1.8.1安装难题的RPM包

- MVP模式实践教程:一个简易小demo分析

- QCExplorerAddIn9.0: 专用浏览器助力问题快速定位

- 深度学习:训练GoogLeNet Inception V1和V3模型

- Java Swing图书管理系统实验项目概述

- 百度语音识别与合成技术演示详解