人工智能系统与深度学习基础:从概览到深度神经网络

版权申诉

117 浏览量

更新于2024-07-07

收藏 4.89MB PDF 举报

"该资源是关于人工智能专题的课程资料,主要涵盖了人工智能系统概览和深度网络基础的内容。课程包括了从人工智能系统的历史视角、深度神经网络的基础理论到实际的计算框架、计算机体系结构、分布式训练算法和系统、异构计算集群的调度管理,以及深度学习的推断系统和计算图编译优化等多个方面。"

本文将详细阐述这些关键知识点,旨在提供一个全面的人工智能系统和深度学习的理解。

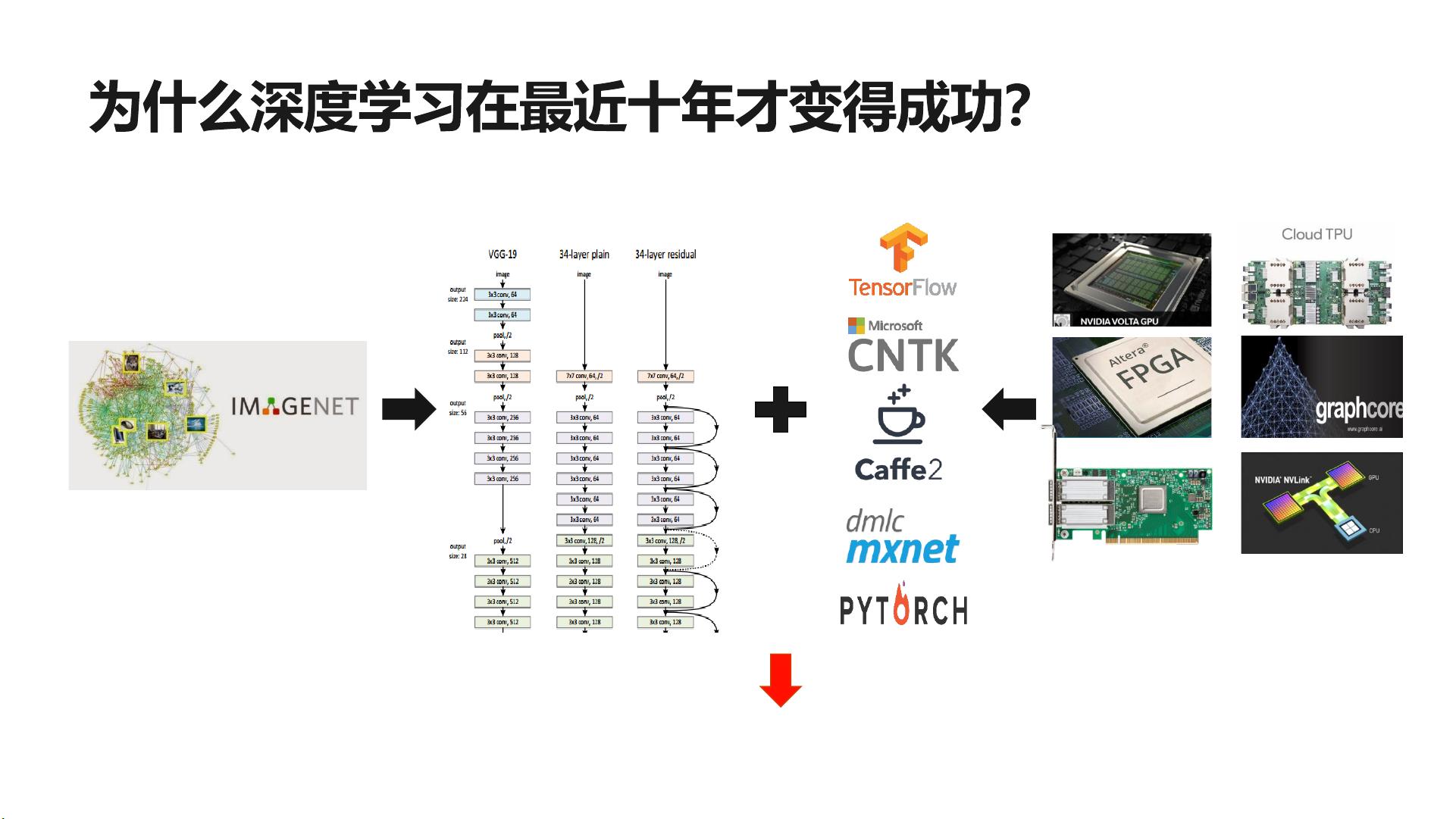

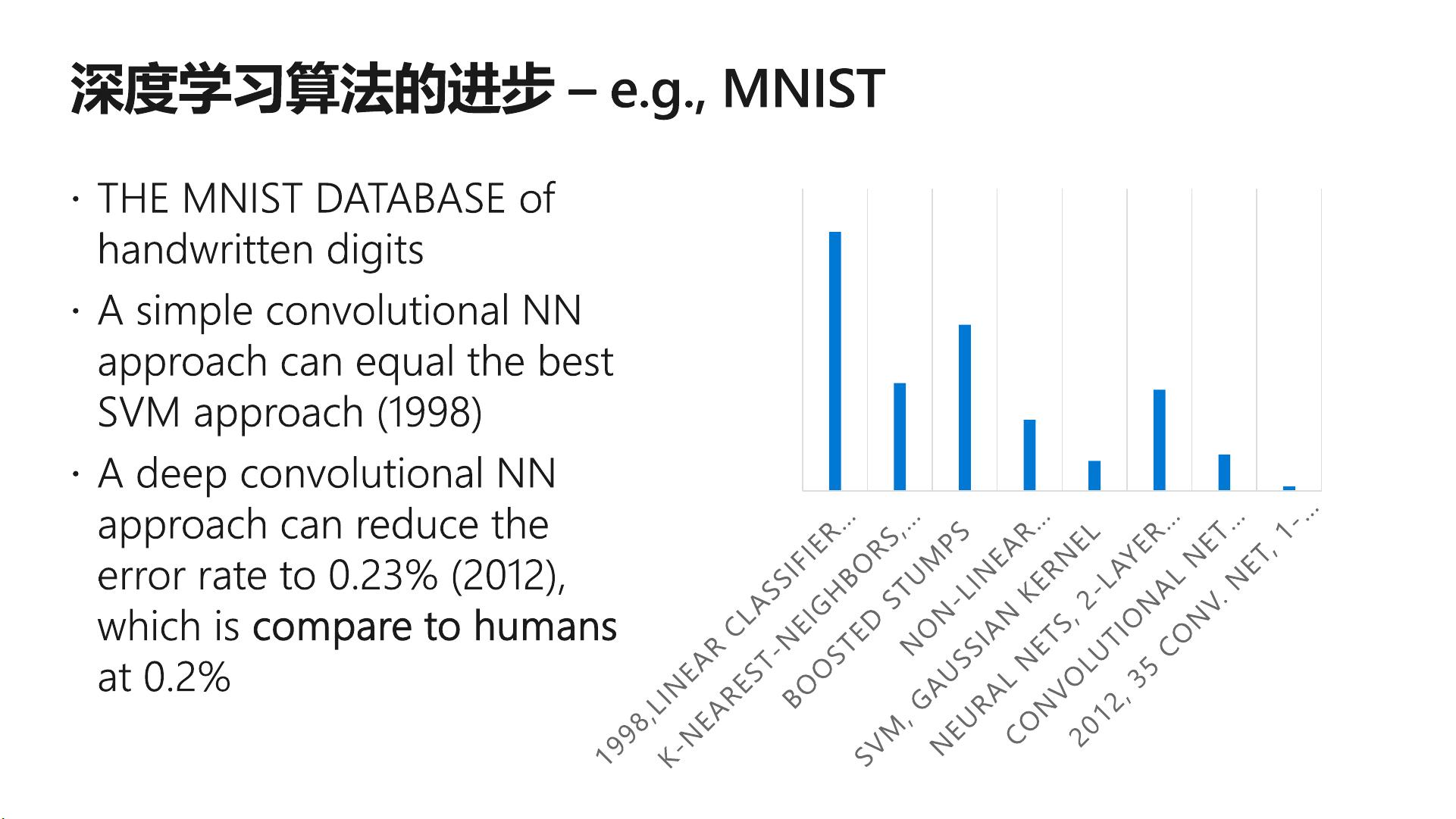

首先,人工智能系统概述部分,讲解了人工智能的历史发展,强调了系统层面的理解对于AI的重要性。同时,它深入探讨了神经网络的基本原理,这是现代深度学习的基础。这一部分也涵盖了人工智能系统的基本概念,为后续的学习奠定了基础。

接着,深度神经网络计算框架基础介绍了如何实现和优化深度学习模型。内容涉及到反向传播、自动微分、张量操作、有向无环图(DAG)以及执行图等核心概念,并提到了PyTorch和TensorFlow等主流框架,这些都是构建和训练深度网络的必备工具。

在矩阵运算与计算机体系结构章节,讨论了在CPU、SIMD、GPGPU以及ASIC/TPU等不同硬件平台上进行矩阵计算的效率和优化策略。Blas库和TPU等技术的应用也在此部分有所提及。

分布式训练算法和系统是大型AI项目的关键。数据并行和模型并行的方法、分布式随机梯度下降等算法,以及MPI、参数服务器、全reduce和RDMA等技术,都在这个部分进行了深入解析。此外,还提到了如Horovod这样的分布式训练平台。

异构计算集群调度与资源管理系统部分,讲解了如何在集群上高效运行深度学习任务,包括容器化、资源分配和调度策略,如KubeFlow、OpenPAI、Gandiva和HiveD等系统的应用。

深度学习推断系统则关注模型部署的效率、延迟、吞吐量等问题,这是将训练好的模型应用到实际场景中必不可少的知识。

最后,计算图编译优化环节,讲解了中间表示(IR)、子图模式匹配、矩阵乘法和内存优化等技术,这些都是提高模型推理性能的关键。

这些内容构成了一个完整的人工智能系统和深度学习的学习路径,不仅覆盖了理论基础,还包括了实际应用中的关键技术和系统设计。对于想要深入理解和掌握AI技术的人来说,这是一个宝贵的资源。

197 浏览量

117 浏览量

点击了解资源详情

203 浏览量

2021-04-08 上传

2023-06-05 上传

2024-05-24 上传

2021-04-08 上传

2021-04-08 上传

mugui3

- 粉丝: 0

最新资源

- Cisco Catalyst 2950/2955交换机配置指南

- 深入理解Apache Velocity

- Oracle JDeveloper 中的 Ajax 技术应用

- eBox-2300 Windows CE 6.0 开发指南:从零开始到实战应用

- C语言面试经典题解析:数据结构与算法实战

- 电脑发展史:从起源到新时代

- C/C++面试经典问题与技巧解析

- Oracle数据库函数详解

- IBM GPFS:高性能并行文件系统

- Progete教程:进阶操作与OWL数据库

- Protege新手入门:创建简单动物本体与基础用法教程

- 嵌入式开发:安全C/C++编码策略与实践

- 千万别用传统方式学英语:独特学习法揭秘

- 提升C语言上机调试效率的关键技巧

- 网上论坛BBS系统设计与功能详解

- SQL Server 2000:数据库开发与操作实践