向前-向后算法(forward-backward algorithm)是一种用于隐马尔可夫模型的学习问题的经典算法。在隐马尔可夫模型中,已知隐藏状态的集合S,观察值的集合O,以及一个观察序列(o1, o2,..., on),需要求得使得该观察序列出现的可能性最大的模型参数,包括初始状态概率矩阵π,状态转移矩阵A,发射矩阵B。

这个问题正是EM算法要解决的问题。EM算法是一种迭代算法,用于通过最大化似然函数来估计模型参数,同时考虑到有无隐含变量的情况。在隐马尔可夫模型中,如果每个观察值的隐藏状态是已知的,那么可以直接用最大似然估计法求解模型参数,而不需要使用EM算法。但是当隐藏变量未知时,就需要用EM算法来迭代求解最佳参数θ*。

在中文词性标注中,我们可以根据训练语料观察到一系列的词汇(对应EM中的X),如果每个词的词性(即隐藏状态)也是已知的,就不需要用EM算法来求解模型参数θ了。因为此时隐藏变量Y是已知的,不存在隐含变量了。因此,可以直接使用最大似然估计法来求解模型参数。

要理解向前-向后算法,首先需要承认以下公式表示:对于互相独立的事件,P(A, B) = P(B|A) * P(A),P(A,B,C) = P(C) * P(A,B|C) = P(A,C|B) * P(B) = P(B,C|A) * P(A)。

向前-向后算法实质上是一种动态规划算法。它通过在观察序列中的每一个位置,计算当前位置处于每个状态的概率,以及从当前状态转移到下一个状态的概率,然后在整个观察序列上一步一步地向前和向后传递这些概率,以便最终计算出整个观察序列出现的概率。

具体步骤如下:

1. 初始化:计算初始时刻处于每个状态的概率,即前向传递过程中的向前概率。

2. 前向传递:根据观察序列,计算在每一个时刻处于每个状态的向前概率。

3. 后向传递:根据观察序列,计算在每一个时刻处于每个状态的向后概率。

4. 结合前向概率和后向概率,计算在每一个时刻处于每个状态的概率。

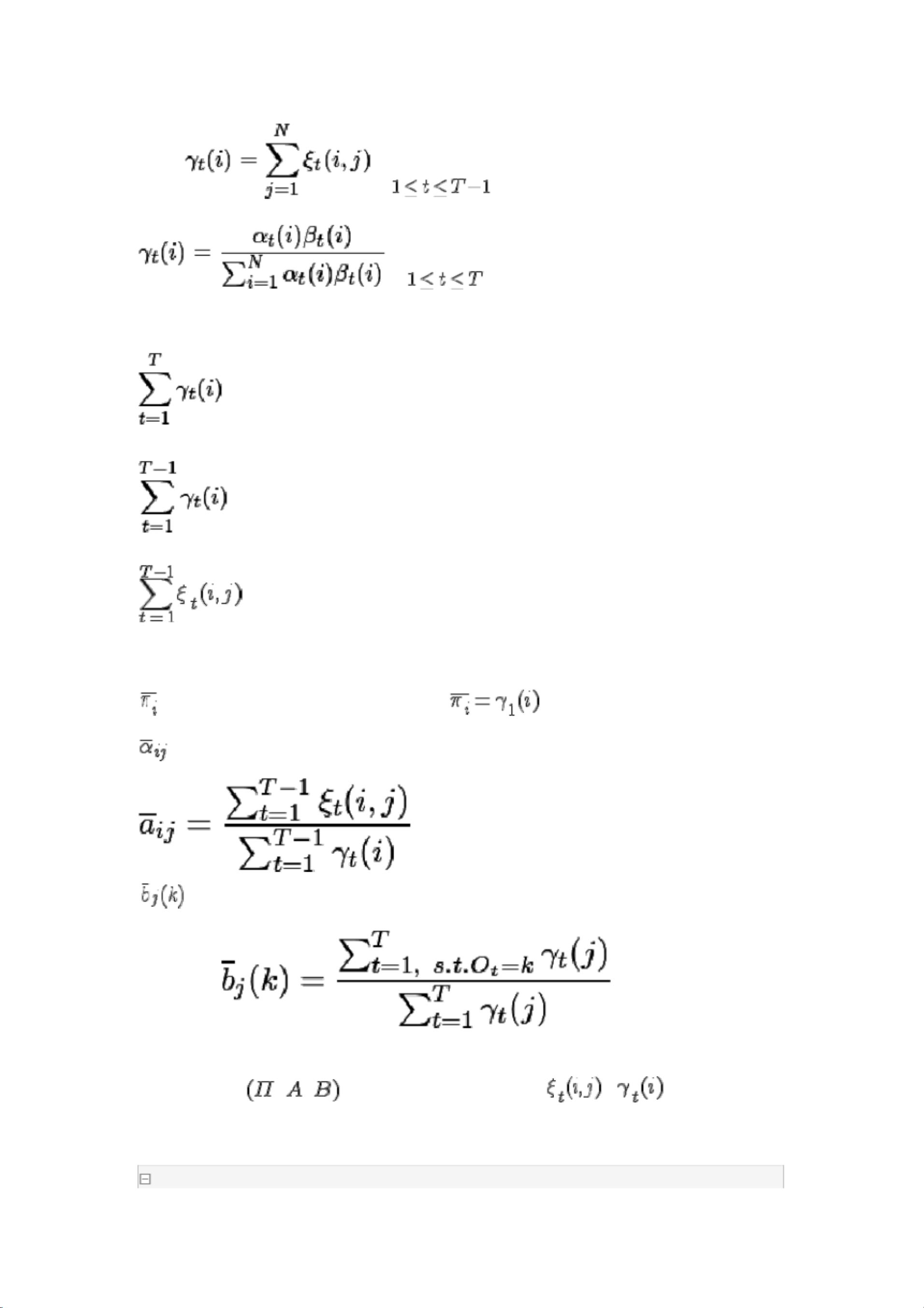

5. 根据状态转移概率和发射概率,更新模型参数。

通过这种方式,可以在不知道隐藏变量Y的情况下,通过观察序列的数据来估计出最优模型参数,从而提高隐马尔可夫模型的预测性能。

总而言之,向前-向后算法是一种重要的用于解决隐马尔可夫模型学习问题的算法,通过动态规划的方法,在不知道隐藏变量Y的情况下,求解最优的模型参数,从而提高模型的预测准确性。EM算法和最大似然估计法在隐马尔可夫模型中起到了关键作用,帮助我们更好地理解和应用隐马尔可夫模型。