MLP-3D网络:无卷积的视频识别新方法

128 浏览量

更新于2024-06-20

收藏 970KB PDF 举报

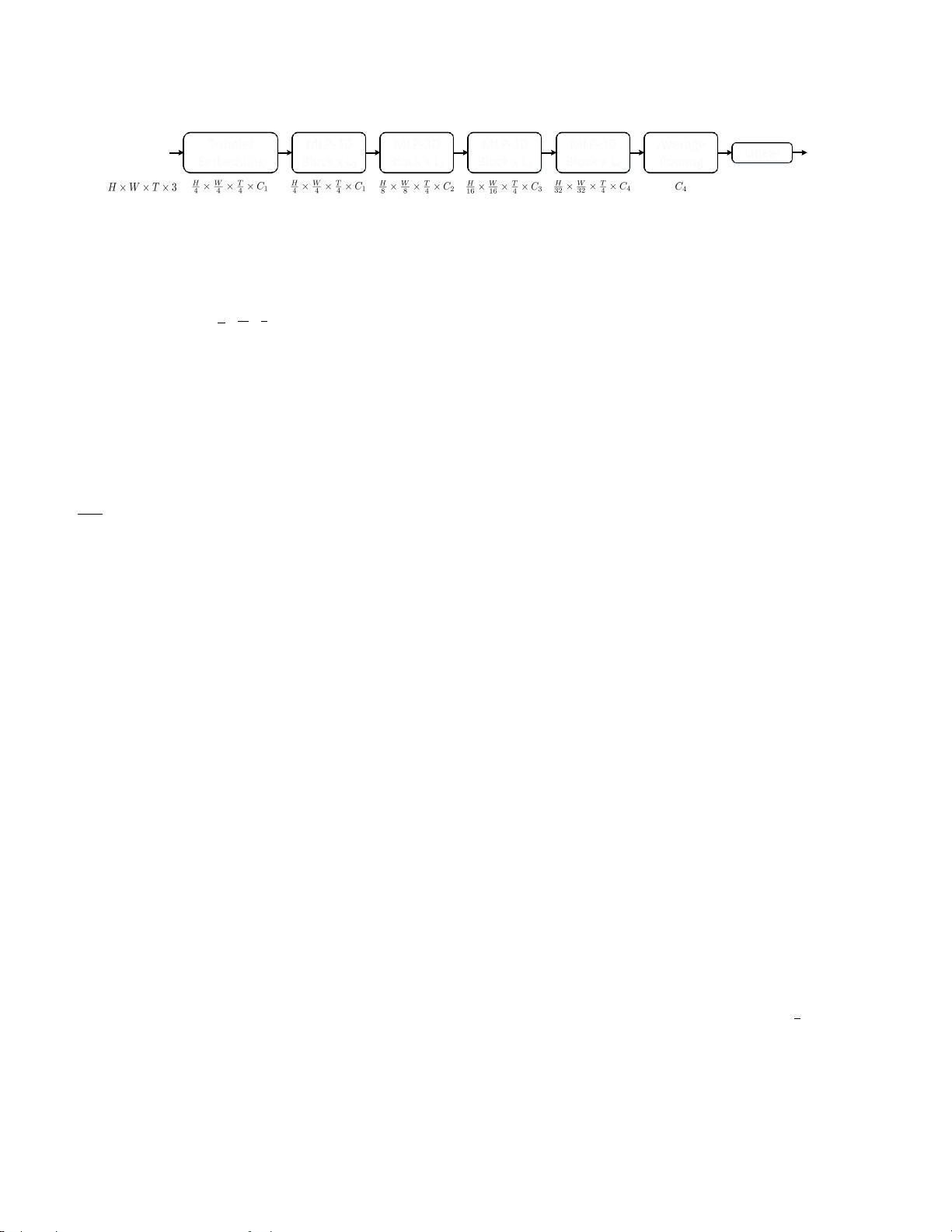

"本文介绍了一种名为MLP-3D的新型三维视频识别网络,它采用了无卷积的多层感知器(MLP)结构,旨在处理视频数据的复杂性和变化性。MLP-3D网络由MLP-3D块构成,每个块包括令牌混合MLP和信道MLP,通过引入分组时间混合(GTM)操作来增强时间序列的建模能力。GTM将输入令牌按时间分组,并用共享投影矩阵进行线性映射。研究者设计了不同分组策略的GTM变体,并通过结构搜索将它们集成到MLP-3D网络的不同块中。尽管计算效率较高,但该网络在Something-SomethingV2和Kinetics-400数据集上的性能与广泛采用的3DCNN和视频变压器相当,实现了68.5%和81.4%的top-1准确率。"

在计算机视觉领域,卷积神经网络(CNN)长期被视为图像和视频识别的主流模型,因其在多个任务上的优异表现以及硬件优化的实现。然而,随着注意力模型在自然语言处理中的成功,视觉转换器(如Transformer)也开始在视觉领域受到关注。MLP-3D网络则是结合了这两种思想,特别是在处理视频数据时,它试图克服CNN和Transformer的局限性。

MLP-3D网络的设计灵感来源于MLP混合器层,但进行了改进,将其分解为沿高度、宽度和时间三个维度的子模块。核心创新在于令牌混合MLP的改进,通过GTM操作,它能够捕捉到视频数据的时间动态。GTM不仅分组了输入令牌,还引入了线性投影,使得每个时间组内的令牌可以进行交互,从而增强网络对时间序列的理解。

为了进一步优化网络性能,研究者探索了多种GTM的分组策略,并利用贪婪结构搜索方法来确定最佳组合,将这些变体整合到MLP-3D的不同块中。这使得网络能够在保持高效计算的同时,仍然能够有效地学习和捕获视频数据的时空特征。

实验结果显示,MLP-3D网络在Something-SomethingV2和Kinetics-400这两个标准视频识别数据集上取得了与当前最先进的3DCNN和Transformer相当的性能。这表明,即使没有依赖传统的卷积或注意力机制,MLP-3D网络也能有效处理视频识别任务,为视频理解和分析提供了新的视角和可能。

2020-06-11 上传

2021-05-25 上传

2024-06-18 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- Angular实现MarcHayek简历展示应用教程

- Crossbow Spot最新更新 - 获取Chrome扩展新闻

- 量子管道网络优化与Python实现

- Debian系统中APT缓存维护工具的使用方法与实践

- Python模块AccessControl的Windows64位安装文件介绍

- 掌握最新*** Fisher资讯,使用Google Chrome扩展

- Ember应用程序开发流程与环境配置指南

- EZPCOpenSDK_v5.1.2_build***版本更新详情

- Postcode-Finder:利用JavaScript和Google Geocode API实现

- AWS商业交易监控器:航线行为分析与营销策略制定

- AccessControl-4.0b6压缩包详细使用教程

- Python编程实践与技巧汇总

- 使用Sikuli和Python打造颜色求解器项目

- .Net基础视频教程:掌握GDI绘图技术

- 深入理解数据结构与JavaScript实践项目

- 双子座在线裁判系统:提高编程竞赛效率