BP算法与神经元模型:深度解析多层网络的学习机制

需积分: 0 150 浏览量

更新于2024-08-05

收藏 1.42MB PDF 举报

第五章 神经网络深入探讨了神经元模型和多层网络结构在人工智能中的核心作用。章节首先介绍了M-P神经元模型,这是神经网络的基础组成部分。在这个模型中,神经元接收来自其他神经元的加权输入信号,通过激活函数进行处理,产生输出。激活函数如阶跃函数和Sigmoid函数是关键组件,阶跃函数虽然直观,但由于其不连续性,实际应用中通常采用Sigmoid函数,它将输入值压缩到(0,1)的连续区间,便于数值计算。

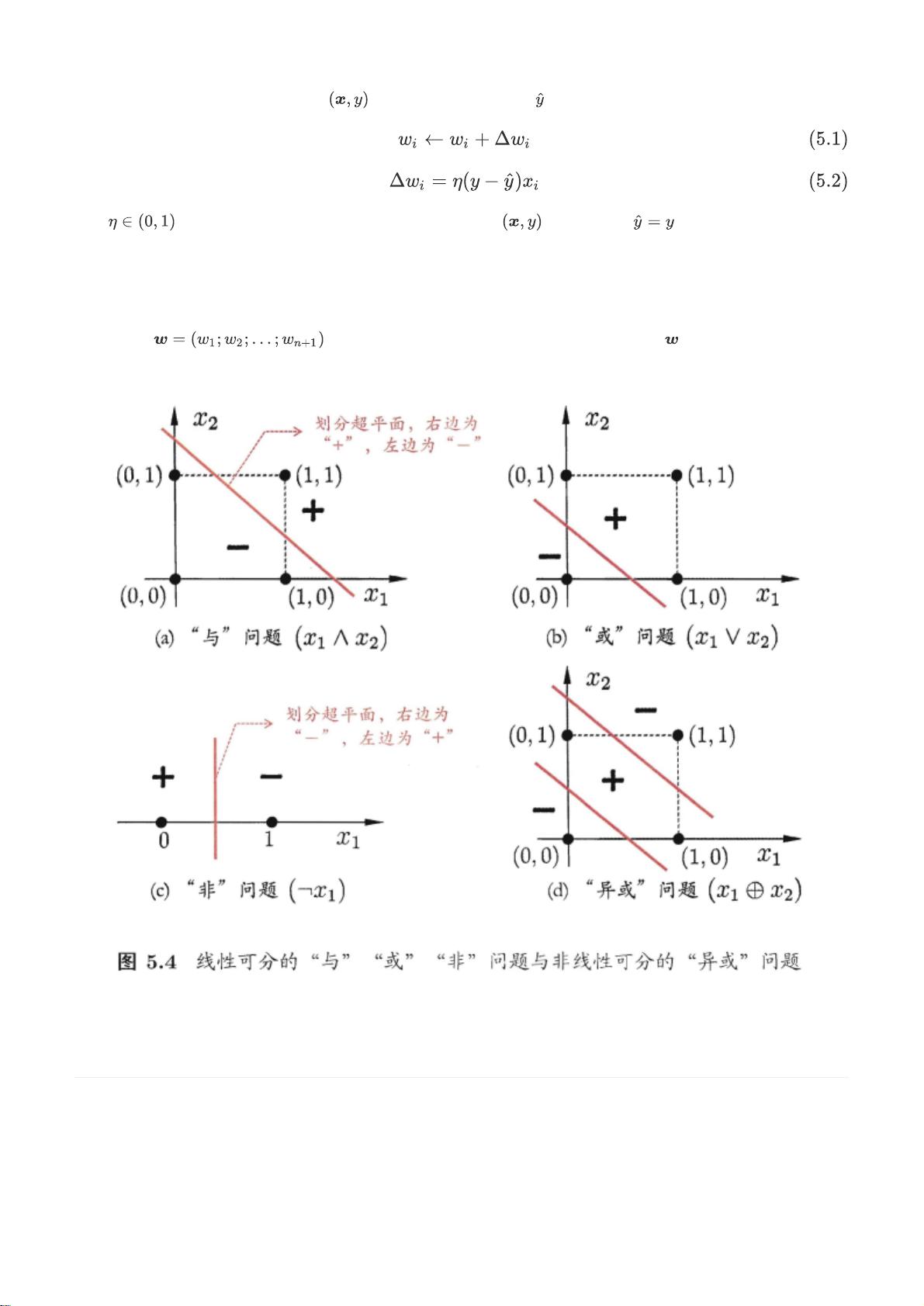

感知机是神经网络的一个简单版本,由输入层和输出层构成,输出层通常是M-P神经元,负责二分类任务。学习规则基于梯度下降策略,即根据训练样本的预测误差调整权重,学习率决定了调整的步长。感知机的学习效果受限于问题的线性可分性:如果数据可以被一个线性超平面完美划分,感知机能够收敛;否则,对于非线性可分的问题,就需要引入多层网络,如多层感知机。

多层网络,特别是多层前馈神经网络,如图5.6所示,是解决复杂问题的关键。在这些网络中,隐藏层的存在使得网络可以学习到非线性的表示,比如在图5.5中的两层感知机,通过添加一个隐藏层可以解决异或问题,这表明隐藏层的引入是扩展神经网络处理能力的关键。在多层网络中,每一层的神经元都通过激活函数处理输入,形成逐层抽象和特征提取的过程。

总结来说,本章内容涵盖了神经元模型的细节、激活函数的作用,以及从感知机到多层网络的进化,强调了层次结构和非线性表示在解决复杂问题中的重要性。理解这些基本概念是深入学习神经网络和深度学习的基础。

2021-09-21 上传

2010-12-19 上传

2023-09-29 上传

2023-06-22 上传

2024-05-16 上传

2023-09-07 上传

2023-03-27 上传

2023-07-27 上传

明儿去打球

- 粉丝: 17

- 资源: 327

最新资源

- ES管理利器:ES Head工具详解

- Layui前端UI框架压缩包:轻量级的Web界面构建利器

- WPF 字体布局问题解决方法与应用案例

- 响应式网页布局教程:CSS实现全平台适配

- Windows平台Elasticsearch 8.10.2版发布

- ICEY开源小程序:定时显示极限值提醒

- MATLAB条形图绘制指南:从入门到进阶技巧全解析

- WPF实现任务管理器进程分组逻辑教程解析

- C#编程实现显卡硬件信息的获取方法

- 前端世界核心-HTML+CSS+JS团队服务网页模板开发

- 精选SQL面试题大汇总

- Nacos Server 1.2.1在Linux系统的安装包介绍

- 易语言MySQL支持库3.0#0版全新升级与使用指南

- 快乐足球响应式网页模板:前端开发全技能秘籍

- OpenEuler4.19内核发布:国产操作系统的里程碑

- Boyue Zheng的LeetCode Python解答集