"GPU在超大规模深度学习中的发展与应用——深度学习从研究到生产的转折点"

需积分: 5 198 浏览量

更新于2024-01-20

收藏 6.02MB PDF 举报

和TRAINING的转变• 历史转折点 :GPU的出现和应用• GPU在深度学习中的优势• GPU在超大规模深度学习中的应用• GPU的未来发展前景深度学习是人工智能领域的热门技术,已经在许多领域取得了重大突破,如图像识别、语音识别和自然语言处理。然而,深度学习的发展并非一帆风顺,经历了从研究到生产的转变过程。本文将重点介绍GPU在超大规模深度学习中的发展和应用。

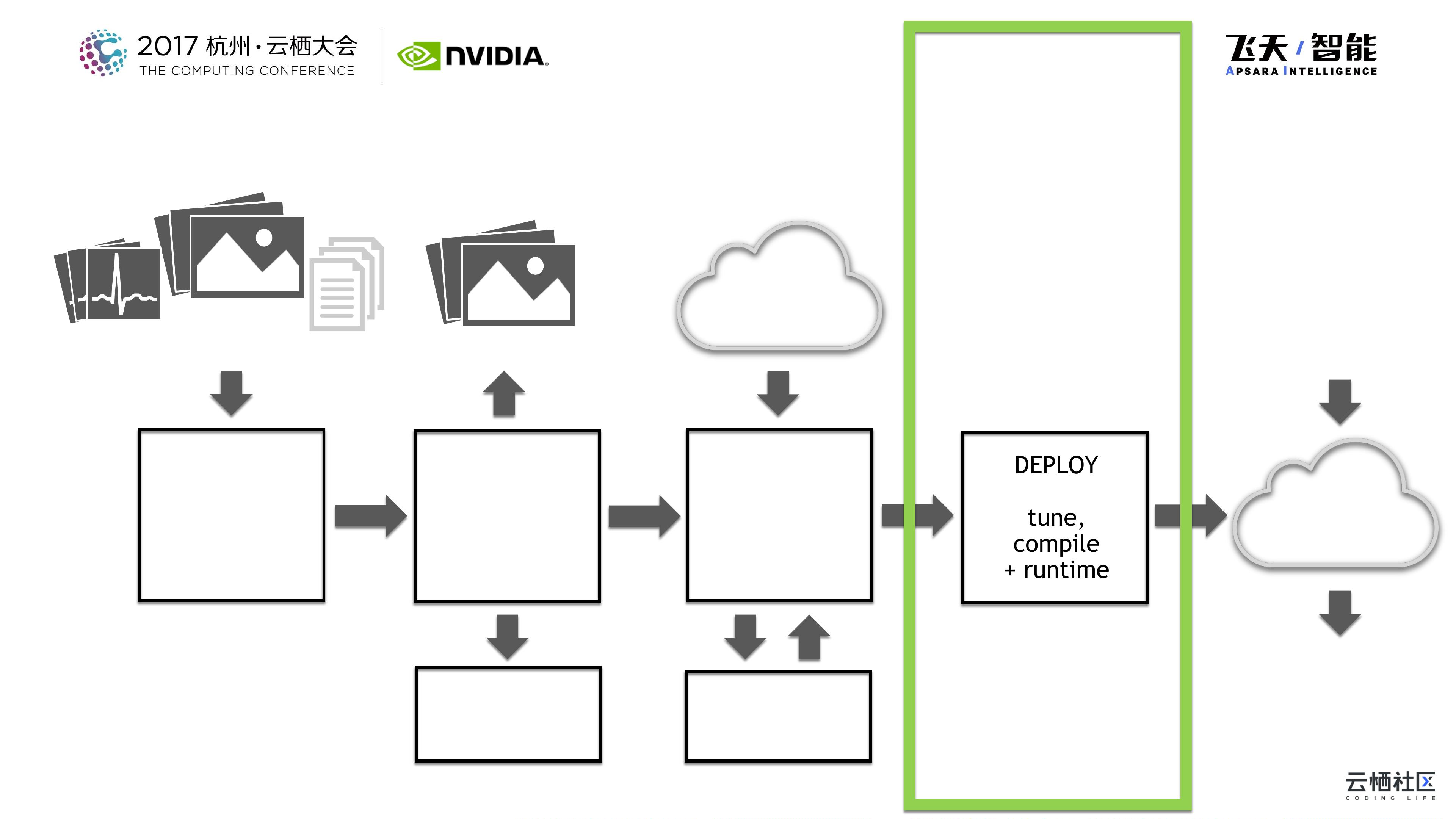

深度学习从研究到生产的转变,主要体现在训练和推断两个阶段。在训练阶段,模型需要通过大量的数据进行训练,以得到准确的参数。在推断阶段,训练好的模型将应用于实际场景中,对新的数据进行预测和分类。这两个阶段都需要大量的计算资源和时间。

在过去,深度学习研究主要依赖于CPU进行计算,但受限于CPU的计算能力,深度学习的训练和推断都面临着很大的挑战。然而,GPU的出现和应用改变了这一局面。GPU(Graphics Processing Unit)最初是用于加速图形渲染的硬件,但其并行计算能力被发现可以很好地应用于深度学习。

与CPU相比,GPU具有以下几个优势。首先,GPU拥有更多的计算核心和内存,可以支持更多的并行计算任务。其次,GPU具有更高的内存带宽和缓存带宽,可以更快地从存储器中读取和写入数据。最后,GPU的价格更加适中,性能价格比更高。

基于这些优势,GPU在深度学习中得到了广泛的应用。首先,GPU的并行计算能力可以加速深度学习的训练过程。传统的深度学习模型需要大量的计算资源和时间来进行训练,而GPU可以并行地计算多个样本的梯度,从而加速训练过程。此外,GPU还支持深度学习框架的加速,如TensorFlow和PyTorch。

其次,GPU在深度学习的推断过程中也发挥了重要作用。深度学习模型在实际应用中需要对新的数据进行实时的预测和分类,而GPU的高性能计算能力可以提供快速的推断速度。这对于实时的图像识别、语音识别和自然语言处理等应用非常重要。

在超大规模深度学习中,GPU的应用更加突出。超大规模深度学习需要处理大规模的数据和模型,对计算资源的需求更高。GPU的并行计算能力和高内存带宽使其成为处理超大规模深度学习的理想选择。此外,GPU也支持分布式深度学习的应用,可以将多个GPU连接在一起,形成一个GPU集群,进行并行计算。

值得注意的是,GPU在超大规模深度学习中的应用并不仅限于训练和推断。GPU还可以用于数据预处理、模型调优和可视化等任务。这些任务都需要大量的计算资源和时间,而GPU可以提供高性能的计算能力和高效的计算速度,从而加速整个深度学习的工作流程。

与此同时,GPU在深度学习领域的发展还面临着一些挑战和问题。首先,GPU的内存容量有限,随着深度学习模型的不断增大,GPU内存容量不足的问题会逐渐凸显。其次,GPU的能耗较高,需要消耗大量的电能。为此,一些新的技术和方法正在研究中,如低能耗的GPU设计和能耗管理技术。

总的来说,GPU在超大规模深度学习中发挥着不可替代的作用。GPU的出现和应用为深度学习的研究和应用带来了重大转变,加速了深度学习的训练和推断过程,提高了深度学习的效果和效率。随着技术的不断进步和创新,GPU在深度学习中的应用前景将更加广阔。

2023-08-28 上传

2023-09-09 上传

2023-08-27 上传

2023-05-10 上传

2023-06-08 上传

2023-06-08 上传

2023-04-05 上传

2023-09-01 上传

2023-09-10 上传

weixin_40191861_zj

- 粉丝: 83

- 资源: 1万+

最新资源

- WPF渲染层字符绘制原理探究及源代码解析

- 海康精简版监控软件:iVMS4200Lite版发布

- 自动化脚本在lspci-TV的应用介绍

- Chrome 81版本稳定版及匹配的chromedriver下载

- 深入解析Python推荐引擎与自然语言处理

- MATLAB数学建模算法程序包及案例数据

- Springboot人力资源管理系统:设计与功能

- STM32F4系列微控制器开发全面参考指南

- Python实现人脸识别的机器学习流程

- 基于STM32F103C8T6的HLW8032电量采集与解析方案

- Node.js高效MySQL驱动程序:mysqljs/mysql特性和配置

- 基于Python和大数据技术的电影推荐系统设计与实现

- 为ripro主题添加Live2D看板娘的后端资源教程

- 2022版PowerToys Everything插件升级,稳定运行无报错

- Map简易斗地主游戏实现方法介绍

- SJTU ICS Lab6 实验报告解析