深度学习入门:卷积神经网络基础与特征提取

需积分: 0 23 浏览量

更新于2024-08-05

收藏 5.08MB DOCX 举报

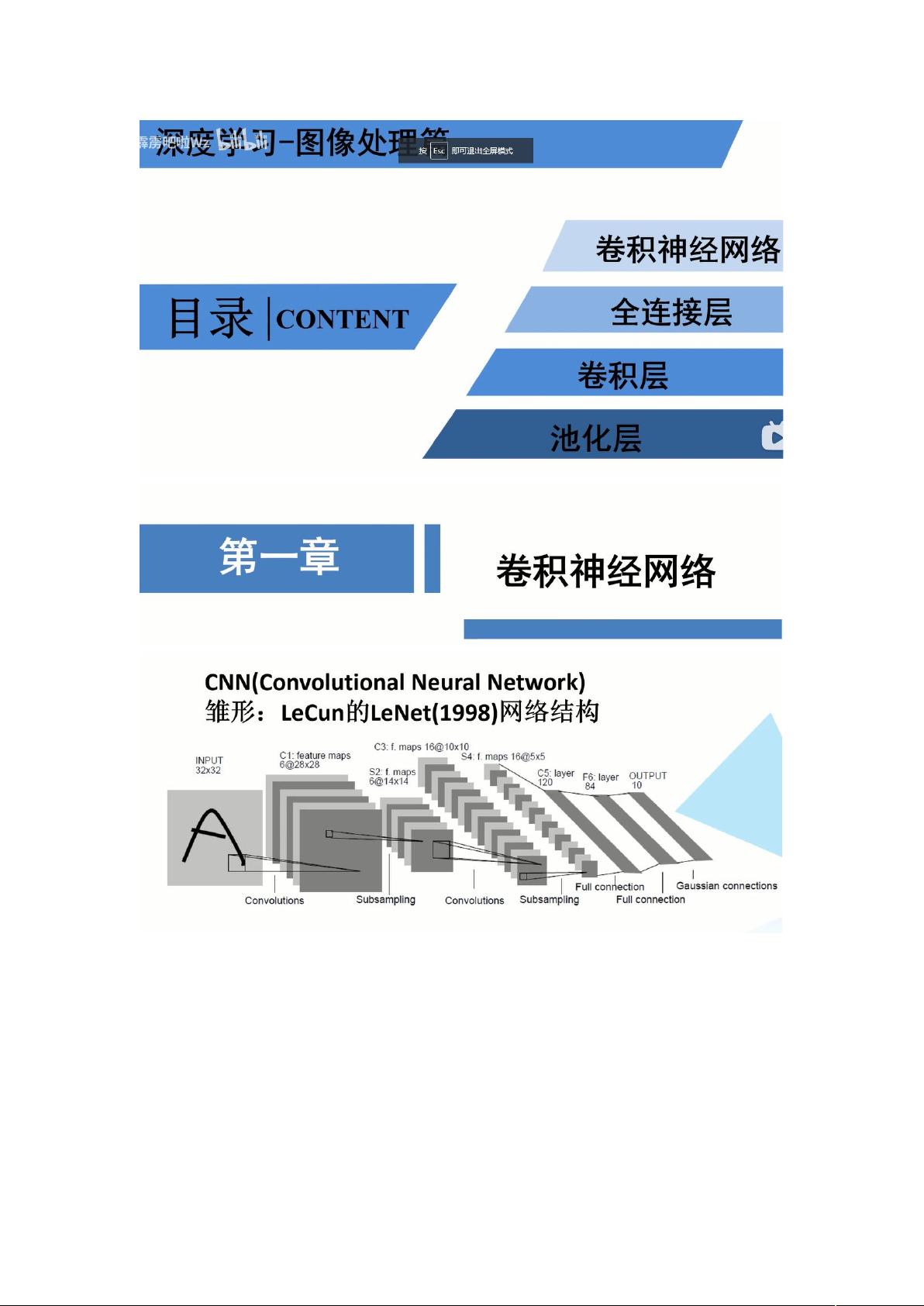

深度学习0基础的卷积神经网络(CNN)详解

卷积神经网络(Convolutional Neural Networks, CNN)是一种专为处理图像和视频数据而设计的深度学习模型。其核心结构主要包括卷积层(Convolution Layer)、下采样层(Subsampling Layer)和全连接层(Fullconnection Layer),这些组件共同构成了CNN的基础架构。

1. **卷积层** (Convolutions): 卷积层是CNN的核心部分,它通过移动大小固定的滤波器(或称卷积核)在输入图像上进行“滑动窗口”式的特征检测。滤波器中的权重参数(W)与输入特征图(X)中的像素值进行逐元素相乘(称为内积),然后加上一个偏置项,最终通过激活函数(如ReLU、Sigmoid等)非线性转换,得到新的特征图。卷积层的局部感知机制使得网络能够关注图像局部特征,而权值共享则减少了参数数量,提高了模型的计算效率。

2. **下采样层** (Subsampling Layer): 下采样层通常包括池化(Pooling)操作,如最大池化(Max Pooling)或平均池化(Average Pooling),用于减小特征图的空间尺寸,提高模型的不变性和鲁棒性,同时减少计算负担。常见的池化操作是采用固定大小的窗口(如2*2)在特征图上移动并取最大或平均值。

3. **全连接层** (Fullconnection Layer): 在卷积层和下采样层之后,经过多次特征提取,数据可能会被展平成一维向量,然后通过全连接层进行分类或回归任务。全连接层将所有神经元与前一层的所有神经元相连,形成密集连接,这种结构适用于捕捉全局信息。

4. **图像预处理**: 在输入卷积神经网络之前,彩色RGB图像通常会被处理成灰度图,通过降低颜色维度简化特征表示。例如,通过灰度化和二次型化处理,将图像转为单通道黑白图像,便于后续卷积操作。

5. **卷积计算示例**: 以3*3卷积核为例,步距为1,意味着滤波器每次移动一个像素。在每个位置,滤波器与特征图的对应区域相乘求和,生成一个新的特征值,直至遍历整个图像。这一过程不断重复,最终形成新的特征图。

6. **one-hot编码**: 输出层常采用one-hot编码来表示分类标签,如0-9的数字分类,每个类别对应一个长度为10的一维向量,其中只有一个位置为1,其余为0,这有助于避免混淆并确保标签的独特性。

7. **卷积的多维度应用**: 对于多通道(如RGB图像)的输入,卷积核也需要匹配相同的深度(channel),即针对每个通道进行独立卷积。通过滑动卷积核并在每个维度上求和,最终得到的是一组三维特征映射。

8. **权重和偏置**: 卷积核的偏移量决定了在特征图上的初始位置,不同偏移量会产生不同的输出。例如,如图所示,卷积核1的偏移量-1会导致输出矩阵特定位置为0。

9. **激活函数**: 常见的激活函数如ReLU(Rectified Linear Unit)引入非线性,使得网络能够学习更复杂的函数关系。

10. **总结**: 卷积神经网络的基础概念包括卷积操作、下采样、全连接层,以及图像预处理和激活函数的选择。这些组件相互配合,使得CNN能够在图像识别、物体检测等领域发挥强大的特征提取和分类能力。理解并掌握这些概念对于深入学习深度学习至关重要。

2022-11-18 上传

2021-10-01 上传

2021-10-14 上传

2021-04-30 上传

2021-10-28 上传

2022-06-03 上传

2021-09-18 上传

2021-10-14 上传

悬崖不勒马的是王

- 粉丝: 0

- 资源: 1

最新资源

- java记事本代码-你可以自己做的跟windows 一样

- Excel、Exchange 和 C#

- ubuntu8.04速成手册1.0.pdf ubuntu速成手册

- C99.pdf C99-国际C标准 标准C C资料 C教程

- AT&T汇编文档 linux下的汇编 linux汇编

- Introduce Android OHA.

- Zend_Db.pdf

- MMI Platform Source Code Training.pdf

- Linux必学的重要命令教程.pdf

- Ubuntu Linux实用学习教程.pdf

- Weblogic JDBC 数据源配置和详细参数说明

- 数据结构课程设计——八皇后问题

- 广域保护(稳控)技术国际现状及展望

- 轻松学习设计模式需要的快来下吧,简单易懂,场景恰当,思路清晰

- struts2指南struts2指南

- myeclipse快捷键大全.doc