Apache Kylin入门指南:分布式分析引擎和OLAP解决方案

需积分: 0 149 浏览量

更新于2024-06-30

收藏 1.99MB PDF 举报

"Kylin入门学习资料1"

Kylin是一个开源的分布式分析引擎,提供Apache Hadoop之上的SQL查询接口及多维分析(OLAP)能力,以支持超大规模数据。Kylin的本质是拿空间换时间,通过预计算把用户需要查询的维度以及他们所对应的考量的值,存储在多维空间里。

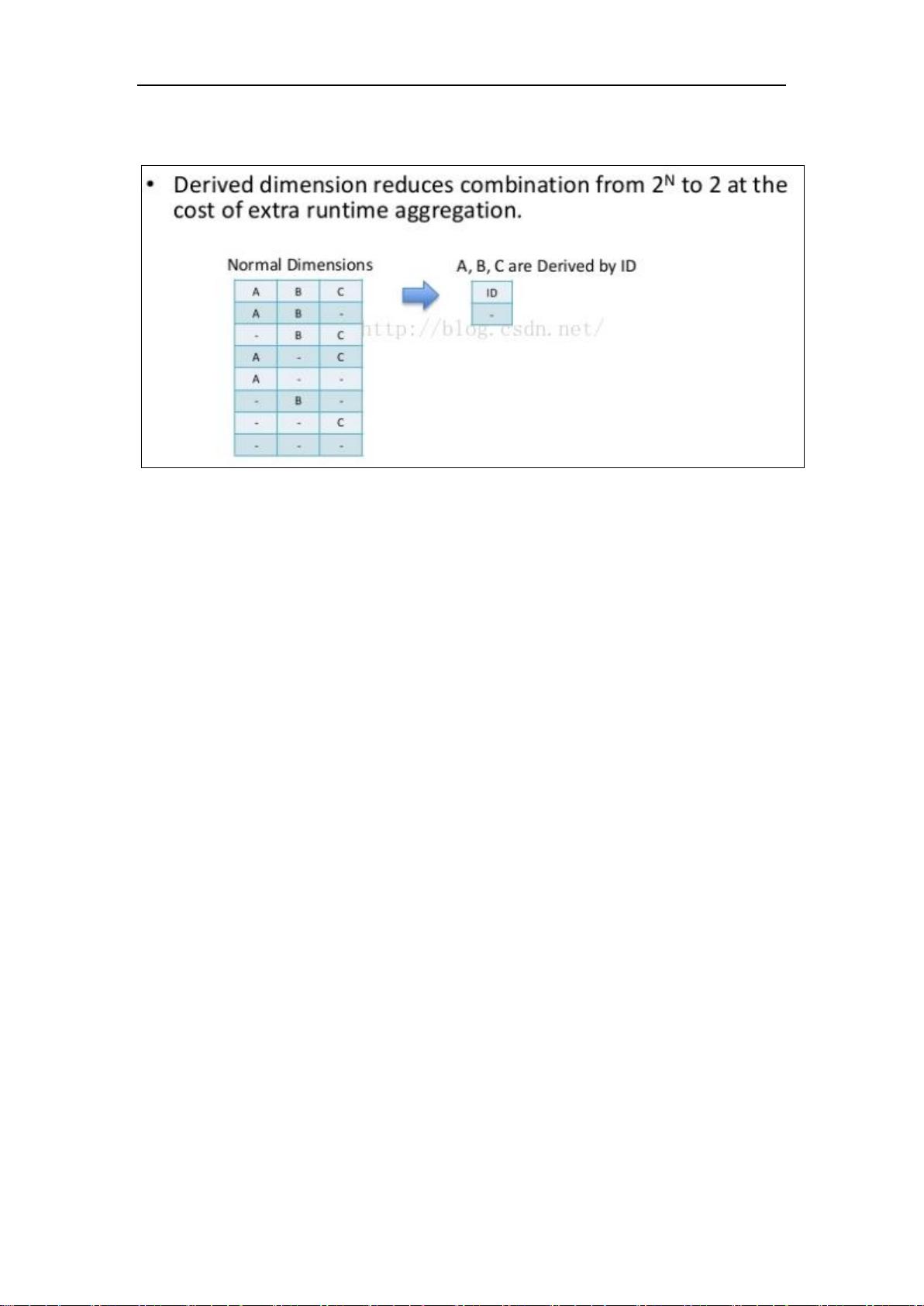

Kylin的主要特点是使用多维立方体预计算处理大数据查询,在Hadoop平台上提供亚秒级查询千亿记录的能力,提供标准SQL接口,查询性能比Hive快100~1000倍。其独创的稀疏立方体、压缩存储、微批处理构建等技术,很好的解决了大数据建立索引的指数级膨胀的难题,从而在查询速度上大大领先于其他基于MPP(大规模并行计算)等技术的解决方案。

Kylin是一个MOLAP系统,主要用于支持大数据生态圈的数据分析业务,通过预计算的方式将用户设定的多维立方体缓存到HBase中。Kylin与ROLAP系统Mondrian不同的是,Kylin需要预计算,而Mondrian不需要预计算,所有的查询可以通过实时的数据库查询完成。

Kylin的应用非常广泛,已经被国内外一线的互联网、金融、电信等公司越来越多地采用作为其大数据分析平台。Kylin也是第一个由中国人主导的Apache顶级项目,于2015年11月正式毕业成为Apache顶级项目,并获得了InfoWorld2015年Bossie最佳开源大数据工具奖。

Kylin的优点包括:

* 高性能查询速度,查询性能比Hive快100~1000倍

* 支持超大规模数据,提供标准SQL接口

* 独创的稀疏立方体、压缩存储、微批处理构建等技术,解决了大数据建立索引的指数级膨胀的难题

* 良好的扩展性和可靠性,支持大数据分析业务

* 广泛应用于互联网、金融、电信等行业

Kylin的缺点包括:

* 需要预计算,占用更多的存储空间

* 只支持HBase,目前不支持其他存储系统

* 需要专门的维护和管理,需要专业的技术人员

Kylin是一个功能强大且高性能的分布式分析引擎,广泛应用于大数据分析业务,具有广阔的发展前景。

2022-08-03 上传

2018-03-28 上传

2019-04-09 上传

2021-08-18 上传

2021-07-13 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

LauraKuang

- 粉丝: 23

- 资源: 334

最新资源

- python大数据等汇总.zip

- datastructures_algorithms

- Programs.rar_数学计算_C/C++_

- AlphaTrack PRO-开源

- canvas-sketch-render-service:基于HyperDrive的HyperSource服务,可将Canvas Sketch项目转换为生产包

- Magento-Import-Export:该脚本将导出和导入属性,集和产品

- 人工智能实验 个人作业.zip

- VedioSave.rar_视频捕捉/采集_Visual_C++_

- 5个电子字符

- Voldemort271.github.io:..

- 人工智能学习.zip

- cds-file-upload-frontend

- VB三角形动画窗体

- OpenCV.zip_Windows_CE_Visual_C++_

- parks_and_ride_project

- pythonTOexcel.zip