TensorFlow基础与实践:从安装到神经网络

需积分: 44 73 浏览量

更新于2024-07-17

收藏 2.55MB PDF 举报

"tensorflow莫凡知识点总结"

TensorFlow是由Google Brain团队开发的一个开源库,用于数值计算,特别是机器学习和深度学习领域。这个文档是针对TensorFlow的基础知识进行的学习教程,包含示例和作者的个人总结。

### 安装TensorFlow

安装TensorFlow有多种途径,适合不同的操作系统和环境需求:

1. **Pip安装**:适用于已经配置好Python环境的用户,可以通过`pip install tensorflow`或`pip install tensorflow-gpu`(如果支持GPU)来安装。

2. **Virtualenv安装**:为了隔离不同项目间的依赖,可以使用Virtualenv创建独立的Python环境来安装TensorFlow。

3. **Anaconda安装**:对于科学计算,Anaconda提供了一个方便的包管理器,可以使用`conda install tensorflow`或`conda install tensorflow-gpu`来安装。

4. **Docker安装**:对于想要避免环境配置的用户,可以使用TensorFlow官方提供的Docker镜像。

5. **从源代码安装**:对于开发者或需要定制特定版本的用户,可以从GitHub获取源代码编译安装。

### TensorFlow基础

- **Tensor张量**:TensorFlow的核心概念是张量,它表示多维数组,可以是标量、向量、矩阵或其他更高维度的数组。张量在计算图中作为节点,代表了计算的输入、中间结果和输出。

- **Session会话**:TensorFlow通过Session来执行计算图,它是实际运行和执行图的上下文。`tf.Session()`用于创建会话,`session.run()`用于执行计算。

### 模型构建与训练

- **Variable变量**:在TensorFlow中,Variable用于存储模型参数,它们可以在运行时改变。`tf.Variable()`用于创建变量。

- **Placeholder传入值**:Placeholder是占位符,用于在运行时动态输入数据。`tf.placeholder()`用于创建占位符。

- **拟合曲线和神经网络**:通过定义损失函数、优化器和训练循环,可以训练模型来拟合数据,例如用神经网络解决非线性方程。

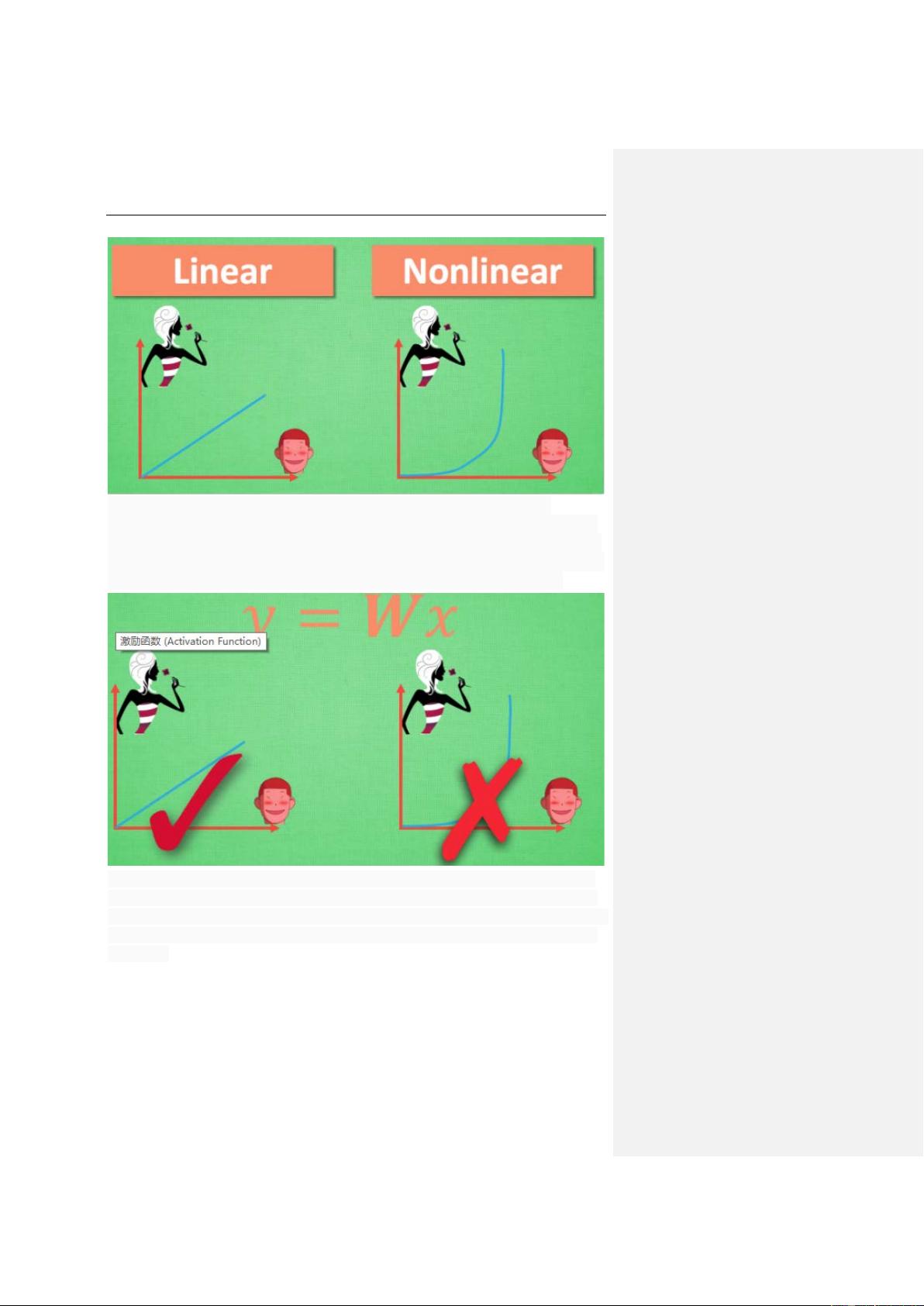

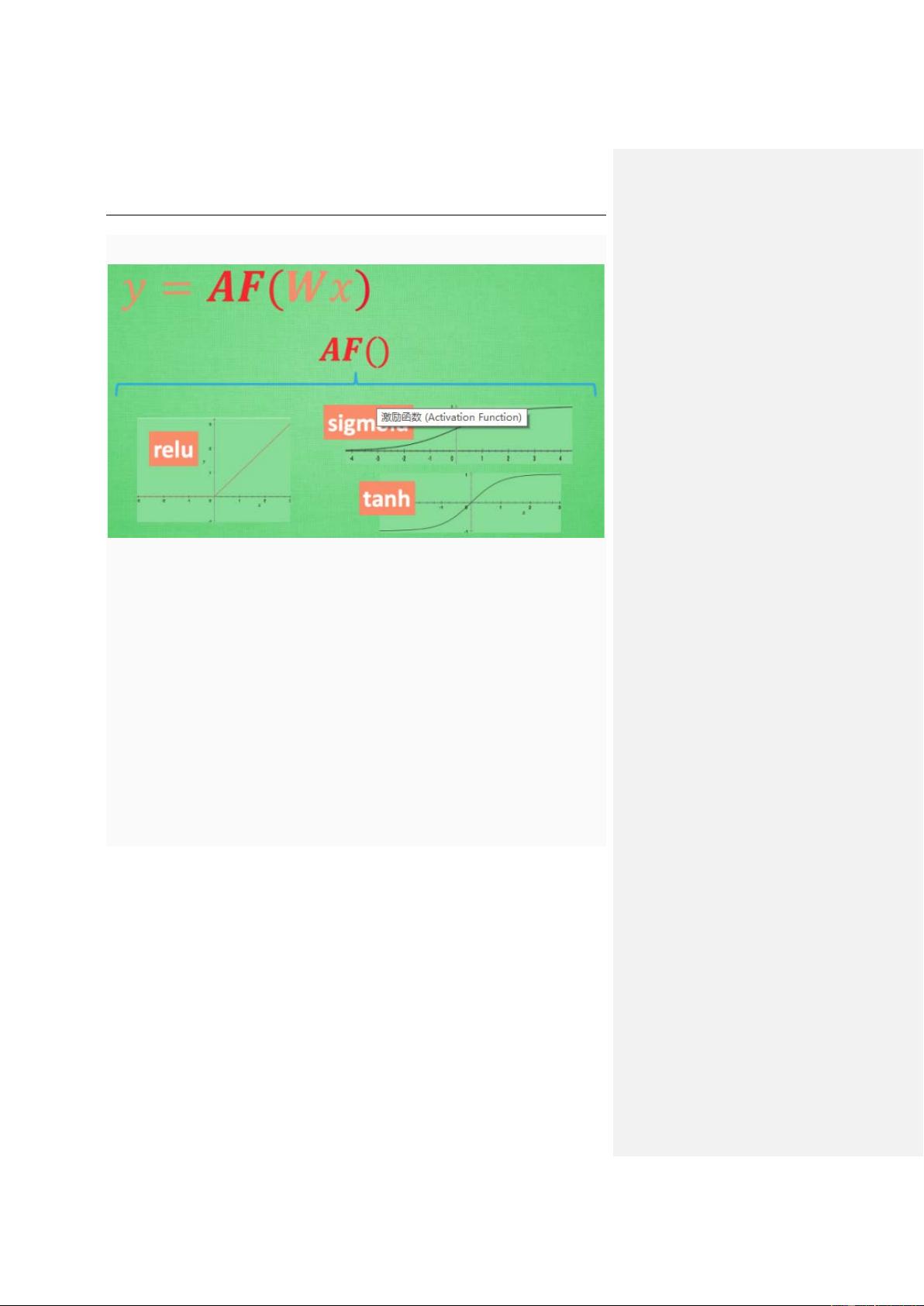

### 激励函数

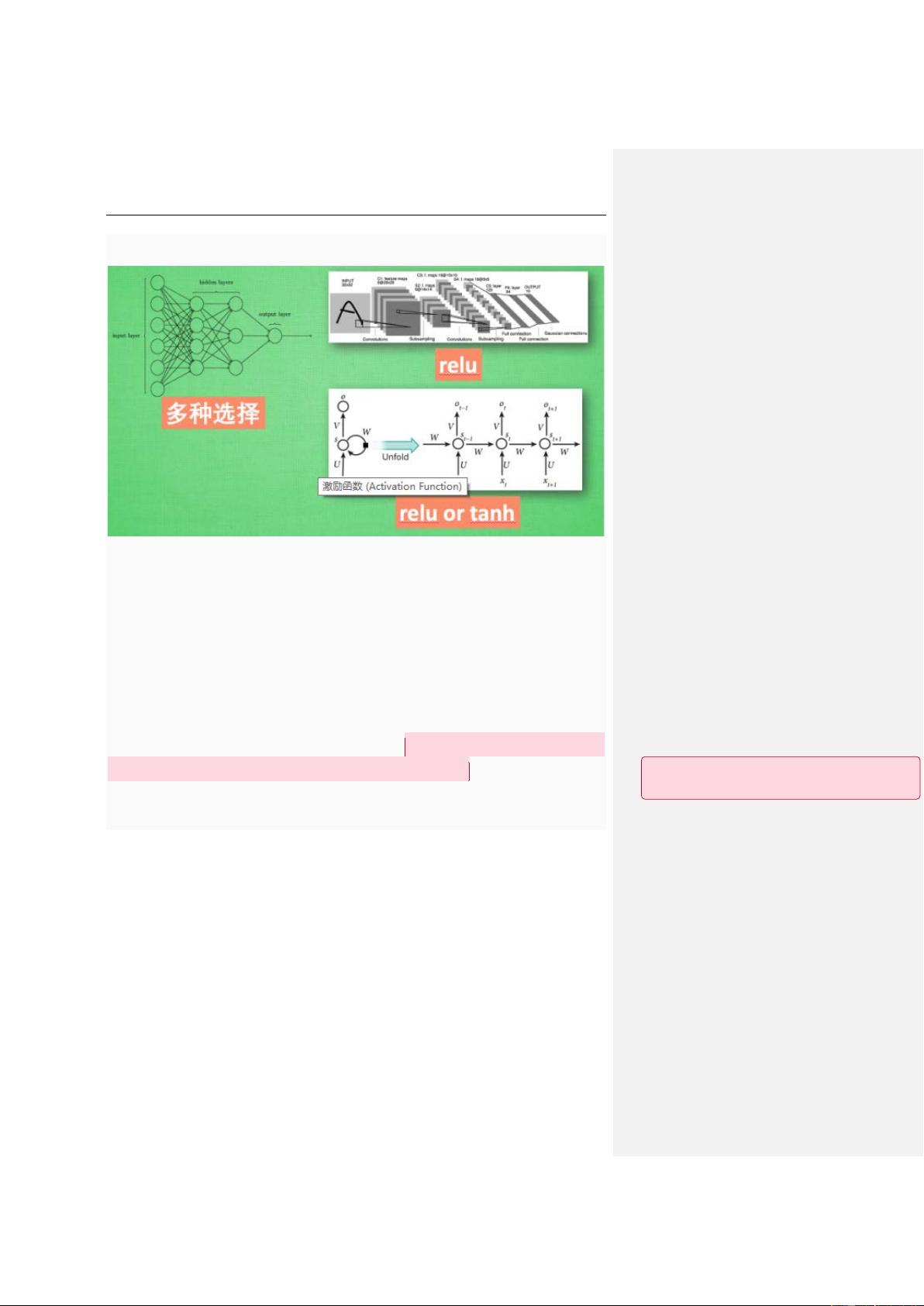

- **激励函数(Activation Function)**:激励函数是神经网络中的非线性部分,如Sigmoid、ReLU、Leaky ReLU等。它们引入非线性,使神经网络有能力模拟更复杂的函数。

- **常用激励函数的选择**:根据任务和网络结构的不同,可以选择不同的激励函数,如在深度网络中常用的ReLU及其变种。

### 优化算法

- **梯度下降优化**:Stochastic Gradient Descent (SGD)是最基本的优化方法,它根据梯度方向更新参数。

- **Momentum更新**:Momentum引入动量项来加速收敛,减少震荡。

- **AdaGrad**:自适应学习率方法,每个参数的学习率基于历史梯度平方和的对数。

- **RMSProp**:改善AdaGrad的梯度平方累积问题,使用指数移动平均来平滑历史梯度。

- **Adam**:结合了Momentum和RMSProp的优点,自适应调整每个参数的学习率,是目前广泛应用的优化器。

### 训练与可视化

- **训练过程**:包括前向传播、计算损失、反向传播和参数更新。

- **结果可视化**:可以使用matplotlib等库对训练结果进行可视化,监控模型性能和训练过程。

在深度学习实践中,理解并掌握这些基础知识和概念是至关重要的,它们构成了TensorFlow学习和应用的基础。随着进一步学习,可以探索更高级的主题,如卷积神经网络、循环神经网络、强化学习等,以及如何将TensorFlow应用于实际问题。

2018-08-17 上传

2023-06-08 上传

2023-07-25 上传

2023-10-19 上传

2023-08-02 上传

2024-03-14 上传

2023-07-09 上传

RNG_uzi_

- 粉丝: 13w+

- 资源: 134

最新资源

- 新型智能电加热器:触摸感应与自动温控技术

- 社区物流信息管理系统的毕业设计实现

- VB门诊管理系统设计与实现(附论文与源代码)

- 剪叉式高空作业平台稳定性研究与创新设计

- DAMA CDGA考试必备:真题模拟及章节重点解析

- TaskExplorer:全新升级的系统监控与任务管理工具

- 新型碎纸机进纸间隙调整技术解析

- 有腿移动机器人动作教学与技术存储介质的研究

- 基于遗传算法优化的RBF神经网络分析工具

- Visual Basic入门教程完整版PDF下载

- 海洋岸滩保洁与垃圾清运服务招标文件公示

- 触摸屏测量仪器与粘度测定方法

- PSO多目标优化问题求解代码详解

- 有机硅组合物及差异剥离纸或膜技术分析

- Win10快速关机技巧:去除关机阻止功能

- 创新打印机设计:速释打印头与压纸辊安装拆卸便捷性