深度学习实践:详解卷积神经网络CNN

需积分: 14 152 浏览量

更新于2024-07-17

收藏 48.93MB PDF 举报

卷积神经网络(Convolutional Neural Network, CNN)是深度学习领域的重要组成部分,它在图像识别、计算机视觉和自然语言处理等领域有着广泛应用。本手册深入解析了CNN的概念、发展历史以及其核心组件的工作原理。

绪论

- 引言部分介绍了深度学习的兴起背景,强调了CNN在解决复杂模式识别问题中的关键作用,以及它相对于传统机器学习方法的优势。

深度学习的前世今生

- 这一章节回顾了深度学习的起源,从人工神经网络的早期发展,如多层感知器,到LeCun等人在1980年代提出的第一代CNN模型,阐述了CNN是如何逐渐从概念到实际应用的演变过程。

基础理论篇

- 卷积神经网络基础知识

- CNN的基础理论包括卷积运算、池化操作和权重共享,这些都是构建深层网络的关键概念。

- 发展历程

- 进一步讨论了CNN的里程碑式进展,如AlexNet、VGG、GoogLeNet和ResNet等模型,它们如何推动了性能的显著提升和应用场景的拓展。

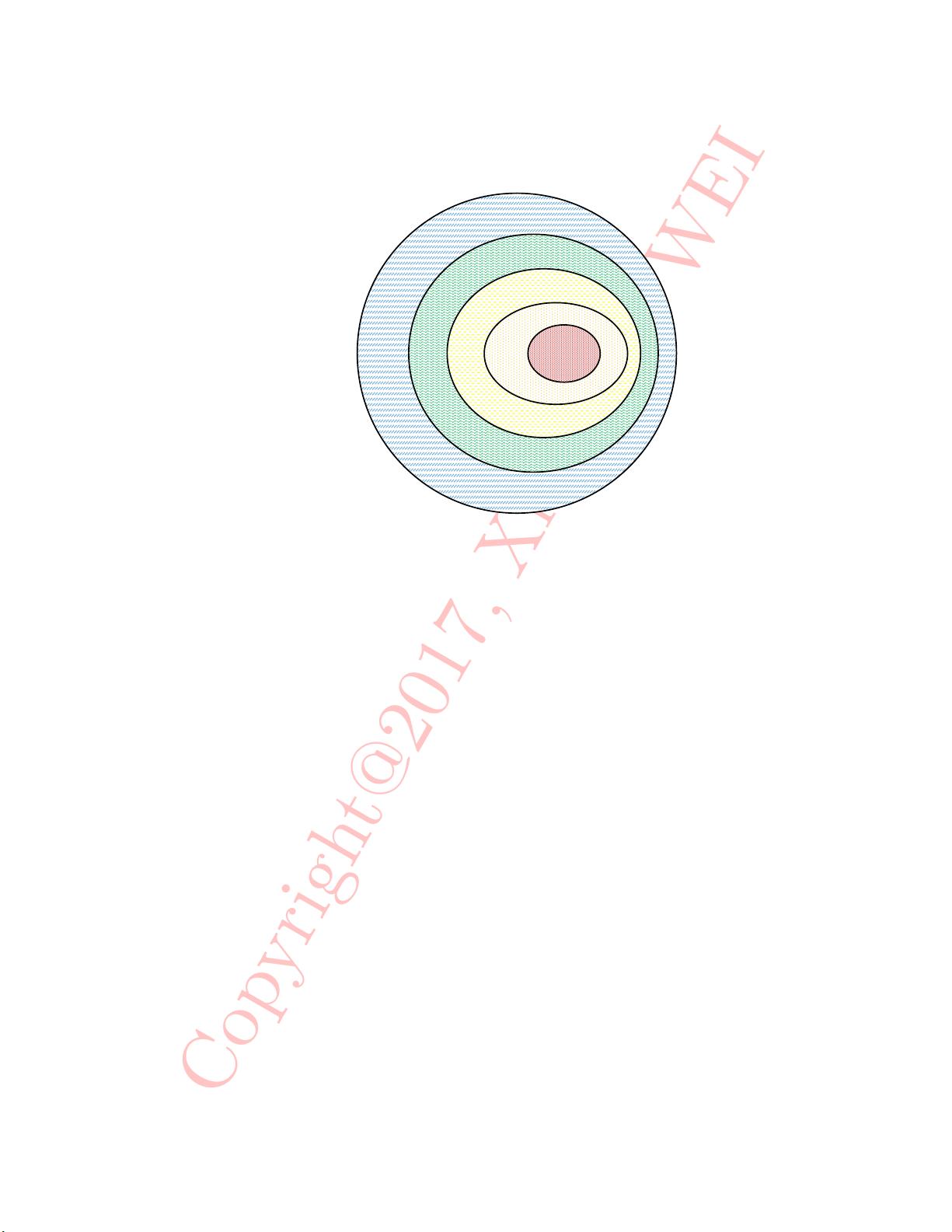

卷积神经网络的基本结构

- 卷积层:详细解释了卷积层的工作原理,包括滤波器(kernel)、滑动窗口(sliding window)和特征检测,以及它如何捕获输入数据的空间特征。

- 什么是卷积? - 通过示例阐述了卷积是如何通过局部连接和权值共享减少参数数量,提高模型的效率和泛化能力。

- 卷积操作的作用 - 强调了卷积层在提取图像局部特征和不变性方面的优势。

汇合层

- 什么是汇合? - 汇合层通常指的是最大池化或平均池化,它们用于降低数据维度,同时保留最重要的特征。

- 汇合操作的作用 - 描述了池化如何帮助模型对位置变化不敏感,增强模型的鲁棒性。

其他核心组件

- 前馈运算与反馈运算:分别介绍神经网络中信息的正向传播和反向传播过程,以及它们在训练过程中的作用。

- 激活函数:讨论了ReLU、sigmoid、tanh等常见激活函数的特点及其在激活神经元、增加非线性的作用。

- 全连接层:解释了全连接层在CNN中的位置,以及它如何将卷积层提取的特征映射到分类结果。

- 目标函数:介绍了损失函数的选择,如交叉熵,以及优化算法(如梯度下降)如何帮助模型收敛到最优解。

通过阅读这本实践手册,读者将深入了解CNN的内在机制,并能够运用这些知识构建和优化自己的深度学习模型,从而在实际项目中取得优秀的表现。无论是初学者还是经验丰富的从业者,都能从中受益匪浅。

2023-05-20 上传

2023-07-11 上传

2023-04-29 上传

2024-11-02 上传

2024-11-02 上传

2024-11-02 上传

zrsee

- 粉丝: 0

- 资源: 3

最新资源

- Java毕业设计项目:校园二手交易网站开发指南

- Blaseball Plus插件开发与构建教程

- Deno Express:模仿Node.js Express的Deno Web服务器解决方案

- coc-snippets: 强化coc.nvim代码片段体验

- Java面向对象编程语言特性解析与学生信息管理系统开发

- 掌握Java实现硬盘链接技术:LinkDisks深度解析

- 基于Springboot和Vue的Java网盘系统开发

- jMonkeyEngine3 SDK:Netbeans集成的3D应用开发利器

- Python家庭作业指南与实践技巧

- Java企业级Web项目实践指南

- Eureka注册中心与Go客户端使用指南

- TsinghuaNet客户端:跨平台校园网联网解决方案

- 掌握lazycsv:C++中高效解析CSV文件的单头库

- FSDAF遥感影像时空融合python实现教程

- Envato Markets分析工具扩展:监控销售与评论

- Kotlin实现NumPy绑定:提升数组数据处理性能