高清视频帧预测:SDC-Net利用空间位移卷积提升细节

59 浏览量

更新于2024-06-20

收藏 2.07MB PDF 举报

本文主要探讨了一种创新的视频帧预测技术,名为"基于空间位移卷积的高清视频帧预测方法" (SDC-Net),该方法旨在提高视频帧预测的清晰度和细节保留能力,特别是在高分辨率场景下。传统的视频帧预测技术面临着挑战,如仅依赖未来光流的重采样可能导致遮挡区域处理不力,生成模型则往往产生模糊效果,且内核大小增加会增加内存需求。

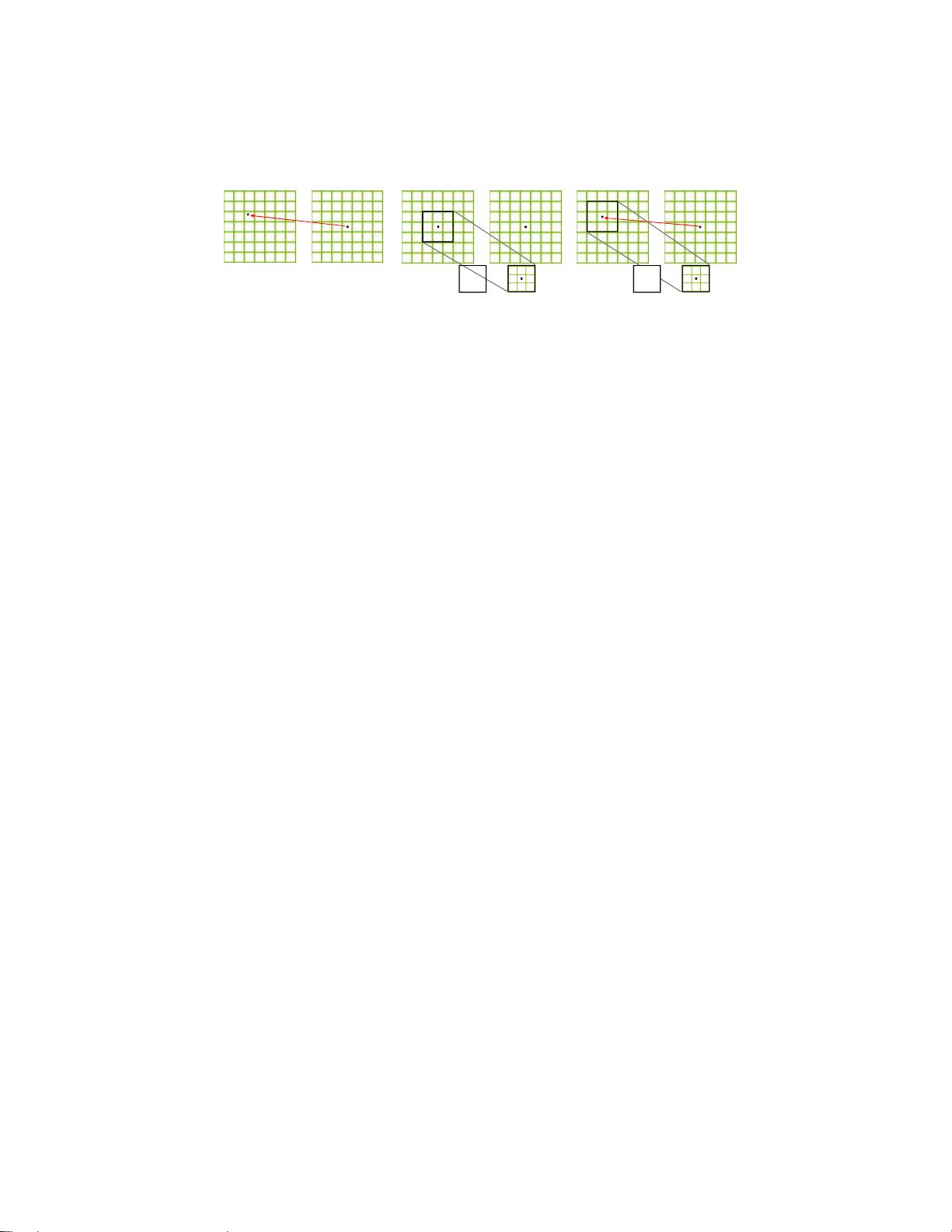

SDC-Net的核心贡献在于引入了空间位移卷积 (SDC) 模块。这种方法摒弃了单纯依赖未来光流的策略,而是学习每个像素的运动矢量,并根据这些预测的矢量确定在源图像中的正确位移位置,然后通过在该位置应用预先学习的内核来合成新像素。这种融合了向量导向和内核生成的优点的方式,既捕捉了对象的运动细节,又保持了周围结构的真实呈现,解决了先前方法的局限性。

研究者们在一个包含428K个未标记的1080p游戏视频帧的数据集上训练了模型,验证了其在高清视频预测任务上的优越性能。在YouTube-8M数据集上,SDC-Net达到了0.904的 Structural Similarity Index Measure (SSIM) 分数,显示出对复杂场景的出色适应性。在加州理工学院行人视频上,模型的表现进一步提升,SSIM分数达到了0.918,这证明了其在处理大运动和生成清晰、连贯帧方面的高效能力。

关键词:3D卷积神经网络 (3DCNN)、采样核、光流、帧预测。这项工作展示了在视频预测领域的进步,尤其是在对高清视觉质量的追求上,为未来的实时视频处理和增强现实应用提供了强大的技术支持。通过在大规模未标记数据上进行训练,SDC-Net展示了在无监督学习环境下取得的显著成果,这为未来的视频处理技术发展开辟了新的可能性。

2021-09-25 上传

2023-05-22 上传

2024-04-08 上传

2023-07-27 上传

2023-08-19 上传

2023-06-07 上传

2023-05-26 上传

2023-10-20 上传

cpongm

- 粉丝: 5

- 资源: 2万+

最新资源

- zlib-1.2.12压缩包解析与技术要点

- 微信小程序滑动选项卡源码模版发布

- Unity虚拟人物唇同步插件Oculus Lipsync介绍

- Nginx 1.18.0版本WinSW自动安装与管理指南

- Java Swing和JDBC实现的ATM系统源码解析

- 掌握Spark Streaming与Maven集成的分布式大数据处理

- 深入学习推荐系统:教程、案例与项目实践

- Web开发者必备的取色工具软件介绍

- C语言实现李春葆数据结构实验程序

- 超市管理系统开发:asp+SQL Server 2005实战

- Redis伪集群搭建教程与实践

- 掌握网络活动细节:Wireshark v3.6.3网络嗅探工具详解

- 全面掌握美赛:建模、分析与编程实现教程

- Java图书馆系统完整项目源码及SQL文件解析

- PCtoLCD2002软件:高效图片和字符取模转换

- Java开发的体育赛事在线购票系统源码分析